转载自:etcd实现分布式锁

当并发的访问共享资源的时候,如果没有加锁的话,无法保证共享资源安全性和正确性。这个时候就需要用到锁

当业务执行在同一个线程内,也就是我初始化一个本地锁,其他请求也认这把锁。一般是服务部署在单机环境下。

我们可以看下下面的例子,开1000个goroutine并发的给Counter做自增操作,结果会是什么样的呢?

package main

import (

"fmt"

"sync"

)

var sg sync.WaitGroup

type Counter struct {

count int

}

// 自增操作

func (m *Counter) Incr() {

m.count++

}

// 获取总数

func (m *Counter) Count() int {

return m.count

}

func main() {

c := &Counter{}

for i := 0; i < 1000; i++ {

sg.Add(1)

// 模拟并发请求

go func() {

c.Incr()

sg.Done()

}()

}

sg.Wait()

fmt.Println(c.Count())

}

结果是count的数量并不是预想中的1000,而是下面这样,每次打印出的结果都不一样,但是接近1000

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

953

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

982

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

984

出现这个问题的原因就是没有给自增操作加锁

下面我们修改代码如下,在Incr中加上go的mutex互斥锁

package main

import (

"fmt"

"sync"

)

var sg sync.WaitGroup

type Counter struct {

count int

mu sync.Mutex

}

func (m *Counter) Incr() {

// 每次写之前先加锁,写完之后释放锁

m.mu.Lock()

defer m.mu.Unlock()

m.count++

}

func (m *Counter) Count() int {

return m.count

}

func main() {

c := &Counter{}

for i := 0; i < 1000; i++ {

sg.Add(1)

go func() {

c.Incr()

sg.Done()

}()

}

sg.Wait()

fmt.Println(c.Count())

}

可以看到现在count正常输出1000了

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

1000

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

1000

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

1000

├── docker-compose.yml

├── etcd

│ └── Dockerfile

Dockerfile文件内容

FROM bitnami/etcd:latest

LABEL maintainer="liuyuede123 <liufutianoppo@163.com>"

Docker-compose.yml内容

version: '3.5'

# 网络配置

networks:

backend:

driver: bridge

# 服务容器配置

services:

etcd1: # 自定义容器名称

build:

context: etcd # 指定构建使用的 Dockerfile 文件

environment:

- TZ=Asia/Shanghai

- ALLOW_NONE_AUTHENTICATION=yes

- ETCD_NAME=etcd1

- ETCD_INITIAL_ADVERTISE_PEER_URLS=http://etcd1:2380

- ETCD_LISTEN_PEER_URLS=http://0.0.0.0:2380

- ETCD_LISTEN_CLIENT_URLS=http://0.0.0.0:2379

- ETCD_ADVERTISE_CLIENT_URLS=http://etcd1:2379

- ETCD_INITIAL_CLUSTER_TOKEN=etcd-cluster

- ETCD_INITIAL_CLUSTER=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- ETCD_INITIAL_CLUSTER_STATE=new

ports: # 设置端口映射

- "12379:2379"

- "12380:2380"

networks:

- backend

restart: always

etcd2: # 自定义容器名称

build:

context: etcd # 指定构建使用的 Dockerfile 文件

environment:

- TZ=Asia/Shanghai

- ALLOW_NONE_AUTHENTICATION=yes

- ETCD_NAME=etcd2

- ETCD_INITIAL_ADVERTISE_PEER_URLS=http://etcd2:2380

- ETCD_LISTEN_PEER_URLS=http://0.0.0.0:2380

- ETCD_LISTEN_CLIENT_URLS=http://0.0.0.0:2379

- ETCD_ADVERTISE_CLIENT_URLS=http://etcd2:2379

- ETCD_INITIAL_CLUSTER_TOKEN=etcd-cluster

- ETCD_INITIAL_CLUSTER=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- ETCD_INITIAL_CLUSTER_STATE=new

ports: # 设置端口映射

- "22379:2379"

- "22380:2380"

networks:

- backend

restart: always

etcd3: # 自定义容器名称

build:

context: etcd # 指定构建使用的 Dockerfile 文件

environment:

- TZ=Asia/Shanghai

- ALLOW_NONE_AUTHENTICATION=yes

- ETCD_NAME=etcd3

- ETCD_INITIAL_ADVERTISE_PEER_URLS=http://etcd3:2380

- ETCD_LISTEN_PEER_URLS=http://0.0.0.0:2380

- ETCD_LISTEN_CLIENT_URLS=http://0.0.0.0:2379

- ETCD_ADVERTISE_CLIENT_URLS=http://etcd3:2379

- ETCD_INITIAL_CLUSTER_TOKEN=etcd-cluster

- ETCD_INITIAL_CLUSTER=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- ETCD_INITIAL_CLUSTER_STATE=new

ports: # 设置端口映射

- "32379:2379"

- "32380:2380"

networks:

- backend

restart: always

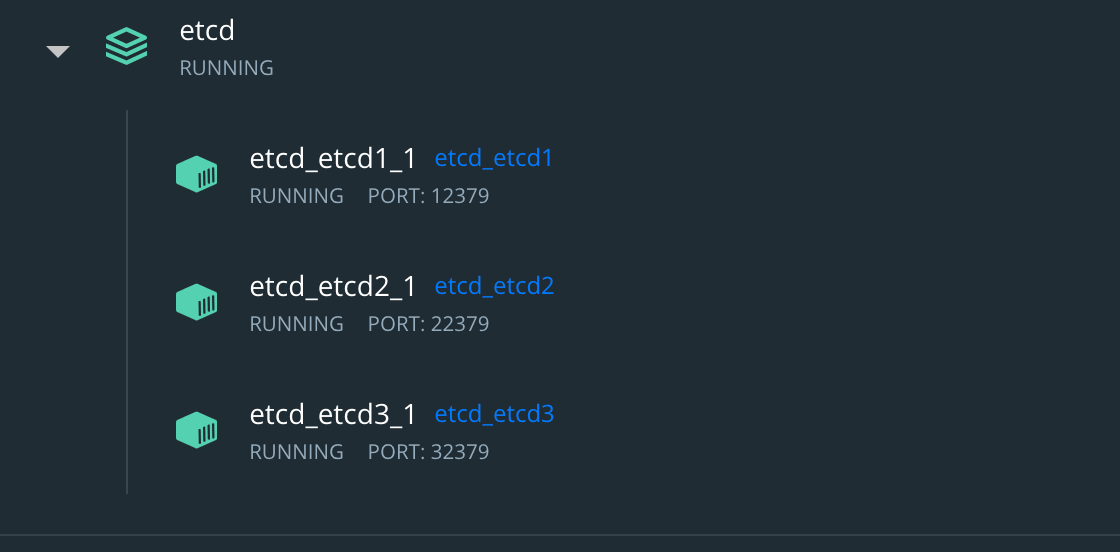

执行docker-compose up -d启动etcd服务,可以看到docker中已经启动了3个服务

package main

import (

"fmt"

clientv3 "go.etcd.io/etcd/client/v3"

"go.etcd.io/etcd/client/v3/concurrency"

"sync"

)

var sg sync.WaitGroup

type Counter struct {

count int

}

func (m *Counter) Incr() {

m.count++

}

func (m *Counter) Count() int {

return m.count

}

func main() {

endpoints := []string{"http://127.0.0.1:12379", "http://127.0.0.1:22379", "http://127.0.0.1:32379"}

// 初始化etcd客户端

client, err := clientv3.New(clientv3.Config{Endpoints: endpoints})

if err != nil {

fmt.Println(err)

return

}

defer client.Close()

counter := &Counter{}

sg.Add(100)

for i := 0; i < 100; i++ {

go func() {

// 这里会生成租约,默认是60秒

session, err := concurrency.NewSession(client)

if err != nil {

panic(err)

}

defer session.Close()

locker := concurrency.NewLocker(session, "/my-test-lock")

locker.Lock()

counter.Incr()

locker.Unlock()

sg.Done()

}()

}

sg.Wait()

fmt.Println("count:", counter.Count())

}

执行结果:

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

count: 100

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

count: 100

user@userdeMacBook-Pro ~/go/src/go-demo/mutex go run main.go

count: 100

当某个客户端持有锁时,由于某些原因导致锁未释放,就会导致这个客户端一直持有这把锁,其他客户端一直获取不到锁。所以需要分布式锁实现超时机制,当锁未释放时,会因为etcd的租约会到期而释放锁。当业务正常处理时,租约到期之前会继续续约,知道业务处理完毕释放锁。

package main

import (

"fmt"

clientv3 "go.etcd.io/etcd/client/v3"

"go.etcd.io/etcd/client/v3/concurrency"

"sync"

"time"

)

var sg sync.WaitGroup

type Counter struct {

count int

}

func (m *Counter) Incr() {

m.count++

}

func (m *Counter) Count() int {

return m.count

}

func main() {

endpoints := []string{"http://127.0.0.1:12379", "http://127.0.0.1:22379", "http://127.0.0.1:32379"}

client, err := clientv3.New(clientv3.Config{Endpoints: endpoints})

if err != nil {

fmt.Println(err)

return

}

defer client.Close()

counter := &Counter{}

session, err := concurrency.NewSession(client)

if err != nil {

panic(err)

}

defer session.Close()

locker := concurrency.NewLocker(session, "/my-test-lock")

fmt.Println("locking...", time.Now().Format("2006-01-02 15:04:05"))

locker.Lock()

fmt.Println("locked...", time.Now().Format("2006-01-02 15:04:05"))

// 模拟业务

time.Sleep(100 * time.Second)

counter.Incr()

locker.Unlock()

fmt.Println("released...", time.Now().Format("2006-01-02 15:04:05"))

fmt.Println("count:", counter.Count())

}

命令行开2个窗口,第一个窗口执行程序并获取锁,之后模拟意外退出并没有调用unlock方法

go run main.go

locking... 2022-09-03 23:41:48 # 租约生成时间

locked... 2022-09-03 23:41:48

^Csignal: interrupt

第二个窗口,在第一个窗口退出之前尝试获取锁,此时是阻塞状态。第一个窗口退出之后由于租约还没到期,第二个窗口还是获取锁的状态。等到第一个窗口租约到期(默认60秒),第二个获取锁成功

locking... 2022-09-03 23:41:52

locked... 2022-09-03 23:42:48 # 第一个租约60秒到期,获取锁成功

released... 2022-09-03 23:44:28

count: 1

上面的例子中已经实现了阻塞接口,即当前有获取到锁的请求,则其他请求阻塞等待锁释放

非阻塞的方式就是尝试获取锁,如果失败立即返回。etcd中是实现了tryLock方法

// TryLock locks the mutex if not already locked by another session.

// If lock is held by another session, return immediately after attempting necessary cleanup

// The ctx argument is used for the sending/receiving Txn RPC.

func (m *Mutex) TryLock(ctx context.Context) error {

具体看下面的例子

package main

import (

"context"

"fmt"

clientv3 "go.etcd.io/etcd/client/v3"

"go.etcd.io/etcd/client/v3/concurrency"

"sync"

"time"

)

var sg sync.WaitGroup

type Counter struct {

count int

}

func (m *Counter) Incr() {

m.count++

}

func (m *Counter) Count() int {

return m.count

}

func main() {

endpoints := []string{"http://127.0.0.1:12379", "http://127.0.0.1:22379", "http://127.0.0.1:32379"}

client, err := clientv3.New(clientv3.Config{Endpoints: endpoints})

if err != nil {

fmt.Println(err)

return

}

defer client.Close()

counter := &Counter{}

session, err := concurrency.NewSession(client)

if err != nil {

panic(err)

}

defer session.Close()

// 此处使用newMutex初始化

locker := concurrency.NewMutex(session, "/my-test-lock")

fmt.Println("locking...", time.Now().Format("2006-01-02 15:04:05"))

err = locker.TryLock(context.Background())

// 获取锁失败就抛错

if err != nil {

fmt.Println("lock failed", err)

return

}

fmt.Println("locked...", time.Now().Format("2006-01-02 15:04:05"))

time.Sleep(100 * time.Second)

counter.Incr()

err = locker.Unlock(context.Background())

if err != nil {

fmt.Println("unlock failed", err)

return

}

fmt.Println("released...", time.Now().Format("2006-01-02 15:04:05"))

fmt.Println("count:", counter.Count())

}

窗口1、窗口2执行结果

go run main.go

locking... 2022-09-04 00:00:21

locked... 2022-09-04 00:00:21

released... 2022-09-04 00:02:01

count: 1

go run main.go

locking... 2022-09-04 00:00:27

lock failed mutex: Locked by another session

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

我有一个涉及多台机器、消息队列和事务的问题。因此,例如用户点击网页,点击将消息发送到另一台机器,该机器将付款添加到用户的帐户。每秒可能有数千次点击。事务的所有方面都应该是容错的。我以前从未遇到过这样的事情,但一些阅读表明这是一个众所周知的问题。所以我的问题。我假设安全的方法是使用两阶段提交,但协议(protocol)是阻塞的,所以我不会获得所需的性能,我是否正确?我通常写Ruby,但似乎Redis之类的数据库和Rescue、RabbitMQ等消息队列系统对我的帮助不大——即使我实现某种两阶段提交,如果Redis崩溃,数据也会丢失,因为它本质上只是内存。所有这些让我开始关注erlang和

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复

在ruby中,你可以这样做:classThingpublicdeff1puts"f1"endprivatedeff2puts"f2"endpublicdeff3puts"f3"endprivatedeff4puts"f4"endend现在f1和f3是公共(public)的,f2和f4是私有(private)的。内部发生了什么,允许您调用一个类方法,然后更改方法定义?我怎样才能实现相同的功能(表面上是创建我自己的java之类的注释)例如...classThingfundeff1puts"hey"endnotfundeff2puts"hey"endendfun和notfun将更改以下函数定

我目前有一个reddit克隆类型的网站。我正在尝试根据我的用户之前喜欢的帖子推荐帖子。看起来K最近邻或k均值是执行此操作的最佳方法。我似乎无法理解如何实际实现它。我看过一些数学公式(例如k表示维基百科页面),但它们对我来说并没有真正意义。有人可以推荐一些伪代码,或者可以查看的地方,以便我更好地了解如何执行此操作吗? 最佳答案 K最近邻(又名KNN)是一种分类算法。基本上,您采用包含N个项目的训练组并对它们进行分类。如何对它们进行分类完全取决于您的数据,以及您认为该数据的重要分类特征是什么。在您的示例中,这可能是帖子类别、谁发布了该项

我查看了Stripedocumentationonerrors,但我仍然无法正确处理/重定向这些错误。基本上无论发生什么,我都希望他们返回到edit操作(通过edit_profile_path)并向他们显示一条消息(无论成功与否)。我在edit操作上有一个表单,它可以POST到update操作。使用有效的信用卡可以正常工作(费用在Stripe仪表板中)。我正在使用Stripe.js。classExtrasController5000,#amountincents:currency=>"usd",:card=>token,:description=>current_user.email)