摘要:该方法的主要思想是使用数值较大的排在前面的梯度进行反向传播,可以认为是一种在线难例挖掘方法,该方法使模型讲注意力放在较难学习的样本上,以此让模型产生更好的效果。

本文分享自华为云社区《ATK Loss论文复现与代码实战》,作者:李长安。

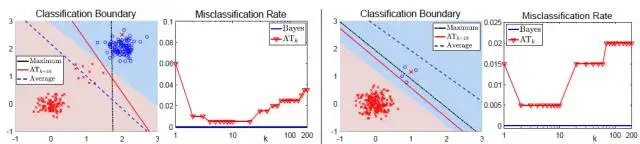

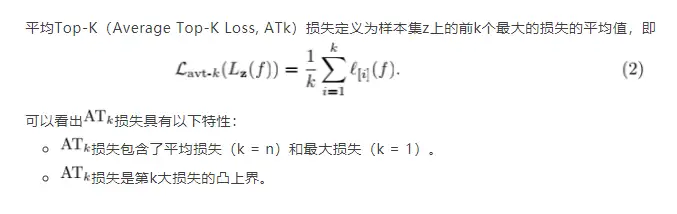

损失是一种非常通用的聚合损失,其可以和很多现有的定义在单个样本上的损失 结合起来,如logistic损失,hinge损失,平方损失(L2),绝对值损失(L1)等等。通过引入自由度 k,损失可以更好的拟合数据的不同分布。当数据存在多分布或类别分布不均衡的时候,最小化平均损失会牺牲掉小类样本以达到在整体样本集上的损失最小;当数据存在噪音或外点的时候,最大损失对噪音非常的敏感,学习到的分类边界跟Bayes最优边界相差很大;当采取损失最为聚合损失的时候(如k=10),可以更好的保护小类样本,并且其相对于最大损失而言对噪音更加鲁棒。所以我们可以推测:最优的k即不是k = 1(对应最大损失)也不是k = n(对应平均损失),而是在[1, n]之间存在一个比较合理的k的取值区间。

上图结合仿真数据显示了最小化平均损失和最小化最大损失分别得到的分类结果。可以看出,当数据分布不均衡或是某类数据存在典型分布和非典型分布的时候,最小化平均损失会忽略小类分布的数据而得到次优的结果;而最大损失对样本噪音和外点(outliers)非常的敏感,即使数据中仅存在一个外点也可能导致模型学到非常糟糕的分类边界;相比于最大损失损失,第k大损失对噪音更加鲁棒,但其在k > 1时非凸非连续,优化非常困难。

由于真实数据集非常复杂,可能存在多分布性、不平衡性以及噪音等等,为了更好的拟合数据的不同分布,我们提出了平均Top-K损失作为一种新的聚合损失。

本项目最初的思路来自于八月份参加比赛的时候。由于数据集复杂,所以就在想一些难例挖掘的方法。看看这个方法能否带来一个更好的模型效果。该方法的主要思想是使用数值较大的排在前面的梯度进行反向传播,可以认为是一种在线难例挖掘方法,该方法使模型讲注意力放在较难学习的样本上,以此让模型产生更好的效果。代码如下所示。

class topk_crossEntrophy(nn.Layer):

def __init__(self, top_k=0.6):

super(topk_crossEntrophy, self).__init__()

self.loss = nn.NLLLoss()

self.top_k = top_k

self.softmax = nn.LogSoftmax()

return

def forward(self, inputs, target):

softmax_result = self.softmax(inputs)

loss1 = paddle.zeros([1])

for idx, row in enumerate(softmax_result):

gt = target[idx]

pred = paddle.unsqueeze(row, 0)

cost = self.loss(pred, gt)

loss1 = paddle.concat((loss1, cost), 0)

loss1 = loss1[1:]

if self.top_k == 1:

valid_loss1 = loss1

index = paddle.topk(loss1, int(self.top_k * len(loss1)))

valid_loss1 = loss1[index[1]]

return paddle.mean(valid_loss1)此部分使用比赛中的数据集,并带领大家使用Top-k Loss完成模型训练。在本例中使用前70%的Loss。

!cd 'data/data107306' && unzip -q img.zip

# 导入所需要的库

from sklearn.utils import shuffle

import os

import pandas as pd

import numpy as np

from PIL import Image

import paddle

import paddle.nn as nn

from paddle.io import Dataset

import paddle.vision.transforms as T

import paddle.nn.functional as F

from paddle.metric import Accuracy

import warnings

warnings.filterwarnings("ignore")

# 读取数据

train_images = pd.read_csv('data/data107306/img/df_all.csv')

train_images = shuffle(train_images)

# 划分训练集和校验集

all_size = len(train_images)

train_size = int(all_size * 0.9)

train_image_list = train_images[:train_size]

val_image_list = train_images[train_size:]

train_image_path_list = train_image_list['image'].values

label_list = train_image_list['label'].values

train_label_list = paddle.to_tensor(label_list, dtype='int64')

val_image_path_list = val_image_list['image'].values

val_label_list1 = val_image_list['label'].values

val_label_list = paddle.to_tensor(val_label_list1, dtype='int64')

# 定义数据预处理

data_transforms = T.Compose([

T.Resize(size=(448, 448)),

T.Transpose(), # HWC -> CHW

T.Normalize(

mean = [0, 0, 0],

std = [255, 255, 255],

to_rgb=True)

])

# 构建Dataset

class MyDataset(paddle.io.Dataset):

"""

步骤一:继承paddle.io.Dataset类

"""

def __init__(self, train_img_list, val_img_list,train_label_list,val_label_list, mode='train'):

"""

步骤二:实现构造函数,定义数据读取方式,划分训练和测试数据集

"""

super(MyDataset, self).__init__()

self.img = []

self.label = []

self.valimg = []

self.vallabel = []

# 借助pandas读csv的库

self.train_images = train_img_list

self.test_images = val_img_list

self.train_label = train_label_list

self.test_label = val_label_list

# self.mode = mode

if mode == 'train':

# 读train_images的数据

for img,la in zip(self.train_images, self.train_label):

self.img.append('data/data107306/img/imgV/'+img)

self.label.append(la)

else :

# 读test_images的数据

for img,la in zip(self.test_images, self.test_label):

self.img.append('data/data107306/img/imgV/'+img)

self.label.append(la)

def load_img(self, image_path):

# 实际使用时使用Pillow相关库进行图片读取即可,这里我们对数据先做个模拟

image = Image.open(image_path).convert('RGB')

image = np.array(image).astype('float32')

return image

def __getitem__(self, index):

"""

步骤三:实现__getitem__方法,定义指定index时如何获取数据,并返回单条数据(训练数据,对应的标签)

"""

# if self.mode == 'train':

image = self.load_img(self.img[index])

label = self.label[index]

return data_transforms(image), label

def __len__(self):

"""

步骤四:实现__len__方法,返回数据集总数目

"""

return len(self.img)

#train_loader

train_dataset = MyDataset(train_img_list=train_image_path_list, val_img_list=val_image_path_list, train_label_list=train_label_list, val_label_list=val_label_list, mode='train')

train_loader = paddle.io.DataLoader(train_dataset, places=paddle.CPUPlace(), batch_size=4, shuffle=True, num_workers=0)

#val_loader

val_dataset = MyDataset(train_img_list=train_image_path_list, val_img_list=val_image_path_list, train_label_list=train_label_list, val_label_list=val_label_list, mode='test')

val_loader = paddle.io.DataLoader(val_dataset, places=paddle.CPUPlace(), batch_size=4, shuffle=True, num_workers=0)

from res2net import Res2Net50_vd_26w_4s

# 模型封装

model_re2 = Res2Net50_vd_26w_4s(class_dim=4)

import paddle.nn.functional as F

import paddle

modelre2_state_dict = paddle.load("Res2Net50_vd_26w_4s_pretrained.pdparams")

model_re2.set_state_dict(modelre2_state_dict, use_structured_name=True)

model_re2.train()

epochs = 2

optim1 = paddle.optimizer.Adam(learning_rate=3e-4, parameters=model_re2.parameters())

class topk_crossEntrophy(nn.Layer):

def __init__(self, top_k=0.7):

super(topk_crossEntrophy, self).__init__()

self.loss = nn.NLLLoss()

self.top_k = top_k

self.softmax = nn.LogSoftmax()

return

def forward(self, inputs, target):

softmax_result = self.softmax(inputs)

loss1 = paddle.zeros([1])

for idx, row in enumerate(softmax_result):

gt = target[idx]

pred = paddle.unsqueeze(row, 0)

cost = self.loss(pred, gt)

loss1 = paddle.concat((loss1, cost), 0)

loss1 = loss1[1:]

if self.top_k == 1:

valid_loss1 = loss1

# print(len(loss1))

index = paddle.topk(loss1, int(self.top_k * len(loss1)))

valid_loss1 = loss1[index[1]]

return paddle.mean(valid_loss1)

topk_loss = topk_crossEntrophy()

from numpy import *

# 用Adam作为优化函数

for epoch in range(epochs):

loss1_train = []

loss2_train = []

loss_train = []

acc1_train = []

acc2_train = []

acc_train = []

for batch_id, data in enumerate(train_loader()):

x_data = data[0]

y_data = data[1]

y_data1 = paddle.topk(y_data, 1)[1]

predicts1 = model_re2(x_data)

loss1 = topk_loss(predicts1, y_data1)

# 计算损失

acc1 = paddle.metric.accuracy(predicts1, y_data)

loss1.backward()

if batch_id % 1 == 0:

print("epoch: {}, batch_id: {}, loss1 is: {}, acc1 is: {}".format(epoch, batch_id, loss1.numpy(), acc1.numpy()))

optim1.step()

optim1.clear_grad()

loss1_eval = []

loss2_eval = []

loss_eval = []

acc1_eval = []

acc2_eval = []

acc_eval = []

for batch_id, data in enumerate(val_loader()):

x_data = data[0]

y_data = data[1]

y_data1 = paddle.topk(y_data, 1)[1]

predicts1 = model_re2(x_data)

loss1 = topk_loss(predicts1, y_data1)

loss1_eval.append(loss1.numpy())

# 计算acc

acc1 = paddle.metric.accuracy(predicts1, y_data)

acc1_eval.append(acc1)

if batch_id % 100 == 0:

print('************Eval Begin!!***************')

print("epoch: {}, batch_id: {}, loss1 is: {}, acc1 is: {}".format(epoch, batch_id, loss1.numpy(), acc1.numpy()))

print('************Eval End!!***************')

如何在buildr项目中使用Ruby?我在很多不同的项目中使用过Ruby、JRuby、Java和Clojure。我目前正在使用我的标准Ruby开发一个模拟应用程序,我想尝试使用Clojure后端(我确实喜欢功能代码)以及JRubygui和测试套件。我还可以看到在未来的不同项目中使用Scala作为后端。我想我要为我的项目尝试一下buildr(http://buildr.apache.org/),但我注意到buildr似乎没有设置为在项目中使用JRuby代码本身!这看起来有点傻,因为该工具旨在统一通用的JVM语言并且是在ruby中构建的。除了将输出的jar包含在一个独特的、仅限ruby

在rails源中:https://github.com/rails/rails/blob/master/activesupport/lib/active_support/lazy_load_hooks.rb可以看到以下内容@load_hooks=Hash.new{|h,k|h[k]=[]}在IRB中,它只是初始化一个空哈希。和做有什么区别@load_hooks=Hash.new 最佳答案 查看rubydocumentationforHashnew→new_hashclicktotogglesourcenew(obj)→new_has

我的主要目标是能够完全理解我正在使用的库/gem。我尝试在Github上从头到尾阅读源代码,但这真的很难。我认为更有趣、更温和的踏脚石就是在使用时阅读每个库/gem方法的源代码。例如,我想知道RubyonRails中的redirect_to方法是如何工作的:如何查找redirect_to方法的源代码?我知道在pry中我可以执行类似show-methodmethod的操作,但我如何才能对Rails框架中的方法执行此操作?您对我如何更好地理解Gem及其API有什么建议吗?仅仅阅读源代码似乎真的很难,尤其是对于框架。谢谢! 最佳答案 Ru

我的假设是moduleAmoduleBendend和moduleA::Bend是一样的。我能够从thisblog找到解决方案,thisSOthread和andthisSOthread.为什么以及什么时候应该更喜欢紧凑语法A::B而不是另一个,因为它显然有一个缺点?我有一种直觉,它可能与性能有关,因为在更多命名空间中查找常量需要更多计算。但是我无法通过对普通类进行基准测试来验证这一点。 最佳答案 这两种写作方法经常被混淆。首先要说的是,据我所知,没有可衡量的性能差异。(在下面的书面示例中不断查找)最明显的区别,可能也是最著名的,是你的

几个月前,我读了一篇关于rubygem的博客文章,它可以通过阅读代码本身来确定编程语言。对于我的生活,我不记得博客或gem的名称。谷歌搜索“ruby编程语言猜测”及其变体也无济于事。有人碰巧知道相关gem的名称吗? 最佳答案 是这个吗:http://github.com/chrislo/sourceclassifier/tree/master 关于ruby-寻找通过阅读代码确定编程语言的rubygem?,我们在StackOverflow上找到一个类似的问题:

我目前正在使用以下方法获取页面的源代码:Net::HTTP.get(URI.parse(page.url))我还想获取HTTP状态,而无需发出第二个请求。有没有办法用另一种方法做到这一点?我一直在查看文档,但似乎找不到我要找的东西。 最佳答案 在我看来,除非您需要一些真正的低级访问或控制,否则最好使用Ruby的内置Open::URI模块:require'open-uri'io=open('http://www.example.org/')#=>#body=io.read[0,50]#=>"["200","OK"]io.base_ur

前言作为一名程序员,自己的本质工作就是做程序开发,那么程序开发的时候最直接的体现就是代码,检验一个程序员技术水平的一个核心环节就是开发时候的代码能力。众所周知,程序开发的水平提升是一个循序渐进的过程,每一位程序员都是从“菜鸟”变成“大神”的,所以程序员在程序开发过程中的代码能力也是根据平时开发中的业务实践来积累和提升的。提高代码能力核心要素程序员要想提高自身代码能力,尤其是新晋程序员的代码能力有很大的提升空间的时候,需要针对性的去提高自己的代码能力。提高代码能力其实有几个比较关键的点,只要把握住这些方面,就能很好的、快速的提高自己的一部分代码能力。1、多去阅读开源项目,如有机会可以亲自参与开源

嗨~大家好,这里是可莉!今天给大家带来的是7个C语言的经典基础代码~那一起往下看下去把【程序一】打印100到200之间的素数#includeintmain(){ inti; for(i=100;i 【程序二】输出乘法口诀表#includeintmain(){inti;for(i=1;i 【程序三】判断1000年---2000年之间的闰年#includeintmain(){intyear;for(year=1000;year 【程序四】给定两个整形变量的值,将两个值的内容进行交换。这里提供两种方法来进行交换,第一种为创建临时变量来进行交换,第二种是不创建临时变量而直接进行交换。1.创建临时变量来

@作者:SYFStrive @博客首页:HomePage📜:微信小程序📌:个人社区(欢迎大佬们加入)👉:社区链接🔗📌:觉得文章不错可以点点关注👉:专栏连接🔗💃:感谢支持,学累了可以先看小段由小胖给大家带来的街舞👉微信小程序(🔥)目录自定义组件-behaviors 1、什么是behaviors 2、behaviors的工作方式 3、创建behavior 4、导入并使用behavior 5、behavior中所有可用的节点 6、同名字段的覆盖和组合规则总结最后自定义组件-behaviors 1、什么是behaviorsbehaviors是小程序中,用于实现

文章目录git常用命令(简介,详细参数往下看)Git提交代码步骤gitpullgitstatusgitaddgitcommitgitpushgit代码冲突合并问题方法一:放弃本地代码方法二:合并代码常用命令以及详细参数gitadd将文件添加到仓库:gitdiff比较文件异同gitlog查看历史记录gitreset代码回滚版本库相关操作远程仓库相关操作分支相关操作创建分支查看分支:gitbranch合并分支:gitmerge删除分支:gitbranch-ddev查看分支合并图:gitlog–graph–pretty=oneline–abbrev-commit撤消某次提交git用户名密码相关配置g