在前面的文章中已经详细介绍了在本机上安装YOLOv5的教程,安装YOLOv5可参考前面的文章YOLOv5训练自己的数据集(超详细)https://blog.csdn.net/qq_40716944/article/details/118188085https://blog.csdn.net/qq_40716944/article/details/118188085

目录

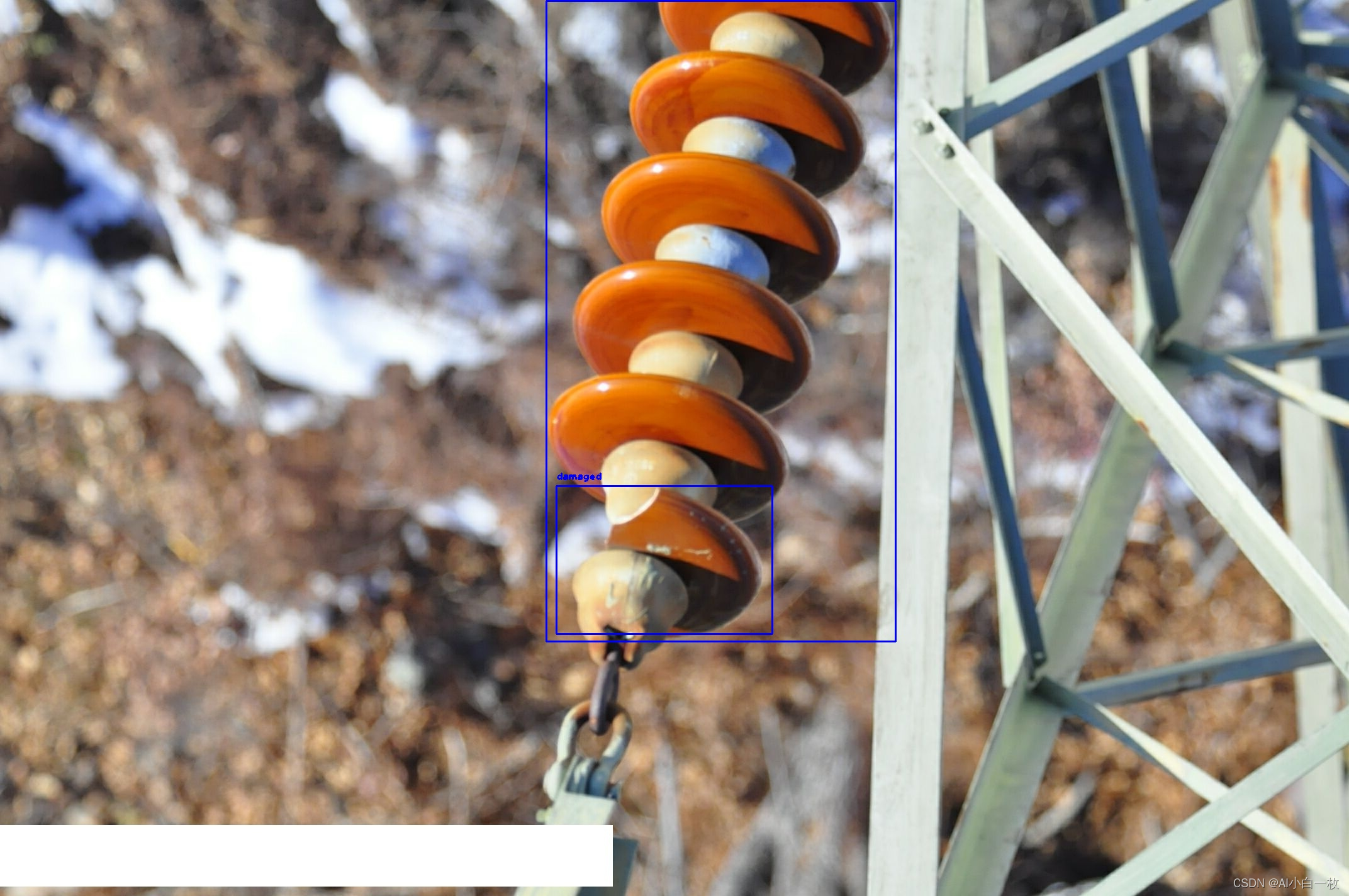

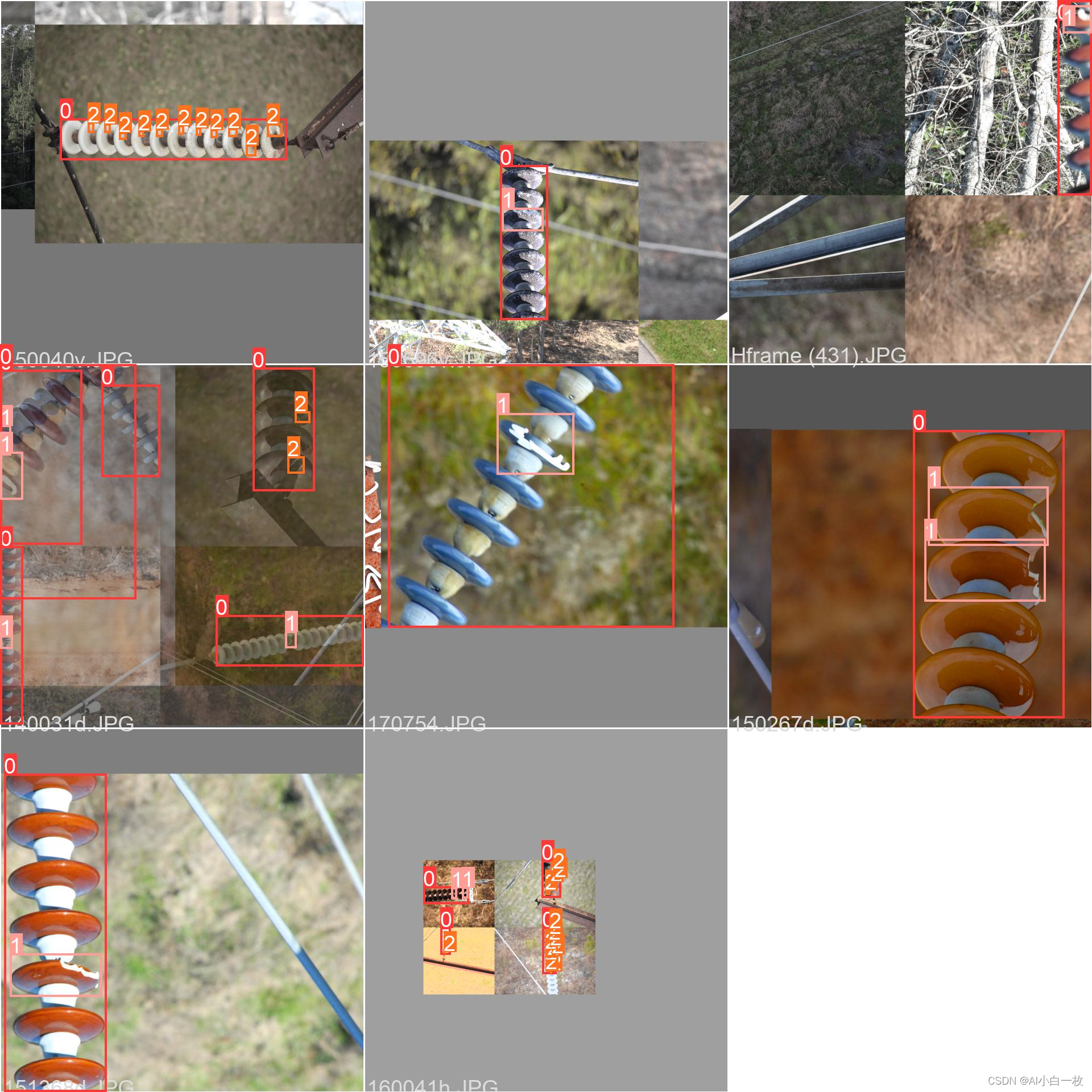

本教程主要是利用YOLOv5算法实现对输电线路绝缘子缺陷进行检测识别。通过无人机搭载相机头云台对输电线路上的绝缘子进行数据采集,挑选出绝缘子上有故障的图片数据,共2000张左右图片,输电线路绝缘子缺陷数据集中的部分图片如下图所示。

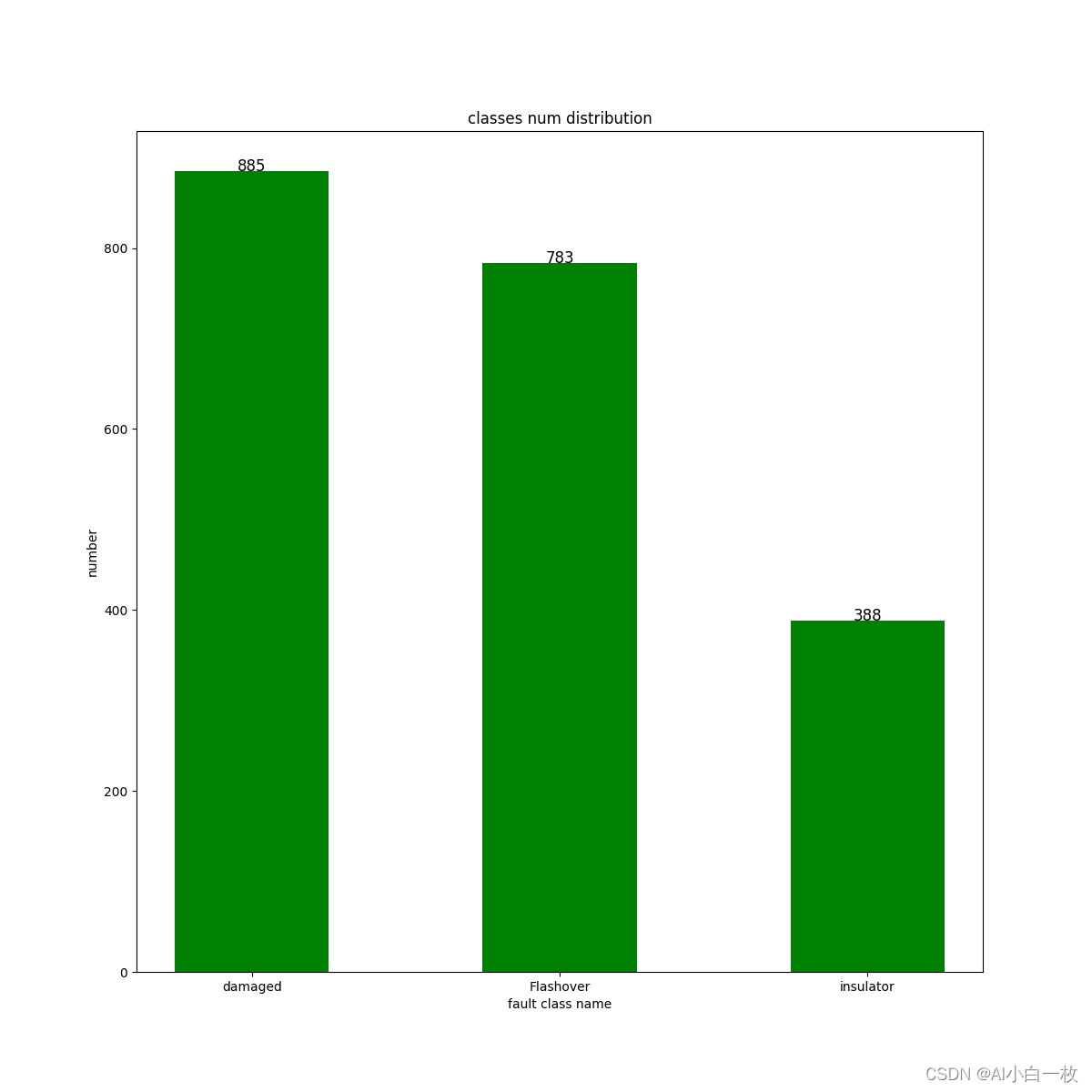

对收集到的2000张左右绝缘子缺陷数据集进行数据标注, 标注了3种常见的绝缘子缺陷类型:insulator、damaged、Flashover,利用LabelImg标注软件对数据进行标注,对标注后的数据进行统计,3种缺陷的标签分布情况如下图所示。

对收集到的2000张左右绝缘子缺陷数据集进行数据标注, 标注了3种常见的绝缘子缺陷类型:insulator、damaged、Flashover,利用LabelImg标注软件对数据进行标注,对标注后的数据进行统计,3种缺陷的标签分布情况如下图所示。

本人按照VOC格式创建数据集,具体格式如下:

├── data

│ ├── xml 进行 detection 任务时的标签文件,xml 形式,文件名与图片名一一对应

│ ├── images 存放.jpg 格式的图片文件

│ ├── labels 存放label标注信息的txt文件,与图片一一对应

│ ├── txt 存放原始标注信息,x1,y1,x2,y2,type

├── dataSet(train,val,test建议按照8:1:1比例划分)

│ ├── train.txt 写着用于训练的图片名称

│ ├── val.txt 写着用于验证的图片名称

│ ├── trainval.txt train与val的合集

│ ├── test.txt 写着用于测试的图片名称

原始的标注信息是保存成txt文件,txt文件里面的每一行都包含一个标注信息,格式为x1,y1,x2,y2,type,这里 (x1,y1) 和 (x2,y2) 是缺陷边界框的左上角和右下角,type是匹配后的整数 ID:0:insulator、1:damaged、2:Flashover。通过一下代码进行转换:

import os

import cv2

import time

from xml.dom import minidom

name_dict = {'0': 'insulator', '1': 'damaged', '2': 'Flashover'}

def transfer_to_xml(pic, txt, file_name,xml_save_path):

if not os.path.exists(xml_save_path):

os.makedirs(xml_save_path,exist_ok=True)

img = cv2.imread(pic)

img_w = img.shape[1]

img_h = img.shape[0]

img_d = img.shape[2]

doc = minidom.Document()

annotation = doc.createElement("annotation")

doc.appendChild(annotation)

folder = doc.createElement('folder')

folder.appendChild(doc.createTextNode('visdrone'))

annotation.appendChild(folder)

filename = doc.createElement('filename')

filename.appendChild(doc.createTextNode(file_name))

annotation.appendChild(filename)

source = doc.createElement('source')

database = doc.createElement('database')

database.appendChild(doc.createTextNode("Unknown"))

source.appendChild(database)

annotation.appendChild(source)

size = doc.createElement('size')

width = doc.createElement('width')

width.appendChild(doc.createTextNode(str(img_w)))

size.appendChild(width)

height = doc.createElement('height')

height.appendChild(doc.createTextNode(str(img_h)))

size.appendChild(height)

depth = doc.createElement('depth')

depth.appendChild(doc.createTextNode(str(img_d)))

size.appendChild(depth)

annotation.appendChild(size)

segmented = doc.createElement('segmented')

segmented.appendChild(doc.createTextNode("0"))

annotation.appendChild(segmented)

with open(txt, 'r') as f:

lines = [f.readlines()]

for line in lines:

for boxes in line:

box = boxes.strip('\n')

box = box.split(" ")

x_min = box[0]

y_min = box[1]

x_max = box[2]

y_max = box[3]

object_name = name_dict[box[4]]

if object_name != "background":

object = doc.createElement('object')

nm = doc.createElement('name')

nm.appendChild(doc.createTextNode(object_name))

object.appendChild(nm)

pose = doc.createElement('pose')

pose.appendChild(doc.createTextNode("Unspecified"))

object.appendChild(pose)

truncated = doc.createElement('truncated')

truncated.appendChild(doc.createTextNode("1"))

object.appendChild(truncated)

difficult = doc.createElement('difficult')

difficult.appendChild(doc.createTextNode("0"))

object.appendChild(difficult)

bndbox = doc.createElement('bndbox')

xmin = doc.createElement('xmin')

xmin.appendChild(doc.createTextNode(x_min))

bndbox.appendChild(xmin)

ymin = doc.createElement('ymin')

ymin.appendChild(doc.createTextNode(y_min))

bndbox.appendChild(ymin)

xmax = doc.createElement('xmax')

xmax.appendChild(doc.createTextNode(str(x_max)))

bndbox.appendChild(xmax)

ymax = doc.createElement('ymax')

ymax.appendChild(doc.createTextNode(str(y_max)))

bndbox.appendChild(ymax)

object.appendChild(bndbox)

annotation.appendChild(object)

with open(os.path.join(xml_save_path, file_name + '.xml'), 'w') as x:

x.write(doc.toprettyxml())

x.close()

f.close()

if __name__ == '__main__':

t = time.time()

print('Transfer .txt to .xml...ing....')

txt_folder = 'data/power_transmission_line_datasets/txt'

txt_file = os.listdir(txt_folder)

img_folder = 'data/power_transmission_line_datasets/image'

xml_save_path = 'data/power_transmission_line_datasets/xml/'

for txt in txt_file:

txt_full_path = os.path.join(txt_folder, txt)

img_full_path = os.path.join(img_folder, txt.split('.')[0] + '.jpg')

try:

transfer_to_xml(img_full_path, txt_full_path, txt.split('.')[0],xml_save_path)

except Exception as e:

print(e)

print("Transfer .txt to .XML sucessed. costed: {:.3f}s...".format(time.time() - t))主要是将数据集分类成训练数据集和测试数据集,默认train,val,test按照比例进行随机分类,运行后dataSet文件夹中会出现四个文件,主要是生成的训练数据集和测试数据集的图片名称,如下图。同时data目录下也会出现这四个文件,内容是训练数据集和测试数据集的图片路径。

import os

import random

trainval_percent = 0.9

train_percent = 0.9

xmlfilepath = 'data/power_transmission_line_datasets/xml/'

txtsavepath = 'data/power_transmission_line_datasets/dataSet/'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('data/power_transmission_line_datasets/dataSet/trainval.txt', 'w')

ftest = open('data/power_transmission_line_datasets/dataSet/test.txt', 'w')

ftrain = open('data/power_transmission_line_datasets/dataSet/train.txt', 'w')

fval = open('data/power_transmission_line_datasets/dataSet/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()

主要是将图片数据集标注后的xml文件中的标注信息读取出来并写入txt文件,运行后在label文件夹中出现所有图片数据集的标注信息。

# xml解析包

import xml.etree.ElementTree as ET

import pickle

import os

# os.listdir() 方法用于返回指定的文件夹包含的文件或文件夹的名字的列表

from os import listdir, getcwd

from os.path import join

sets = ['train', 'test', 'val']

classes = ["insulator","damaged","Flashover"]

# 进行归一化操作

def convert(size, box): # size:(原图w,原图h) , box:(xmin,xmax,ymin,ymax)

dw = 1./size[0] # 1/w

dh = 1./size[1] # 1/h

x = (box[0] + box[1])/2.0 # 物体在图中的中心点x坐标

y = (box[2] + box[3])/2.0 # 物体在图中的中心点y坐标

w = box[1] - box[0] # 物体实际像素宽度

h = box[3] - box[2] # 物体实际像素高度

x = x*dw # 物体中心点x的坐标比(相当于 x/原图w)

w = w*dw # 物体宽度的宽度比(相当于 w/原图w)

y = y*dh # 物体中心点y的坐标比(相当于 y/原图h)

h = h*dh # 物体宽度的宽度比(相当于 h/原图h)

return (x, y, w, h) # 返回 相对于原图的物体中心点的x坐标比,y坐标比,宽度比,高度比,取值范围[0-1]

def convert_annotation(image_id):

'''

将对应文件名的xml文件转化为label文件,xml文件包含了对应的bunding框以及图片长款大小等信息,

通过对其解析,然后进行归一化最终读到label文件中去,也就是说

一张图片文件对应一个xml文件,然后通过解析和归一化,能够将对应的信息保存到唯一一个label文件中去

labal文件中的格式:calss x y w h 同时,一张图片对应的类别有多个,所以对应的bounding的信息也有多个

'''

# 对应的通过year 找到相应的文件夹,并且打开相应image_id的xml文件,其对应bund文件

in_file = open('data/power_transmission_line_datasets/xml/%s.xml' % (image_id), encoding='utf-8')

# 准备在对应的image_id 中写入对应的label,分别为

# <object-class> <x> <y> <width> <height>

out_file = open('data/power_transmission_line_datasets/label/%s.txt' % (image_id), 'w', encoding='utf-8')

# 解析xml文件

tree = ET.parse(in_file)

# 获得对应的键值对

root = tree.getroot()

# 获得图片的尺寸大小

size = root.find('size')

# 如果xml内的标记为空,增加判断条件

if size != None:

# 获得宽

w = int(size.find('width').text)

# 获得高

h = int(size.find('height').text)

# 遍历目标obj

for obj in root.iter('object'):

# 获得difficult

difficult = obj.find('difficult').text

# 获得类别 =string 类型

cls = obj.find('name').text

# 如果类别不是对应在我们预定好的class文件中,或difficult==1则跳过

if cls not in classes or int(difficult) == 1:

continue

# 通过类别名称找到id

cls_id = classes.index(cls)

# 找到bndbox 对象

xmlbox = obj.find('bndbox')

# 获取对应的bndbox的数组 = ['xmin','xmax','ymin','ymax']

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

print(image_id, cls, b)

# 带入进行归一化操作

# w = 宽, h = 高, b= bndbox的数组 = ['xmin','xmax','ymin','ymax']

bb = convert((w, h), b)

# bb 对应的是归一化后的(x,y,w,h)

# 生成 calss x y w h 在label文件中

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

# 返回当前工作目录

wd = getcwd()

print(wd)

for image_set in sets:

'''

对所有的文件数据集进行遍历

做了两个工作:

1.将所有图片文件都遍历一遍,并且将其所有的全路径都写在对应的txt文件中去,方便定位

2.同时对所有的图片文件进行解析和转化,将其对应的bundingbox 以及类别的信息全部解析写到label 文件中去

最后再通过直接读取文件,就能找到对应的label 信息

'''

# 先找labels文件夹如果不存在则创建

if not os.path.exists('data/power_transmission_line_datasets/labels/'):

os.makedirs('data/power_transmission_line_datasets/labels/')

# 读取在ImageSets/Main 中的train、test..等文件的内容

# 包含对应的文件名称

image_ids = open('data/power_transmission_line_datasets/dataSet/%s.txt' % (image_set)).read().strip().split()

list_file = open('data/power_transmission_line_datasets/%s.txt' % (image_set), 'w')

# 将对应的文件_id以及全路径写进去并换行

for image_id in image_ids:

list_file.write('data/power_transmission_line_datasets/image/%s.jpg\n' % (image_id))

# 调用 year = 年份 image_id = 对应的文件名_id

convert_annotation(image_id)

# 关闭文件

list_file.close()

label文件夹中某文件内容如下:

1 0.5128302845528456 0.1638719512195122 0.012957317073170733 0.01829268292682927

1 0.5325203252032521 0.16482469512195122 0.012195121951219513 0.01791158536585366

1 0.5572916666666667 0.20579268292682928 0.011941056910569106 0.01829268292682927

1 0.42238313008130085 0.4026295731707317 0.009908536585365856 0.013338414634146341

1 0.41450711382113825 0.7050304878048781 0.009908536585365856 0.01600609756097561

1 0.005970528455284553 0.405297256097561 0.011432926829268294 0.01714939024390244

0 0.6451981707317074 0.8746189024390244 0.12372967479674798 0.12957317073170732

0 0.6006097560975611 0.5482088414634146 0.12804878048780488 0.12919207317073172

0 0.5552591463414634 0.1953125 0.1323678861788618 0.12995426829268295

0 0.3654725609756098 0.05811737804878049 0.11864837398373985 0.06897865853658537

0 0.1899136178861789 0.5483993902439025 0.13185975609756098 0.1364329268292683

0 0.02870934959349594 0.40415396341463417 0.05691056910569106 0.06211890243902439

0 0.04128556910569106 0.7789634146341464 0.08155487804878049 0.07469512195121951

0 0.2170985772357724 0.936547256097561 0.12982723577235775 0.12690548780487806

0 0.44804369918699194 0.7155106707317074 0.11153455284552846 0.078125

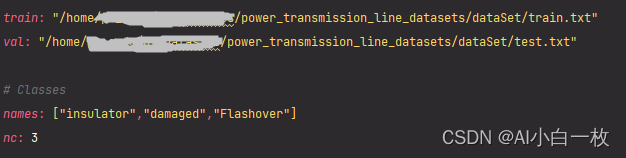

0 0.41133130081300817 0.4005335365853659 0.11077235772357724 0.07393292682926829首先需要在/yolov5-6.1/data文件夹中,新建一个power_transmission_line_datasets.yaml文件,内容设置如下:

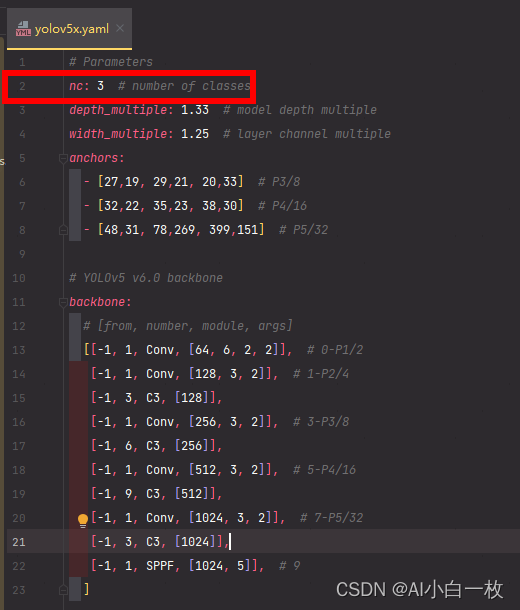

对yolov5-6.1/model文件夹中,对yolov5x.yaml(根据自己选择的模型而定)文件内容修改。

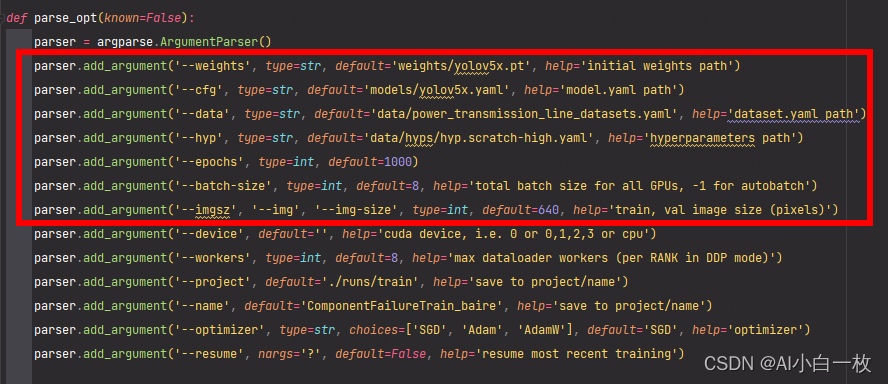

主要用到的几个参数:–weights,–cfg,–data,–epochs,–batch-size,–img-size,–project,-workers

重点注意:–weights,–cfg,–data,其他的默认即可(batch_size,workers根据自己电脑属性进行设置)。

在完成上述所有的操作之后,就可以进行训练,在命令窗口输入python train.py即可以进行训练。

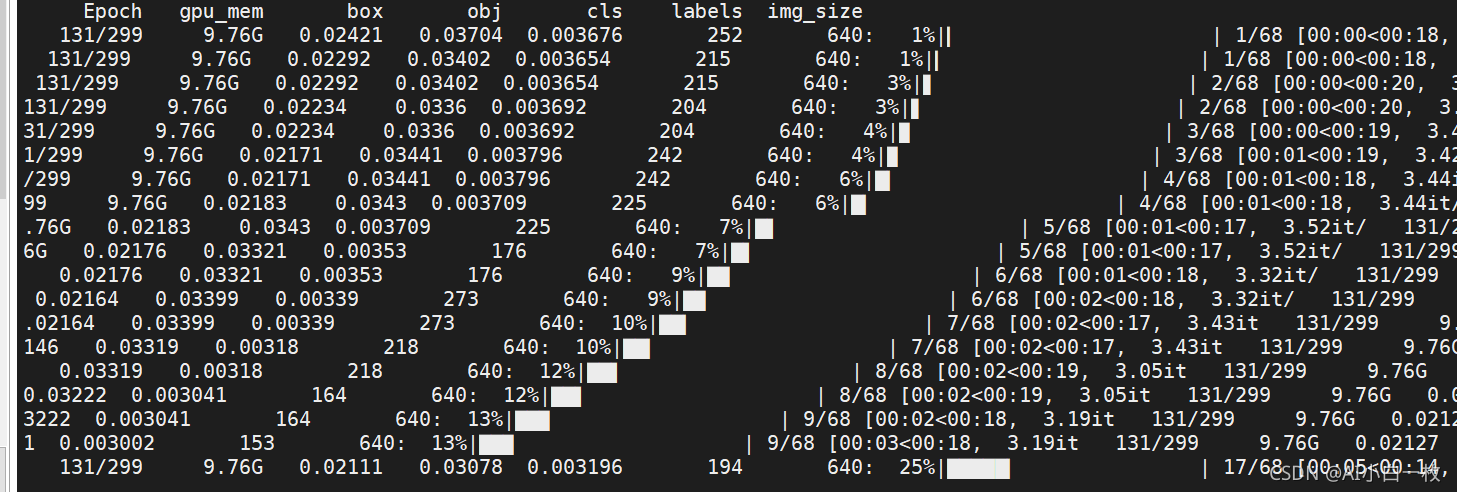

可以看出,输入数据在送入yolov5训练时是成批次的,且采用了多种数据增强方法,如下图所示。

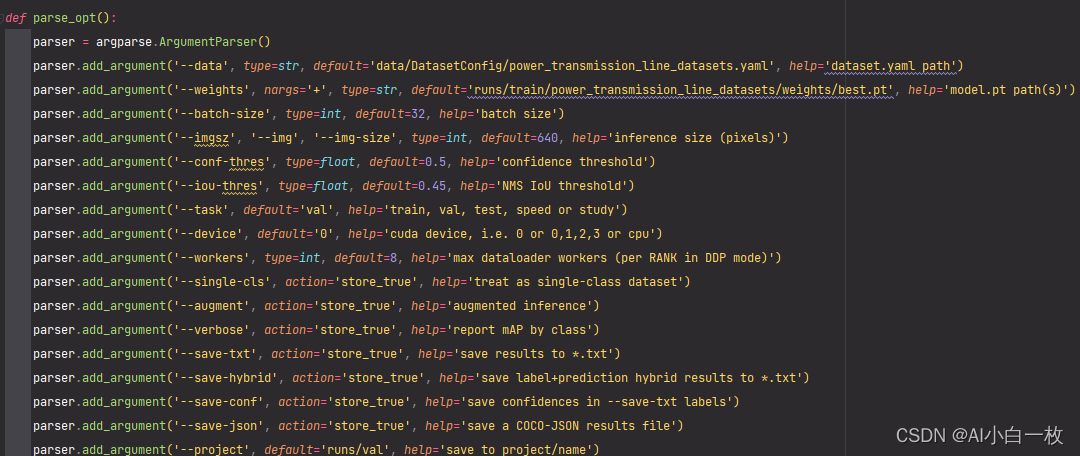

在训练完成后可以利用测试集对训练后的模型进行测试,利用val.py文件进行测试,主要修改一下地方:

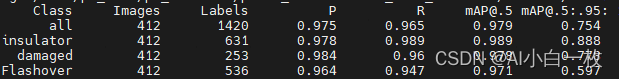

测试完成后会输出map、precision、recall等指标,具体如下图所示:

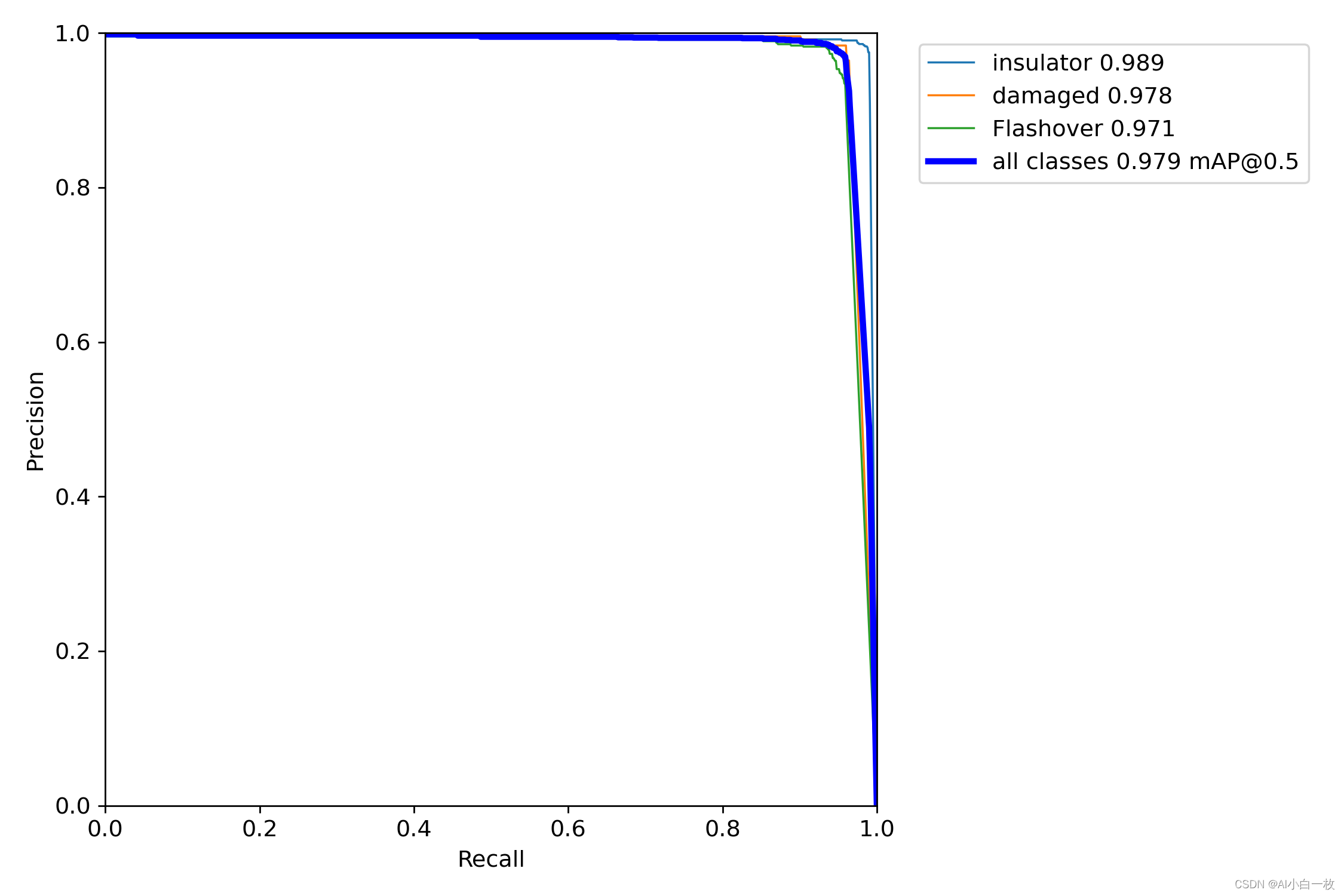

P-R曲线如下图所示:

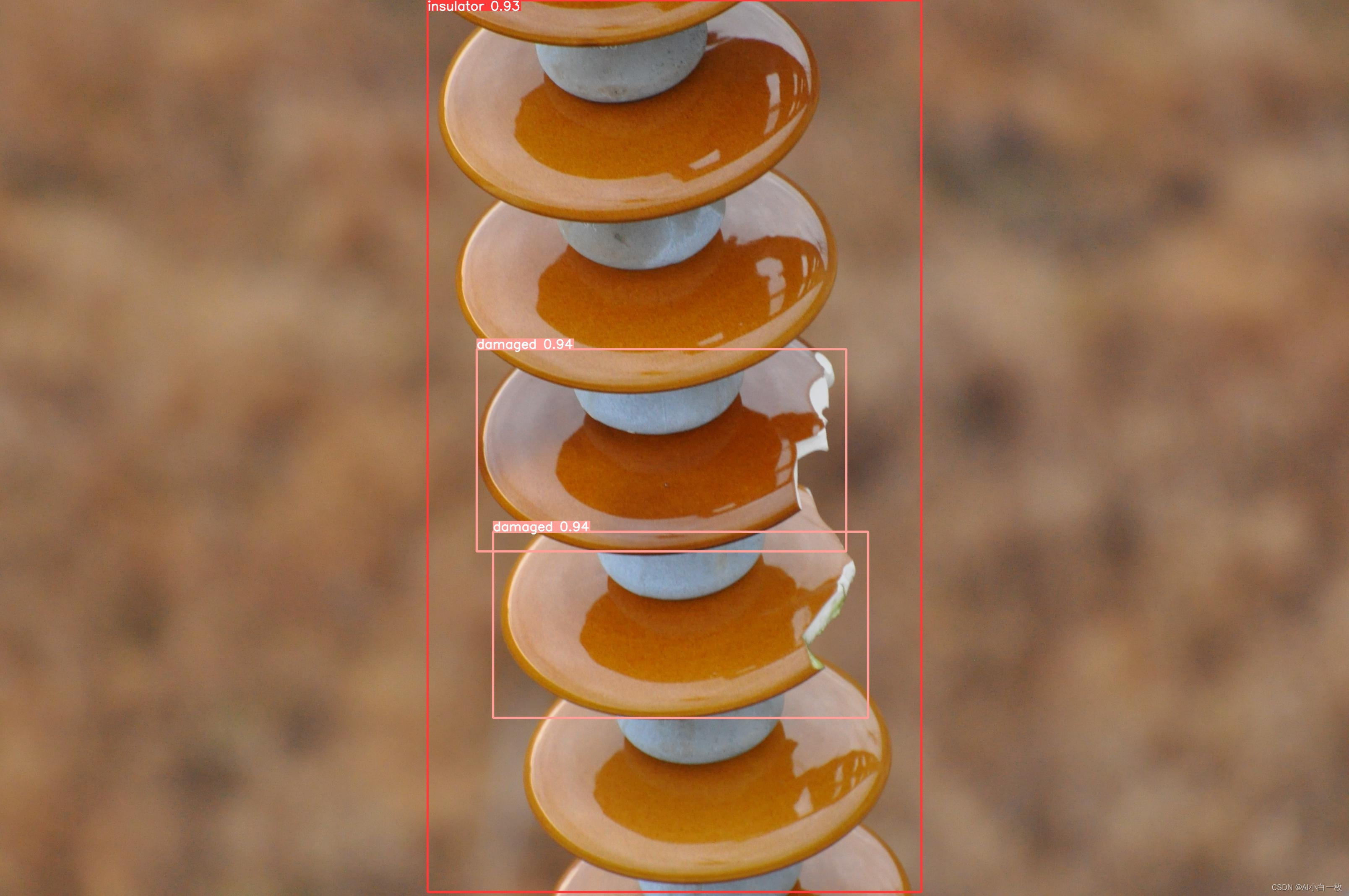

同时也可以利用detect.py文件对测试集进行测试,将检测后的框绘制在图像上,部分测试结果如下图所示:

我收到这个错误:RuntimeError(自动加载常量Apps时检测到循环依赖当我使用多线程时。下面是我的代码。为什么会这样?我尝试多线程的原因是因为我正在编写一个HTML抓取应用程序。对Nokogiri::HTML(open())的调用是一个同步阻塞调用,需要1秒才能返回,我有100,000多个页面要访问,所以我试图运行多个线程来解决这个问题。有更好的方法吗?classToolsController0)app.website=array.join(',')putsapp.websiteelseapp.website="NONE"endapp.saveapps=Apps.order("

导读语言模型给我们的生产生活带来了极大便利,但同时不少人也利用他们从事作弊工作。如何规避这些难辨真伪的文字所产生的负面影响也成为一大难题。在3月9日智源Live第33期活动「DetectGPT:判断文本是否为机器生成的工具」中,主讲人Eric为我们讲解了DetectGPT工作背后的思路——一种基于概率曲率检测的用于检测模型生成文本的工具,它可以帮助我们更好地分辨文章的来源和可信度,对保护信息真实、防止欺诈等方面具有重要意义。本次报告主要围绕其功能,实现和效果等展开。(文末点击“阅读原文”,查看活动回放。)Ericmitchell斯坦福大学计算机系四年级博士生,由ChelseaFinn和Chri

之前说过10之后的版本没有3dScan了,所以还是9.8的版本或者之前更早的版本。 3d物体扫描需要先下载扫描的APK进行扫面。首先要在手机上装一个扫描程序,扫描现实中的三维物体,然后上传高通官网,在下载成UnityPackage类型让Unity能够使用这个扫描程序可以从高通官网上进行下载,是一个安卓程序。点到Tools往下滑,找到VuforiaObjectScanner下载后解压数据线连接手机,将apk文件拷入手机安装然后刚才解压文件中的Media文件夹打开,两个PDF图打印第一张A4-ObjectScanningTarget.pdf,主要是用来辅助扫描的。好了,接下来就是扫描三维物体。将瓶

Heroku支持人员告诉我,为了在我的Web应用程序中使用自定义字体(未安装在系统中,您可以在bash控制台中使用fc-list查看已安装的字体)我必须部署一个包含所有字体的.fonts文件夹里面的字体。问题是我不知道该怎么做。我的意思是,我不知道文件名是否必须遵循heroku的任何特殊模式,或者我必须在我的代码中做一些事情来考虑这种字体,或者如果我将它包含在文件夹中它是自动的......事实是,我尝试以不同的方式更改字体的文件名,但根本没有使用该字体。为了提供更多详细信息,我们使用字体的过程是将PDF转换为图像,更具体地说,使用rghostgem。并且最终图像根本不使用自定义字体。在

@作者:SYFStrive @博客首页:HomePage📜:微信小程序📌:个人社区(欢迎大佬们加入)👉:社区链接🔗📌:觉得文章不错可以点点关注👉:专栏连接🔗💃:感谢支持,学累了可以先看小段由小胖给大家带来的街舞👉微信小程序(🔥)目录自定义组件-behaviors 1、什么是behaviors 2、behaviors的工作方式 3、创建behavior 4、导入并使用behavior 5、behavior中所有可用的节点 6、同名字段的覆盖和组合规则总结最后自定义组件-behaviors 1、什么是behaviorsbehaviors是小程序中,用于实现

在我让另一个人重做我的前端UI之前,我的Rails应用程序运行平稳。我已经尝试解决此错误3天了。这是错误:Nosuchfileordirectory-identifyExtractedsource(aroundline#59):575859606162@post=Post.find(params[:id])authorize@postif@post.update_attributes(post_params)flash[:notice]="Postwasupdated."redirect_to[@topic,@post]else{"utf8"=>"✓","_method"=>"patc

有几种方法:first_or_create_by、find_or_create_by等,它们的工作原理是:与数据库对话以尝试找到我们想要的东西如果我们找不到,就自己做保存到数据库显然,并发调用这些方法可能会使两个线程都找不到它们想要的东西,并且在第3步中一个线程会意外失败。似乎更好的解决方案是,创建或查找即:提前在您的数据库中创建合理的唯一性约束。如果你想保存一些东西,就保存它如果有效,那就太好了。如果它因为RecordNotUnique异常而无法工作,它已经存在,太好了,加载它那么在什么情况下我想使用Rails内置的东西而不是我自己的(看起来更可靠)create_or_find?

我想知道我的代码是否在rspec下运行。这可能吗?原因是我正在加载一些错误记录器,这些记录器在测试期间会被故意错误(expect{x}.toraise_error)弄得乱七八糟。我查看了我的ENV变量,没有(明显的)测试环境变量的迹象。 最佳答案 在spec_helper.rb的开头添加:ENV['RACK_ENV']='test'现在您可以在代码中检查RACK_ENV是否经过测试。 关于ruby-检测由RSpec、Ruby运行的代码,我们在StackOverflow上找到一个类似的问题

我正在使用rubydaemongem。想知道如何向停止操作添加一些额外的步骤?希望我能检测到停止被调用,并向其添加一些额外的代码。任何人都知道我如何才能做到这一点? 最佳答案 查看守护程序gem代码,它似乎没有用于此目的的明显扩展点。但是,我想知道(在守护进程中)您是否可以捕获守护进程在发生“停止”时发送的KILL/TERM信号...?trap("TERM")do#executeyourextracodehereend或者你可以安装一个at_exit钩子(Hook):-at_exitdo#executeyourextracodehe

如果我们有一个数组array=[1,1,0,0,2,3,0,0,0,3,3,3]我们如何识别给定数字的运行(具有相同值的连续数字的数量)?例如:run_pattern_for(array,0)->2run_pattern_for(array,3)->1run_pattern_for(array,1)->1run_pattern_for(array,2)->0没有2的运行,因为没有连续出现2。3有一个运行,因为只有一个幻影以树为连续数字。 最佳答案 尝试:classArraydefcount_runs(element)chunk{|n