仿佛一夜之间,AI 圈出现了一个新晋顶流:AutoGPT。

顾名思义,AutoGPT 为自主人工智能,一项任务交给它,它能自主地提出计划,然后执行,完全不用人类插手的那种。此外其还具有互联网访问、使用 GPT-3.5 进行文件存储和生成摘要等功能。

例如,用户让 AutoGPT 建立一个网站,提出的要求是让其创建一个表单,并在表单上添加标题「Made with autogpt」,最后将背景更改为蓝色,用时不到 3 分钟,不用人类参与,AutoGPT 自己就搞定了,就像下面展示的那样。期间 AutoGPT 采用的 React 和 Tailwind CSS,都是自己决定的。

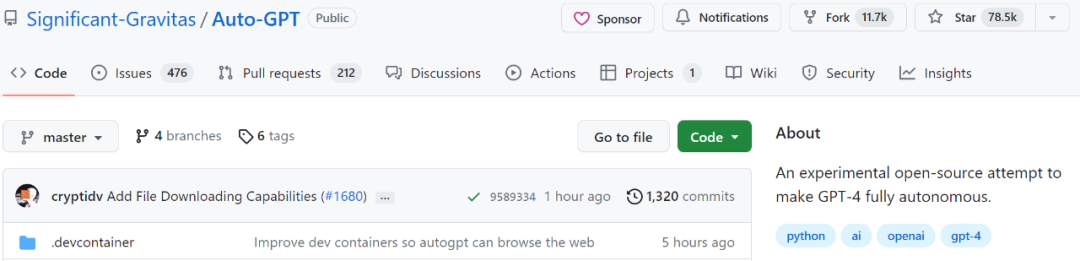

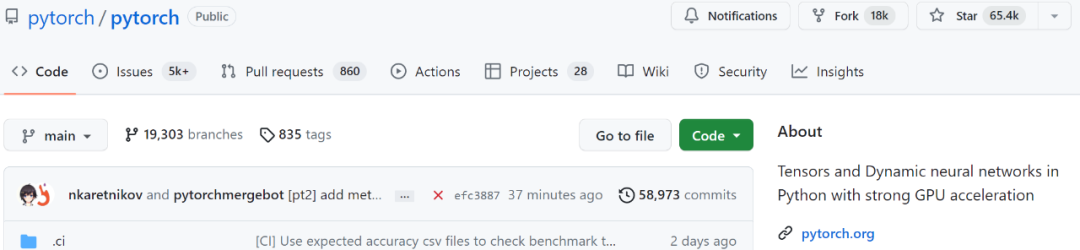

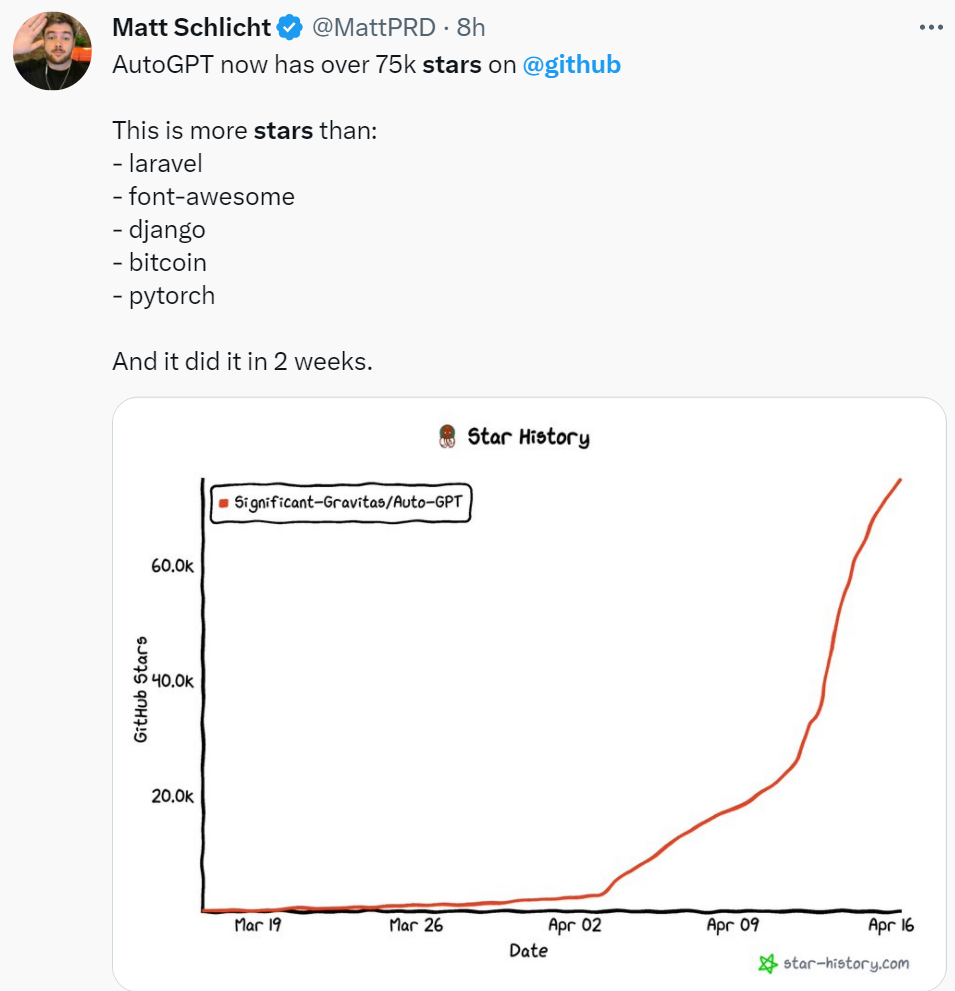

一个示例看下来,AutoGPT 已经能够自己上网查资料、使用第三方工具、操作你的电脑。从上线以来,项目热度不减,截至今天,AutoGPT 的 GitHub Star 量达到 78k,马上接近 80k,超过了 PyTorch 的 65k。

AutoGPT 地址:https://github.com/torantulino/auto-gpt

PyTorch 地址:https://github.com/pytorch/pytorch

要知道,AutoGPT 是一个刚上线没几天的项目,而 PyTorch 的最初版本可追溯到 2018 年。不仅如此,从推特网友的总结来看,AutoGPT 还超过了 Bitcoin、 Django 等项目的 Star 量。

图源:https://twitter.com/MattPRD/status/1647653434760515584

就连前特斯拉 AI 总监、刚刚回归 OpenAI 的 Andrej Karpathy 对此都评价道:「AutoGPT 是 prompt 工程的下一个前沿。」

不过,与看好 AutoGPT 发展不同的是,来自英伟达的 AI 科学家 Jim Fan 却对此泼了一盆冷水。

Jim Fan 表示自己仅将 AutoGPT 视为一项有趣的实验,仅此而已,而且这项研究虽然火爆但并不意味着可以投入生产,网上很多酷炫的演示都是精心挑选出来的。

随后,Jim Fan 还表示,在其实验中「AutoGPT 可以很好地解决某些简单且定义明确的任务,但大多数时候对真正有用的、更难的任务,AutoGPT 并不可靠。

这种不可靠性可以归因于 GPT-4 固有的局限性。如果不能访问 GPT-4 权重或者更好的微调,我认为仅仅通过提示技巧无法从根本上解决问题。

就像没有任何提示可以将 GPT-3 变成 GPT-4 的能力一样,我不认为 AutoGPT + 冻结的 GPT-4 可以可靠地解决重要的复杂决策。当前的媒体炒作正在将该项目推向完全不切实际的期望。」

Jim Fan 的观点获得了很多人的赞同。有人认为,「诚然,AutoGPT 是一个伟大的实验,并将引领通过智能体自主完成很多酷炫事情的浪潮。但它不能成为一个可以构筑解决任何商业问题基础的产品,毕竟太不可预测了。」

光说不练没有说服力,有人现身说法,表示自己整个周六都在让 AutoGPT 打开一个 docx 文档、打开其导出的 ChatGPT 对话以提供更多上下文(json)、浏览其他技术内容并重写 docx 文档。遗憾的是,AutoGPT 甚至都未能接近达成这些目标,还是放弃吧。

这类体验例子还有很多,有人针对现实世界的问题尝试大量 prompt,但 AutoGPT 总是朝着没有任何意义的不同方向发展。

在很多人赞同 Jim Fan 观点的同时,也有人指出,虽然 AutoGPT 肯定被夸大了,并且现在非常「蛮力」、不优雅。但它展示的前景仍然非常强大,几乎与 GPT 模型相当。

有人从应用的角度剖析 AutoGPT 的不足,目前它虽然无法很好地解决很多事情,比如循环(loop)、切线、随机完成不同的任务。但要弄清楚的是,AutoGPT 需要大量的脑力,预计它会变得越来越好。

持上述观点的不是个例,「AutoGPT 肯定会随时间推移而愈加完善。像这样的项目两年前就已经成为了可能,尽管在任意通用域上的可靠使用也许只能在数年而非数月内到来。」

机器之心的读者们,你们认为 AutoGPT 会是昙花一现吗?看不看好它的前景呢?请在评论区留下自己的观点吧!

Anaconda+PyCharm+PyTorch(GPU)+虚拟环境声明一、安装Anaconda二、安装PyCharm三、创建虚拟环境并安装PyTorch四、关联虚拟环境五、致谢声明感谢姜小敏同学对我的支持、鼓励和鞭策!默认你的电脑上已经装有GPU,如果没有GPU,可以正常的进行各种下载安装操作,但是最终结果会有所不同。一、安装Anaconda首先,进入Anaconda官网,单击Download按钮,稍微等待即可下载安装包。下载好之后,双击打开安装包,进行一系列安装操作。建议安装路径全英文,并且一定要记住安装地址。此处不勾选第二项,因此之后需要人为配置环境变量。没啥用,不用勾选,就是跳出两个打

关闭。这个问题是opinion-based.它目前不接受答案。想要改进这个问题?更新问题,以便editingthispost可以用事实和引用来回答它.关闭8年前。Improvethisquestion我非常想尝试Opal在一个新的Rails项目中,但风险当然是我不会发现它不能做什么,直到我花了数百小时做其他所有事情,然后遇到一堵砖墙我不可能打通。它有什么局限性?例如(当然,如果还有其他值得一提的限制,答案不应该仅限于这些主题)我假设你不能在你的Opal代码中使用任何旧的Ruby库(但我很乐意发现我错了!)。我还猜测使用任意JavaScript库可能会有困难,或者在某些情况下您需要编写J

我目前正在尝试使用GitHubAPI(v3)检查并查看repo是否由经过身份验证的用户加注星标。我可以成功列出由登录用户加星标的repo协议(protocol),但在检查repo协议(protocol)是否由用户加星标时我似乎无法正常工作。例如..(GET)/user/starred?access_token=...正确返回我已加星标的完整repo列表。(GET)/user/starred/joynet/node?access_token=...始终返回状态404,无论我使用哪种所有者/repo组合,或者我是否真的对该repo加注星标。我还应该注意到,除了(GET)/user/star

目录简介torch.nn.init.xavier_uniform_()语法作用举例参考结语简介Hello!非常感谢您阅读海轰的文章,倘若文中有错误的地方,欢迎您指出~ ଘ(੭ˊᵕˋ)੭昵称:海轰标签:程序猿|C++选手|学生简介:因C语言结识编程,随后转入计算机专业,获得过国家奖学金,有幸在竞赛中拿过一些国奖、省奖…已保研学习经验:扎实基础+多做笔记+多敲代码+多思考+学好英语! 唯有努力💪 本文仅记录自己感兴趣的内容torch.nn.init.xavier_uniform_()语法torch.nn.init.xavier_uniform_(tensor,gain=1.0)作用根据了解训练深度

一、报错信息之前写代码时碰到了这样一个错误:RuntimeError:Expectedtohavefinishedreductionintheprioriterationbeforestartinganewone.Thiserrorindicatesthatyourmodulehasparametersthatwerenotusedinproducingloss.Youcanenableunusedparameterdetectionby(1)passingthekeywordargumentfind_unused_parameters=Truetotorch.nn.parallel.Dist

前言本项目使用了EcapaTdnn模型实现的声纹识别,不排除以后会支持更多模型,同时本项目也支持了多种数据预处理方法,损失函数参考了人脸识别项目的做法PaddlePaddle-MobileFaceNets,使用了ArcFaceLoss,ArcFaceloss:AdditiveAngularMarginLoss(加性角度间隔损失函数),对特征向量和权重归一化,对θ加上角度间隔m,角度间隔比余弦间隔在对角度的影响更加直接。源码地址:VoiceprintRecognition-Pytorch(V1)使用环境:Python3.7PaddlePaddle1.10.2模型下载模型预处理方法数据集类别数量分

一觉醒来,ChatGPT大面积封号的消息突然炸了。据传闻,受影响的账户已经达到了数百万,亚洲是重灾区,其中不少都是国内的账号。社交媒体上哀鸿遍野,网友纷纷表示自己的账号忽然就被封禁了,没有得到任何警告。就连花了一百多块开通Plus会员的账号,都未能幸免于难。来源:ChatGPT深海论坛不过值得注意的是,OpenAI从来没有给以下国家和地区开通ChatGPT服务:中国(包括中国香港)、伊朗、俄罗斯,以及非洲部分地区。而前两天意大利主动封禁ChatGPT这事,可以说是首例了。一些猜测根据网友、蓝点网、硕博生活圈等来源的猜测,可能的原因如下:1.批量注册:通过相同或类似IP地址批量注册的账号2.IP

pytorch1.13安装,个人参考情况交代安装流程注意事项显卡配置查看创建环境激活环境安装对应的torch版本检查使用piplist导入查看卸载下载gpu版本的验证把这个内核加到jupyter完成情况交代显卡3060,cuda版本12.0已有一个虚拟环境安装了cuda11.2和cudnn8.1.0以及对应的tensorflow现在需要创建一个可以使用GPU加速的pytorch环境安装流程注意事项pytorch自身是带了cuda环境的,所以不需要强制要求和之前tensorflow那个环境一致torch1.13.0不支持cuda10.2和11.3版本了显卡配置查看nvidia-smi+-----

【人工智能概论】PyTorch可视化工具Tensorboard安装与简单使用文章目录【人工智能概论】PyTorch可视化工具Tensorboard安装与简单使用一.安装Tensorboard1.1安装Tensorboard1.2验证安装二.Tensorboard功能简介一.安装Tensorboard1.1安装TensorboardTensorboard原本是Tensorflow的可视化工具,但自PyTorch1.2.0版本开始,PyTorch正式内置Tensorboard的支持,尽管如此仍需手动安装Tensorboard。否则会报错。ModuleNotFoundError:Nomodulena

Pytorch是目前最火的深度学习框架之一,另一个是TensorFlow。不过我之前一直用到是CPU版本,几个月前买了一台3070Ti的笔记本(是的,我在40系显卡出来的时候,买了30系,这确实一言难尽),同时我也有一台M1芯片MacbookPro,目前也支持了pytorch的GPU加速,所以我就想着,在这两个电脑上装个Pytorch,浅度学习深度学习。Applesilicon首先是M1芯片,这个就特别简单了。先装一个conda,只不过是内置mamba包管理器,添加conda-forge频道,arm64版本。#下载wgethttps://github.com/conda-forge/minif