文章目录

大家好,我是阿光。

本专栏整理了《图神经网络代码实战》,内包含了不同图神经网络的相关代码实现(PyG以及自实现),理论与实践相结合,如GCN、GAT、GraphSAGE等经典图网络,每一个代码实例都附带有完整的代码。

正在更新中~ ✨

🚨 我的项目环境:

💥 项目专栏:【图神经网络代码实战目录】

本文我们将使用Pytorch + Pytorch Geometric来简易实现一个Node2Vec,让新手可以理解如何PyG来搭建一个简易的图网络实例demo。

本项目我们需要结合两个库,一个是Pytorch,因为还需要按照torch的网络搭建模型进行书写,第二个是PyG,因为在torch中并没有关于图网络层的定义,所以需要torch_geometric这个库来定义一些图层。

import matplotlib.pyplot as plt

import torch

from sklearn.manifold import TSNE

from torch_geometric.datasets import Planetoid

from torch_geometric.nn import Node2Vec

本文使用的数据集是比较经典的Cora数据集,它是一个根据科学论文之间相互引用关系而构建的Graph数据集合,论文分为7类,共2708篇。

这个数据集是一个用于图节点分类的任务,数据集中只有一张图,这张图中含有2708个节点,10556条边,每个节点的特征维度为1433。

# 1.加载Cora数据集

dataset = Planetoid(root='./data/Cora', name='Cora')

本项目是使用 Node2Vec 来生成每个节点的特征,所以对于原始节点特征是无用的,本项目只是单纯利用 Cora 数据集的节点空间关系,也就是 edge_index ,基于节点的空间关系来生成对应的节点特征,最终验证生成的节点特征效果如何。

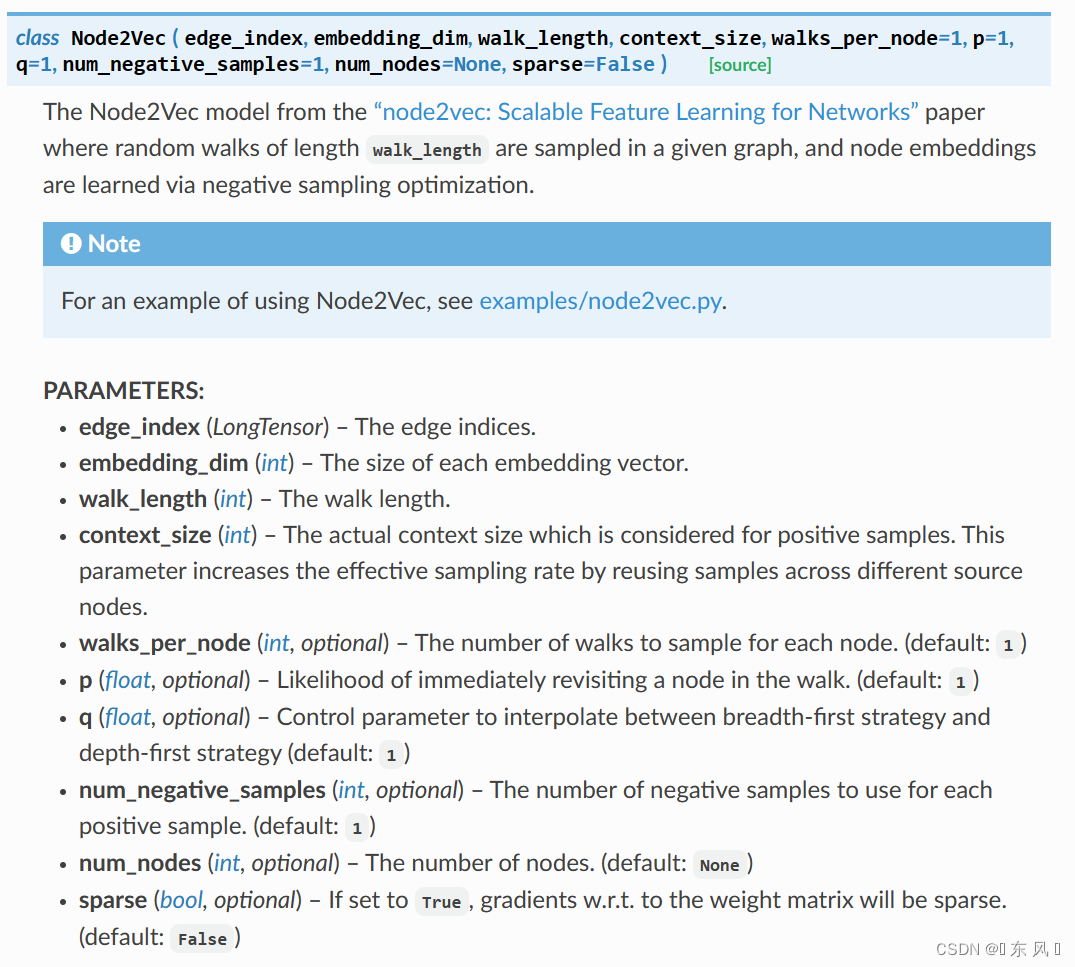

这里我们就不重点介绍Node2Vec了,相信大家能够掌握基本原理,本文我们使用的是PyG定义这个网络,在PyG中已经定义好了 Node2Vec 这个层,该层采用的就是 Node2Vec 机制。

对于Node2Vec的常用参数:

data 的 edge_index,形状为【2,num_edges】# node2vec模型

model = Node2Vec(edge_index=data.edge_index,

embedding_dim=128, # 节点维度嵌入长度

walk_length=5, # 序列游走长度

context_size=4, # 上下文大小

walks_per_node=1, # 每个节点游走10个序列

p=1,

q=1,

sparse=True # 权重设置为稀疏矩阵

).to(device)

上面我们定义了一个 node2vec 模型,对于第一个参数就是 Cora 的边集,第二个参数就是经过训练每个节点的Embedding的维度,第三个参数是序列游走长度,这里设置的为5,也就是经过游走会生成长度为5的节点序列,例如【0,1284,345,94,2031】,对于 context_size 这个参数代表上下文大小,如果设置为4,针对上面数据我们会生成两个向量用于训练,分别是【0,1284,345,94】和【1284,345,94,2031】,可以看到就是滑动了一下。

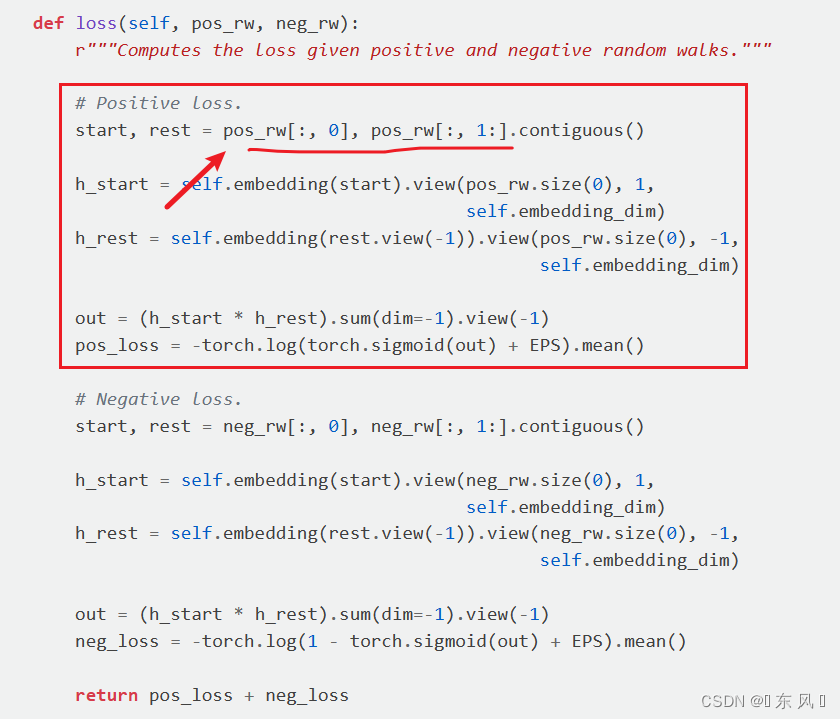

感兴趣可以查看下源码:

对于 p 和 q 就是在游走时设定的概率超参,可以根据实际情况进行调整,如果都是1就是 DeepWalk 机制,walks_per_node 这个参数代表每个节点会生成多少个游走序列,值越大,模型更加稳定,生成的 Embedding 更加健壮。

下面就是定义了一些模型需要的参数,像学习率、迭代次数这些超参数,然后是模型的定义以及优化器及损失函数的定义,和pytorch定义网络是一样的。

# 迭代器

loader = model.loader(batch_size=128, shuffle=True)

# 优化器

optimizer = torch.optim.SparseAdam(model.parameters(), lr=0.01)

模型训练部分也是和pytorch定义网络一样,因为都是需要经过前向传播、反向传播这些过程,对于损失、精度这些指标可以自己添加。

# 3.开始训练

model.train()

for epoch in range(1, 101):

total_loss = 0 # 每个epoch的总损失

for pos_rw, neg_rw in loader:

optimizer.zero_grad()

loss = model.loss(pos_rw.to(device), neg_rw.to(device)) # 计算损失

loss.backward()

optimizer.step()

total_loss += loss.item()

# 使用逻辑回归任务进行测试生成的embedding效果

with torch.no_grad():

model.eval() # 开启测试模式

z = model() # 获取权重系数,也就是embedding向量表

# z[data.train_mask] 获取训练集节点的embedding向量

acc = model.test(z[data.train_mask], data.y[data.train_mask],

z[data.test_mask], data.y[data.test_mask],

max_iter=150) # 内部使用LogisticRegression进行分类测试

# 打印指标

print(f'Epoch: {epoch:02d}, Loss: {total_loss:.4f}, Acc: {acc:.4f}')

在训练的过程中,我们会进行验证生成的节点Embedding效果如何,可以利用 Node2Vec.test() 这个函数,这个函数内部实现了 LogisticRegression() 来实现分类任务,它就是为了验证生成的 Embedding 在下游的任务中效果如何,如果有其它下游任务(就是利用生成的节点Embedding做什么任务,常见就是节点分类),可以改成对应代码。

上面我们以经训练好了 Node2Vec 这个模型,通过调用 model() 即可获得内部的权重矩阵,也就是我们要的Embedding向量表(lookup table)。

生成好每个节点的 Embedding,我们可以通过可视化的方式更加直观的看到效果如何,对于可视化操作我们利用的是 TSNE 这个模块来进行降维,因为绘制二维图形需要x轴和y轴坐标(即二维),降到两个维度后,就获得了每个节点的坐标信息,然后利用 matplotlib 这个库来绘制不同类别的节点信息。

# 可视化节点的embedding

with torch.no_grad():

# 不同类别节点对应的颜色信息

colors = [

'#ffc0cb', '#bada55', '#008080', '#420420', '#7fe5f0', '#065535',

'#ffd700'

]

model.eval() # 开启测试模式

# 获取节点的embedding向量,形状为[num_nodes, embedding_dim]

z = model(torch.arange(data.num_nodes, device=device))

# 使用TSNE先进行数据降维,形状为[num_nodes, 2]

z = TSNE(n_components=2).fit_transform(z.detach().numpy())

y = data.y.detach().numpy()

plt.figure(figsize=(8, 8))

# 绘制不同类别的节点

for i in range(dataset.num_classes):

# z[y==0, 0] 和 z[y==0, 1] 分别代表第一个类的节点的x轴和y轴的坐标

plt.scatter(z[y == i, 0], z[y == i, 1], s=20, color=colors[i])

plt.axis('off')

plt.show()

import matplotlib.pyplot as plt

import torch

from sklearn.manifold import TSNE

from torch_geometric.datasets import Planetoid

from torch_geometric.nn import Node2Vec

# 1.加载Cora数据集

dataset = Planetoid(root='../data/Cora', name='Cora')

data = dataset[0]

# 2.定义模型

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') # 设备

# node2vec模型

model = Node2Vec(edge_index=data.edge_index,

embedding_dim=128, # 节点维度嵌入长度

walk_length=5, # 序列游走长度

context_size=4, # 上下文大小

walks_per_node=1, # 每个节点游走1个序列

p=1,

q=1,

sparse=True # 权重设置为稀疏矩阵

).to(device)

# 迭代器

loader = model.loader(batch_size=128, shuffle=True)

# 优化器

optimizer = torch.optim.SparseAdam(model.parameters(), lr=0.01)

# 3.开始训练

model.train()

for epoch in range(1, 101):

total_loss = 0 # 每个epoch的总损失

for pos_rw, neg_rw in loader:

optimizer.zero_grad()

loss = model.loss(pos_rw.to(device), neg_rw.to(device)) # 计算损失

loss.backward()

optimizer.step()

total_loss += loss.item()

# 使用逻辑回归任务进行测试生成的embedding效果

with torch.no_grad():

model.eval() # 开启测试模式

z = model() # 获取权重系数,也就是embedding向量表

# z[data.train_mask] 获取训练集节点的embedding向量

acc = model.test(z[data.train_mask], data.y[data.train_mask],

z[data.test_mask], data.y[data.test_mask],

max_iter=150) # 内部使用LogisticRegression进行分类测试

# 打印指标

print(f'Epoch: {epoch:02d}, Loss: {total_loss:.4f}, Acc: {acc:.4f}')

# 可视化节点的embedding

with torch.no_grad():

# 不同类别节点对应的颜色信息

colors = [

'#ffc0cb', '#bada55', '#008080', '#420420', '#7fe5f0', '#065535',

'#ffd700'

]

model.eval() # 开启测试模式

# 获取节点的embedding向量,形状为[num_nodes, embedding_dim]

z = model(torch.arange(data.num_nodes, device=device))

# 使用TSNE先进行数据降维,形状为[num_nodes, 2]

z = TSNE(n_components=2).fit_transform(z.detach().numpy())

y = data.y.detach().numpy()

plt.figure(figsize=(8, 8))

# 绘制不同类别的节点

for i in range(dataset.num_classes):

# z[y==0, 0] 和 z[y==0, 1] 分别代表第一个类的节点的x轴和y轴的坐标

plt.scatter(z[y == i, 0], z[y == i, 1], s=20, color=colors[i])

plt.axis('off')

plt.show()

我即将开始一个将录制和编辑音频文件的项目,我正在寻找一个好的库(最好是Ruby,但会考虑Java或.NET以外的任何库)以进行实时可视化波形。有人知道我应该从哪里开始搜索吗? 最佳答案 要流入浏览器的数据量很大。Flash或Flex图表可能是唯一能提高内存效率的解决方案。Javascript图表往往会因大型数据集而崩溃。 关于ruby-Ruby中的波形可视化,我们在StackOverflow上找到一个类似的问题: https://stackoverflow.c

导读:随着叮咚买菜业务的发展,不同的业务场景对数据分析提出了不同的需求,他们希望引入一款实时OLAP数据库,构建一个灵活的多维实时查询和分析的平台,统一数据的接入和查询方案,解决各业务线对数据高效实时查询和精细化运营的需求。经过调研选型,最终引入ApacheDoris作为最终的OLAP分析引擎,Doris作为核心的OLAP引擎支持复杂地分析操作、提供多维的数据视图,在叮咚买菜数十个业务场景中广泛应用。作者|叮咚买菜资深数据工程师韩青叮咚买菜创立于2017年5月,是一家专注美好食物的创业公司。叮咚买菜专注吃的事业,为满足更多人“想吃什么”而努力,通过美好食材的供应、美好滋味的开发以及美食品牌的孵

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

需求:要创建虚拟机,就需要给他提供一个虚拟的磁盘,我们就在/opt目录下创建一个10G大小的raw格式的虚拟磁盘CentOS-7-x86_64.raw命令格式:qemu-imgcreate-f磁盘格式磁盘名称磁盘大小qemu-imgcreate-f磁盘格式-o?1.创建磁盘qemu-imgcreate-fraw/opt/CentOS-7-x86_64.raw10G执行效果#ls/opt/CentOS-7-x86_64.raw2.安装虚拟机使用virt-install命令,基于我们提供的系统镜像和虚拟磁盘来创建一个虚拟机,另外在创建虚拟机之前,提前打开vnc客户端,在创建虚拟机的时候,通过vnc

我正在寻找用于Rails的优质管理插件。似乎大多数现有的插件/gem(例如“restful_authentication”、“acts_as_authenticated”)都围绕着self注册等展开。但是,我正在寻找一种功能齐全的基于管理/管理角色的解决方案——但不是简单地附加到另一个非基于角色的解决方案。如果我找不到,我想我会自己动手......只是不想重新发明轮子。 最佳答案 RyanBates最近做了两个关于授权的railscast(注意身份验证和授权之间的区别;身份验证检查用户是否如她所说的那样,授权检查用户是否有权访问资源

我正在根据Rakefile中的现有测试文件动态生成测试任务。假设您有各种以模式命名的单元测试文件test_.rb.所以我正在做的是创建一个以“测试”命名空间内的文件名命名的任务。使用下面的代码,我可以用raketest:调用所有测试require'rake/testtask'task:default=>'test:all'namespace:testdodesc"Runalltests"Rake::TestTask.new(:all)do|t|t.test_files=FileList['test_*.rb']endFileList['test_*.rb'].eachdo|task|n

我想要像“嘿那里”这样的东西变成,例如,#316583。我希望将任意长度的字符串“归结”为十六进制颜色。我不知道从哪里开始。我在想,每个字符串的MD5散列都是不同的-但如何将该散列转换为十六进制颜色数字? 最佳答案 你可以只取几位前几位:require'digest/md5'color=Digest::MD5.hexdigest('Mytext')[0..5] 关于ruby-如何使用Ruby基于字母数字字符串生成颜色?,我们在StackOverflow上找到一个类似的问题:

我有一个包含多个组件的存储库,其中大部分是用JavaScript(Node.js)编写的,一个是用Ruby(RubyonRails)编写的。我想要一个.travis.yml文件来触发一个运行每个组件的所有测试的构建。根据thisTravisCIGoogleGroupthread,目前还没有官方支持。我的目录结构是这样的:.├──构建服务器├──核心├──扩展├──网络应用├──流浪文件├──package.json├──.travis.yml└──生成文件我希望能够运行特定版本的Ruby(2.2.2)和Node.js(0.12.2)。我已经有了一个make目标,所以maketest在每

文章目录1.自动驾驶实战:基于Paddle3D的点云障碍物检测1.1环境信息1.2准备点云数据1.3安装Paddle3D1.4模型训练1.5模型评估1.6模型导出1.7模型部署效果附录show_lidar_pred_on_image.py1.自动驾驶实战:基于Paddle3D的点云障碍物检测项目地址——自动驾驶实战:基于Paddle3D的点云障碍物检测课程地址——自动驾驶感知系统揭秘1.1环境信息硬件信息CPU:2核AI加速卡:v100总显存:16GB总内存:16GB总硬盘:100GB环境配置Python:3.7.4框架信息框架版本:PaddlePaddle2.4.0(项目默认框架版本为2.3

按照目前的情况,这个问题不适合我们的问答形式。我们希望答案得到事实、引用或专业知识的支持,但这个问题可能会引发辩论、争论、投票或扩展讨论。如果您觉得这个问题可以改进并可能重新打开,visitthehelpcenter指导。关闭9年前。多年来,我一直在使用多种语言进行编程,并且认为自己总体上相当擅长。但是,我从未编写过任何自动化测试:没有单元测试,没有TDD,没有BDD,什么都没有。我已经尝试开始为我的项目编写适当的测试套件。我可以看到在进行任何更改后能够自动测试项目中所有代码的理论值(value)。我可以看到像RSpec和Mocha这样的测试框架应该如何使设置和运行所述测试变得相当容易