ES高阶语法

消费端代码:https://gitee.com/suisui9857/hotel-demo

发送端代码:https://gitee.com/suisui9857/hotel-admin

聚合(aggregations)可以让我们极其方便的实现对数据的统计、分析、运算。例如:

实现这些统计功能的比数据库的sql要方便的多,而且查询速度非常快,可以实现近实时搜索效果。

聚合常见的有三类:

桶(Bucket) 聚合:用来对文档做分组

度量(Metric) 聚合:对文档数据做计算,比如:最大值、最小值、平均值等

管道(pipeline) 聚合:基于其它聚合的结果再做聚合

注意: 参加聚合的字段必须是keyword、日期、数值、布尔类型

统计所有数据中的酒店品牌有几种,其实就是按照品牌对数据分组

GET /hotel/_search

{

"size": 0, // 设置size为0,结果中不包含文档,只包含聚合结果

"aggs": { // 定义聚合

"brandAgg": { //给聚合起个名字

"terms": { // 聚合的类型,按照品牌值聚合,所以选择term

"field": "brand", // 参与聚合的字段

"size": 20 // 希望获取的聚合结果数量

}

}

}

}

默认情况下,Bucket聚合会统计Bucket内的文档数量,记为_count,并且按照_count降序排序。可以自定义聚合的排序方式:

GET /hotel/_search

{

"size": 0,

"aggs": {

"brandAgg": {

"terms": {

"field": "brand",

"order": {

"_count": "asc" // 按照_count升序排列

},

"size": 20

}

}

}

}

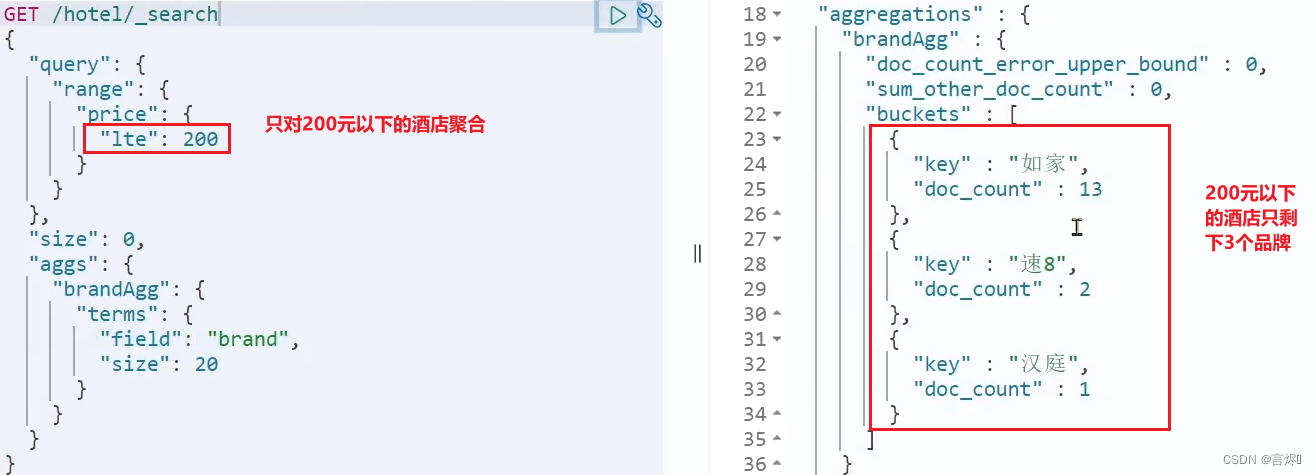

默认情况下,Bucket聚合是对索引库的所有文档做聚合,但真实场景下,用户会输入搜索条件,因此聚合必须是对搜索结果聚合。可以限定要聚合的文档范围,只要添加query条件即可:

GET /hotel/_search

{

"query": {

"range": {

"price": {

"lte": 200 // 只对200元以下的文档聚合

}

}

},

"size": 0,

"aggs": {

"brandAgg": {

"terms": {

"field": "brand",

"size": 20

}

}

}

}

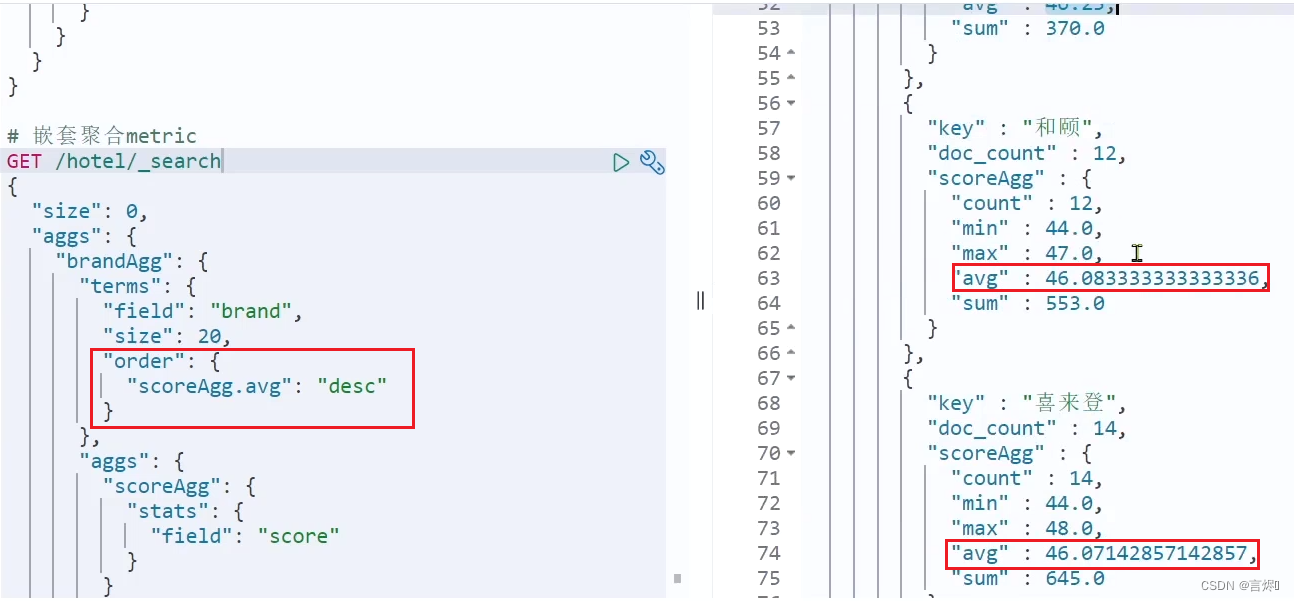

酒店按照品牌分组,形成了一个个桶。对桶内的酒店做运算,获取每个品牌的用户评分的min、max、avg等值。

GET /hotel/_search

{

"size": 0,

"aggs": {

"brandAgg": {

"terms": {

"field": "brand",

"size": 20

},

"aggs": { // 是brands聚合的子聚合,也就是分组后对每组分别计算

"score_stats": { // 聚合名称

"stats": { // 聚合类型,这里stats可以计算min、max、avg等

"field": "score" // 聚合字段,这里是score

}

}

}

}

}

}

aggs代表聚合,与query同级,此时query的作用是?

限定聚合的文档范围

聚合必须的三要素:

聚合名称,聚合类型,聚合字段

聚合可配置属性有:

size:指定聚合结果数量

order:指定聚合结果排序方式

field:指定聚合字段

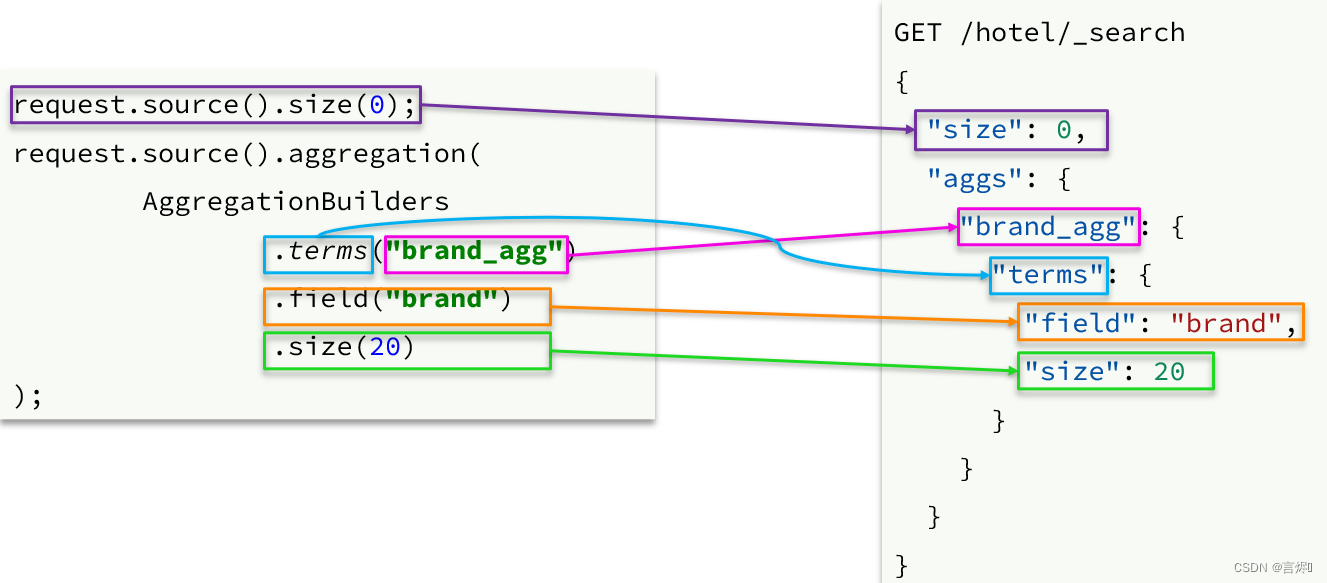

聚合条件与query条件同级别,因此需要使用request.source()来指定聚合条件。

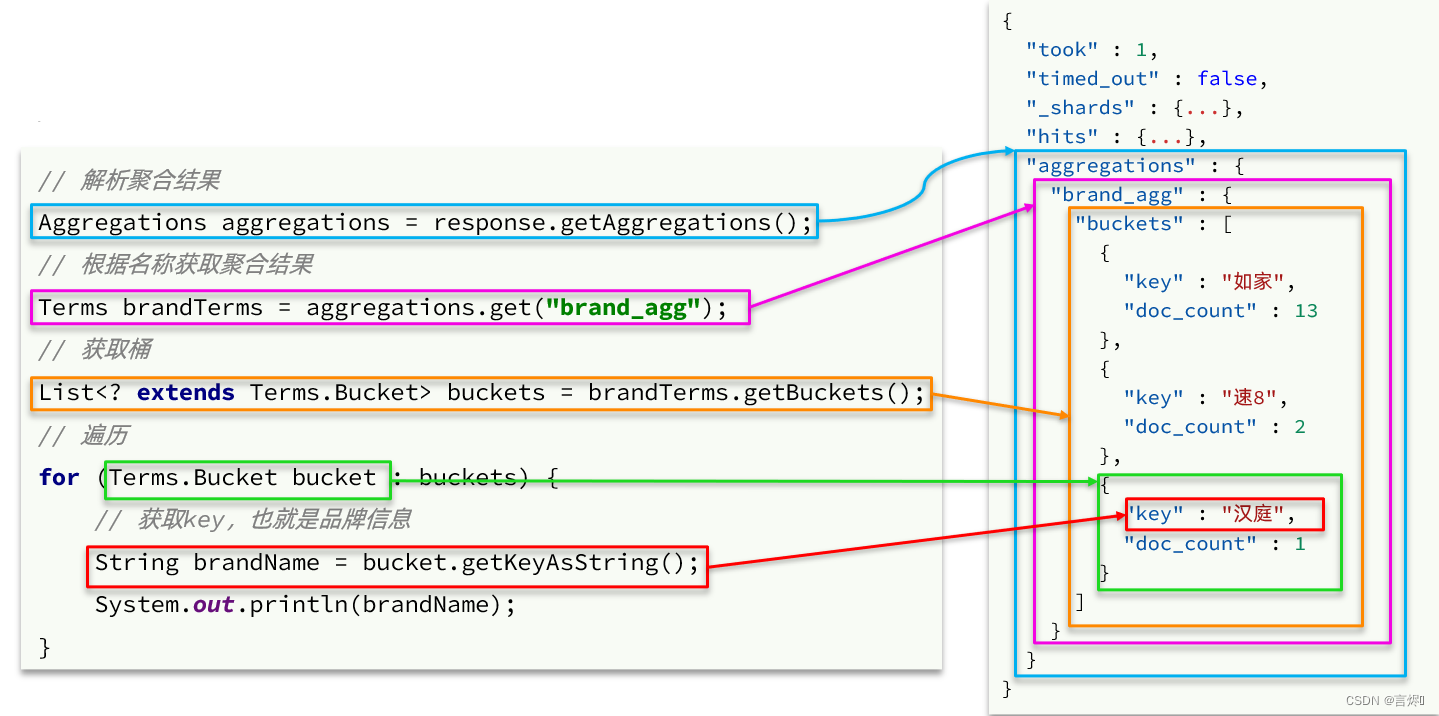

聚合的结果也与查询结果不同,API也比较特殊。不过同样是JSON逐层解析:

代码示例:

@Test

void testAggregation() throws IOException {

//1.准备request

SearchRequest request = new SearchRequest("hotel");

//2.准备DSL

//2.1设置size

request.source().size(0);

//2.2聚合

request.source().aggregation(AggregationBuilders

//聚合名称,要聚合的字段,数量

.terms("brandAgg").field("brand").size(10));

//3.发送请求

SearchResponse response = client.search(request, RequestOptions.DEFAULT);

//4.解析结果

Aggregations aggregations = response.getAggregations();

//根据聚合名称获取结果

Terms brandAgg = aggregations.get("brandAgg");

//获取桶

List<? extends Terms.Bucket> buckets = brandAgg.getBuckets();

//遍历

for (Terms.Bucket bucket : buckets) {

//获取key

String brandName = bucket.getKeyAsString();

long docCount = bucket.getDocCount();

System.out.println(brandName+":"+docCount); //7天酒店:30。。。

}

}

案例一: 搜索页面的品牌、城市等信息不应该是在页面写死,而是通过聚合索引库中的酒店数据得来的。

搜索结果中包含哪些城市,页面就应该列出哪些城市;搜索结果中包含哪些品牌,页面就应该列出哪些品牌。因此使用聚合功能,利用Bucket聚合,对搜索结果中的文档基于品牌分组、基于城市分组,就能得知包含哪些品牌、哪些城市了。

@Override

public Map<String, List<String>> getFilters() {

try {

//1.准备request

SearchRequest request = new SearchRequest("hotel");

//2.准备DSL

//2.1设置size

request.source().size(0);

//2.2聚合

buildAggregation(request);

//3.发送请求

SearchResponse response = client.search(request, RequestOptions.DEFAULT);

//4.解析结果

Map<String,List<String>> result = new HashMap<>();

List<String> brandList = getAggByName(response,"brandAgg");

//放入map

result.put("品牌",brandList);

List<String> cityList = getAggByName(response,"cityAgg");

//放入map

result.put("城市",cityList);

List<String> starList = getAggByName(response,"starAgg");

//放入map

result.put("星级",starList);

return result;

} catch (IOException e) {

throw new RuntimeException();

}

}

//根据聚合获取聚合结果

private List<String> getAggByName(SearchResponse response,String aggName) {

Aggregations aggregations = response.getAggregations();

//根据聚合名称获取结果

Terms brandAgg = aggregations.get(aggName);

//获取桶

List<? extends Terms.Bucket> buckets = brandAgg.getBuckets();

List<String> brandList = new ArrayList<>();

//遍历

for (Terms.Bucket bucket : buckets) {

//获取key

String key = bucket.getKeyAsString();

brandList.add(key);

}

return brandList;

}

//构建聚合

private void buildAggregation(SearchRequest request) {

request.source().aggregation(AggregationBuilders

//聚合名称,要聚合的字段,数量

.terms("brandAgg").field("brand").size(100));

request.source().aggregation(AggregationBuilders

//城市

.terms("cityAgg").field("city").size(100));

request.source().aggregation(AggregationBuilders

//星级

.terms("starAgg").field("starName").size(100));

}

测试:

@Test

void ContextLoads(){

Map<String, List<String>> filters = hotelService.getFilters();

System.out.println(filters);

}

结果如下:

{品牌=[7天酒店, 如家, 皇冠假日, 速8, 万怡, 华美达, 和颐, 万豪, 喜来登, 希尔顿, 汉庭, 凯悦, 维也纳, 豪生, 君悦, 万丽, 丽笙], 星级=[二钻, 五钻, 四钻, 五星级, 三钻, 四星级], 城市=[上海, 北京, 深圳]}

因为是对搜索结果聚合,因此聚合是限定范围的聚合,也就是说聚合的限定条件跟搜索文档的条件一致。

编写controller:

@PostMapping("filters")

public Map<String, List<String>> getFilters(@RequestBody RequestParams params){

return hotelService.getFilters(params);

}

HotelService中添加RequestParam参数:

@Override

public Map<String, List<String>> getFilters(RequestParams params) {

try {

//1.准备request

SearchRequest request = new SearchRequest("hotel");

//2.准备DSL

//设置query

buildBasicQuery(params,request);

//2.1设置size

request.source().size(0);

//2.2聚合

buildAggregation(request);

//3.发送请求

SearchResponse response = client.search(request, RequestOptions.DEFAULT);

//4.解析结果

Map<String,List<String>> result = new HashMap<>();

List<String> brandList = getAggByName(response,"brandAgg");

//放入map

result.put("品牌",brandList);

List<String> cityList = getAggByName(response,"cityAgg");

//放入map

result.put("城市",cityList);

List<String> starList = getAggByName(response,"starAgg");

//放入map

result.put("星级",starList);

return result;

} catch (IOException e) {

throw new RuntimeException();

}

}

//查询条件

private void buildBasicQuery(RequestParams params,SearchRequest request) {

//1.构建BooleanQuery

BoolQueryBuilder boolQuery = QueryBuilders.boolQuery();

//关键字搜索

String key = params.getKey();

if(key == null || "".equals(key)){

boolQuery.must(QueryBuilders.matchAllQuery());

}else {

boolQuery.must(QueryBuilders.matchQuery("all", key));

}

//条件过滤

//城市

if(params.getCity() != null && !"".equals(params.getCity())){

boolQuery.filter(QueryBuilders.termQuery("city", params.getCity()));

}

//品牌

if(params.getBrand() != null && !"".equals(params.getBrand())){

boolQuery.filter(QueryBuilders.termQuery("brand", params.getBrand()));

}

//星级

if(params.getStarName() != null && !"".equals(params.getStarName())){

boolQuery.filter(QueryBuilders.termQuery("starName", params.getStarName()));

}

//价格

if(params.getMinPrice() != null && params.getMaxPrice() != null){

boolQuery.filter(QueryBuilders.rangeQuery("price").gte(params.getMinPrice()).lte(params.getMaxPrice()));

}

//2.算分,添加原始算分,构建算分控制

FunctionScoreQueryBuilder functionScoreQuery =

QueryBuilders.functionScoreQuery(

//原始查询,相关性算分的查询

boolQuery,

//function score的数组

new FunctionScoreQueryBuilder.FilterFunctionBuilder[]{

//其中一个function score元素

new FunctionScoreQueryBuilder.FilterFunctionBuilder(

//过滤条件

QueryBuilders.termQuery("isAD",true),

//算分函数,权重*10

ScoreFunctionBuilders.weightFactorFunction(10)

)

});

// 7.放入source

request.source().query(functionScoreQuery);

}

实现动态过滤项:

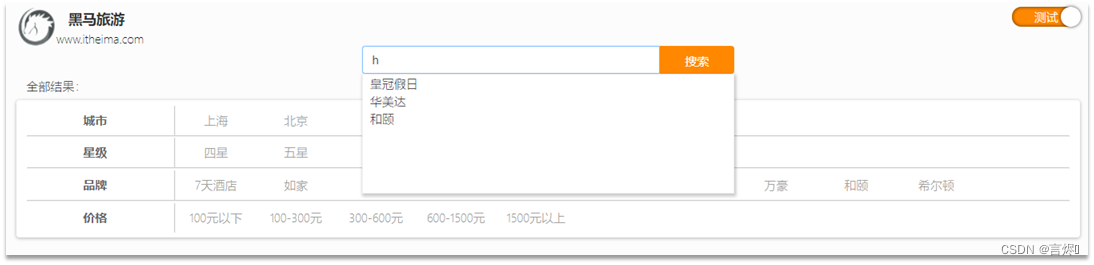

当用户在搜索框输入字符时,我们应该提示出与该字符有关的搜索项,如图:

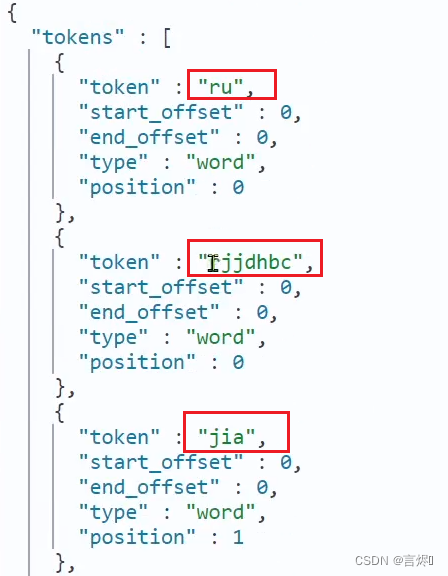

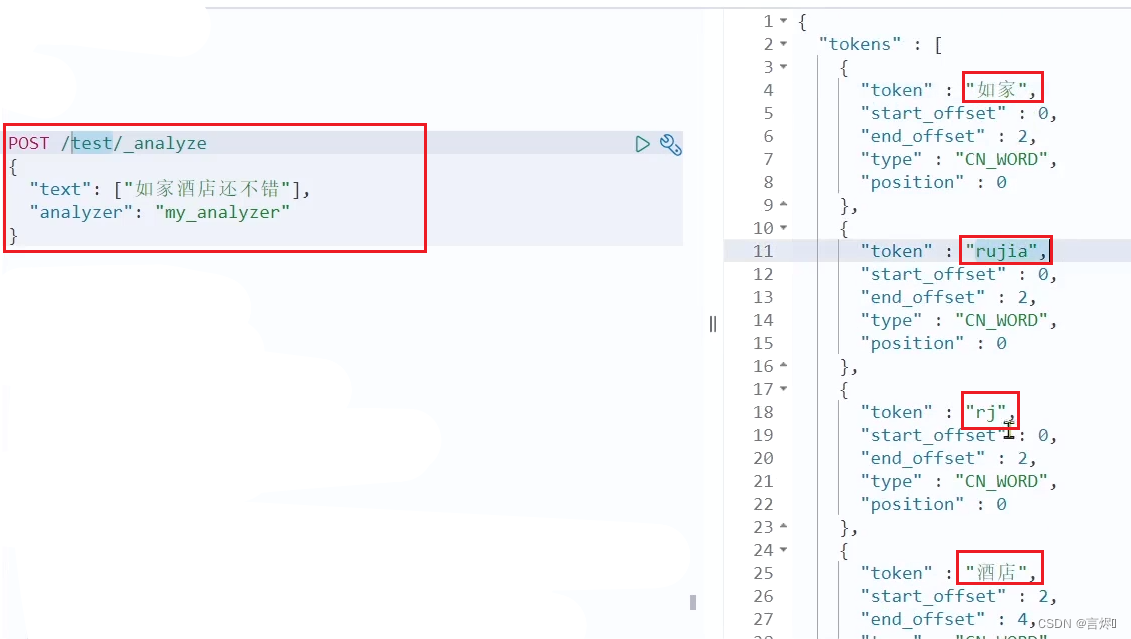

拼音分词器: 实现根据字母做补全,必须对文档按照拼音分词。GitHub上elasticsearch的拼音分词插件。地址:https://github.com/medcl/elasticsearch-analysis-pinyin

安装方式与IK分词器一样:1.解压 2.上传到虚拟机中,elasticsearch的plugin目录 3.重启elasticsearch 4.测试

POST /_analyze

{

"text": "如家酒店还不错",

"analyzer": "pinyin"

}

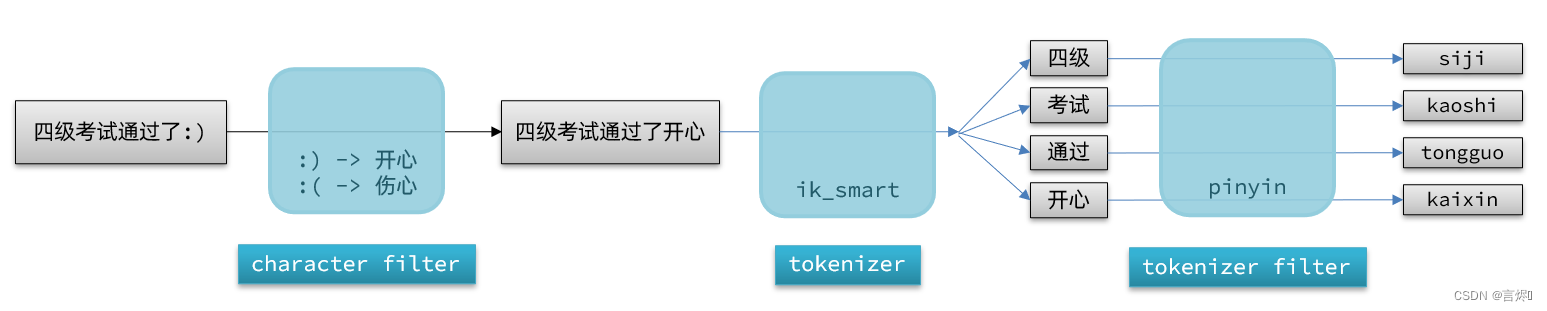

elasticsearch中分词器(analyzer)的组成包含三部分:

声明自定义分词器的语法如下:

PUT /test1

{

"settings": {

"analysis": {

"analyzer": {

"my_analyzer": {

"tokenizer": "ik_max_word",

"filter": "py"

}

},

"filter": {

"py": {

"type": "pinyin",

"keep_full_pinyin": false,

"keep_joined_full_pinyin": true,

"keep_original": true,

"limit_first_letter_length": 16,

"remove_duplicated_term": true,

"none_chinese_pinyin_tokenize": false

}

}

}

}

}

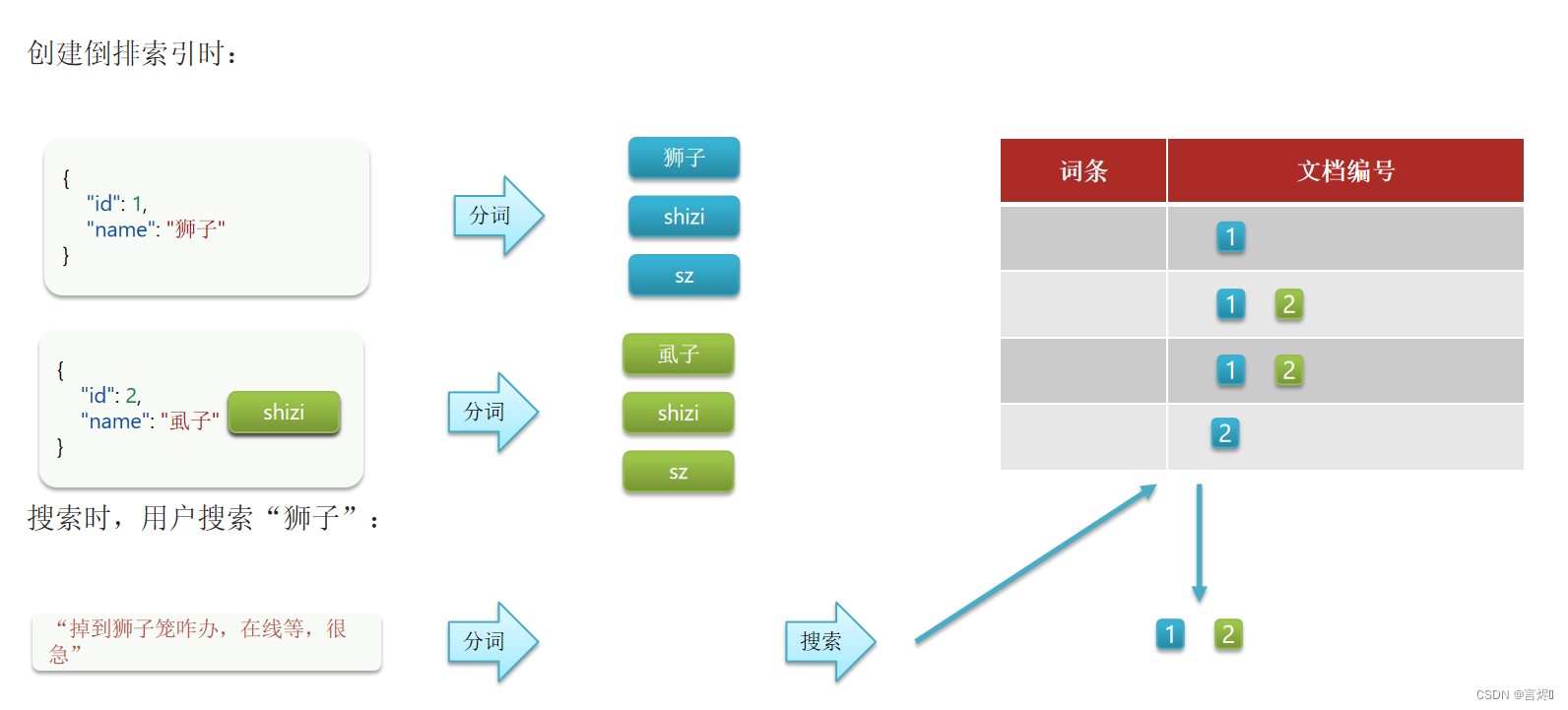

写入文档:

POST /test1/_doc/1

{

"id": 1,

"name": "狮子"

}

POST /test1/_doc/2

{

"id": 2,

"name": "虱子"

}

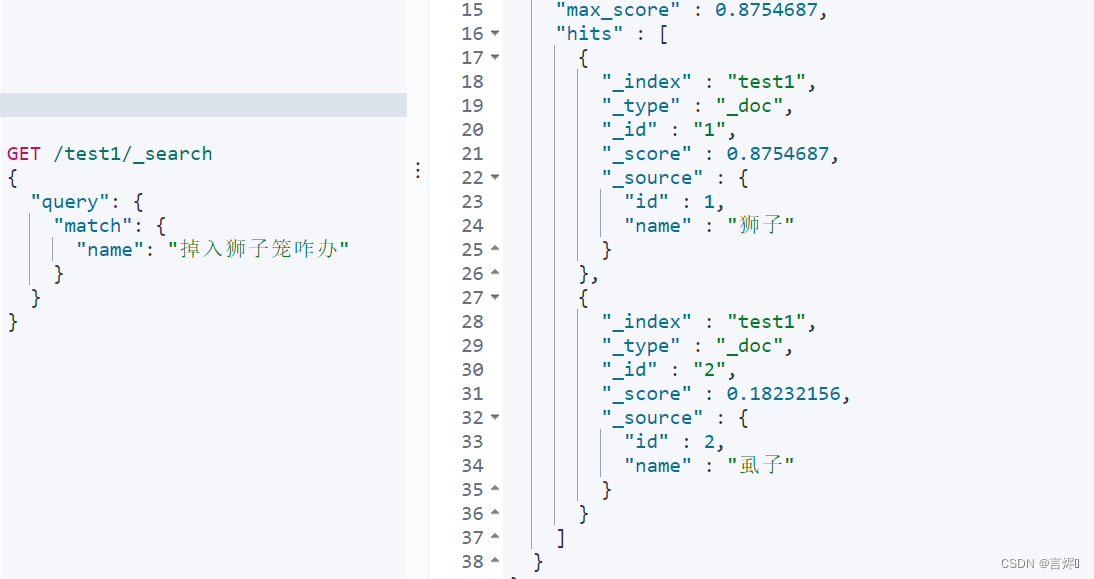

搜索数据:

GET /test/_search

{

"query": {

"match": {

"name": "掉入狮子笼咋办"

}

}

}

拼音分词器适合在创建倒排索引的时候使用,但不能在搜索的时候使用。

所以当用户输入中文时用中文去搜,用户输入拼英时用拼英搜。因此字段在创建倒排索引时应该用my_analyzer分词器,字段在搜索时应该使用ik_smart分词器。

PUT /test

{

"settings": {

"analysis": {

"analyzer": { // 自定义分词器

"my_analyzer": { // 分词器名称

"tokenizer": "ik_max_word",

"filter": "py"

}

},

"filter": { // 自定义tokenizer filter

"py": { // 过滤器名称

"type": "pinyin", // 过滤器类型,这里是pinyin

"keep_full_pinyin": false,

"keep_joined_full_pinyin": true,

"keep_original": true,

"limit_first_letter_length": 16,

"remove_duplicated_term": true,

"none_chinese_pinyin_tokenize": false

}

}

}

},

"mappings": {

"properties": {

"name": {

"type": "text",

"analyzer": "my_analyzer", //创建索引时使用

"search_analyzer": "ik_smart" //搜索时使用

}

}

}

}

elasticsearch提供了Completion Suggester查询来实现自动补全功能。这个查询会匹配以用户输入内容开头的词条并返回。为了提高补全查询的效率,对于文档中字段的类型有一些约束:

比如,索引库如下:

// 创建索引库

PUT test

{

"mappings": {

"properties": {

"title":{

"type": "completion"

}

}

}

}

然后插入下面的数据:

// 示例数据

POST test/_doc

{

"title": ["Sony", "WH-1000XM3"]

}

POST test/_doc

{

"title": ["SK-II", "PITERA"]

}

POST test/_doc

{

"title": ["Nintendo", "switch"]

}

查询的DSL语句如下:

// 自动补全查询

GET /test/_search

{

"suggest": {

"title_suggest": { //基于标题的建议

"text": "s", // 用户输入的关键字

"completion": { //自动补全的类型

"field": "title", // 补全查询的字段

"skip_duplicates": true, // 跳过重复的

"size": 10 // 获取前10条结果

}

}

}

}

结果:

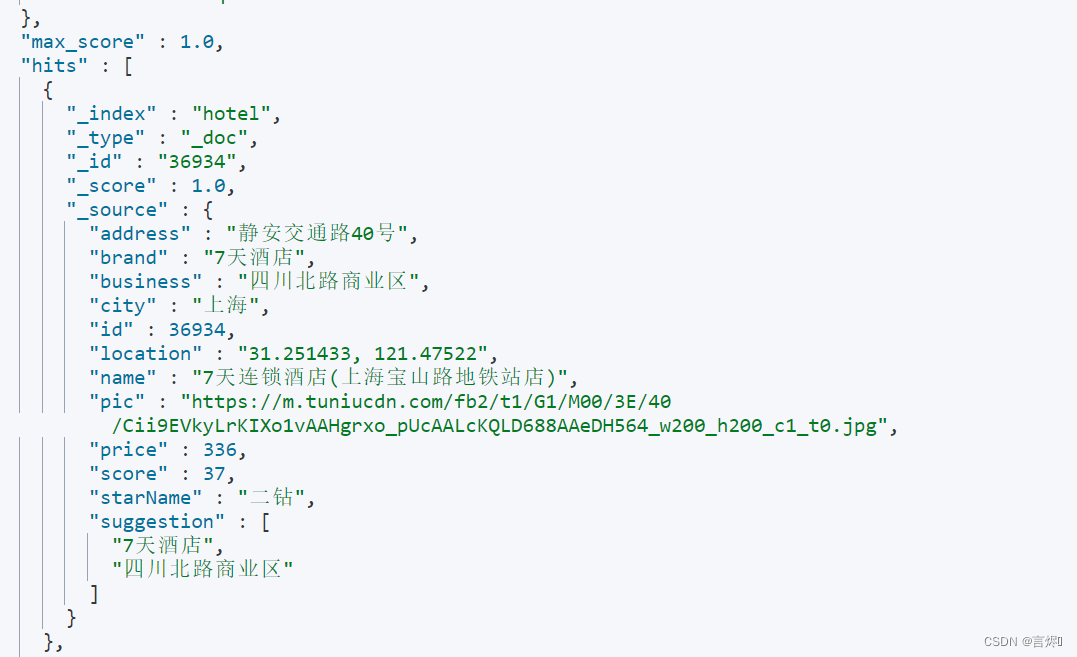

hotel索引库还没有设置拼音分词器,需要修改索引库中的配置。但索引库是无法修改的,只能删除然后重新创建。还需要添加一个字段,用来做自动补全,将brand、suggestion、city等都放进去,作为自动补全的提示。

1.修改hotel索引库结构,设置自定义拼音分词器

2.修改索引库的name、all字段,使用自定义分词器

3.索引库添加一个新字段suggestion,类型为completion类型,使用自定义的分词器

// 酒店数据索引库

PUT /hotel

{

"settings": { #定义索引库的分词器

"analysis": {

"analyzer": {

"text_anlyzer": { #text分词

"tokenizer": "ik_max_word", # ik分词器

"filter": "py"

},

"completion_analyzer": { #completion类型参与自动补全

"tokenizer": "keyword", #不分词

"filter": "py" #使用拼音

}

},

"filter": {

"py": {

"type": "pinyin",

"keep_full_pinyin": false,

"keep_joined_full_pinyin": true,

"keep_original": true,

"limit_first_letter_length": 16,

"remove_duplicated_term": true,

"none_chinese_pinyin_tokenize": false

}

}

}

},

"mappings": {

"properties": {

"id":{

"type": "keyword"

},

# 2.修改索引库的name、all字段,使用自定义分词器

"name":{

"type": "text",

"analyzer": "text_anlyzer",#分词时用text_anlyzer

"search_analyzer": "ik_smart", #搜索时用ik_smart

"copy_to": "all"

},

"address":{

"type": "keyword",

"index": false

},

"price":{

"type": "integer"

},

"score":{

"type": "integer"

},

"brand":{

"type": "keyword",

"copy_to": "all"

},

"city":{

"type": "keyword"

},

"starName":{

"type": "keyword"

},

"business":{

"type": "keyword",

"copy_to": "all"

},

"location":{

"type": "geo_point"

},

"pic":{

"type": "keyword",

"index": false

},

"all":{

"type": "text",

"analyzer": "text_anlyzer",

"search_analyzer": "ik_smart"

},

# 3.索引库添加一个新字段suggestion,类型为completion类型,使用自定义的分词器

"suggestion":{ #自动补全的字段

"type": "completion",

"analyzer": "completion_analyzer" #不分词转拼音

}

}

}

}

4.给HotelDoc类添加suggestion字段,内容包含brand、business

@Data

@NoArgsConstructor

public class HotelDoc {

private Long id;

private String name;

private String address;

private Integer price;

private Integer score;

private String brand;

private String city;

private String starName;

private String business;

private String location;

private String pic;

private Object distance;

private Boolean isAD;

private List<String> suggestion;

public HotelDoc(Hotel hotel) {

this.id = hotel.getId();

this.name = hotel.getName();

this.address = hotel.getAddress();

this.price = hotel.getPrice();

this.score = hotel.getScore();

this.brand = hotel.getBrand();

this.city = hotel.getCity();

this.starName = hotel.getStarName();

this.business = hotel.getBusiness();

this.location = hotel.getLatitude() + ", " + hotel.getLongitude();

this.pic = hotel.getPic();

// 组装suggestion

if(this.business.contains("/")){

// business有多个值,需要切割

String[] arr = this.business.split("/");

// 添加元素

this.suggestion = new ArrayList<>();

this.suggestion.add(this.brand);

Collections.addAll(this.suggestion, arr);

}else {

this.suggestion = Arrays.asList(this.brand, this.business);

}

}

}

5.重新导入数据到hotel库

/*批量导入文档*/

@Test

void testBulkDocumentById() throws IOException {

//批量查询酒店数据

List<Hotel> hotels = hotelService.list();

//转为文档数据

List<HotelDoc> hotelDocs = hotels.stream().map(HotelDoc::new).collect(Collectors.toList());

//1.准备request对象

BulkRequest bulkRequest = new BulkRequest();

//2.准备参数,添加多个request

hotelDocs.forEach(i-> bulkRequest.add(new IndexRequest("hotel").id(i.getId().toString()).source(JSON.toJSONString(i),XContentType.JSON)));

//发送请求

client.bulk(bulkRequest,RequestOptions.DEFAULT);

}

6.搜索测试

GET /hotel/_search

{

"suggest": {

"suggestions": {

"text": "sd",

"completion": {

"field": "suggestion",

"skip_duplicates":true,

"size":10

}

}

}

}

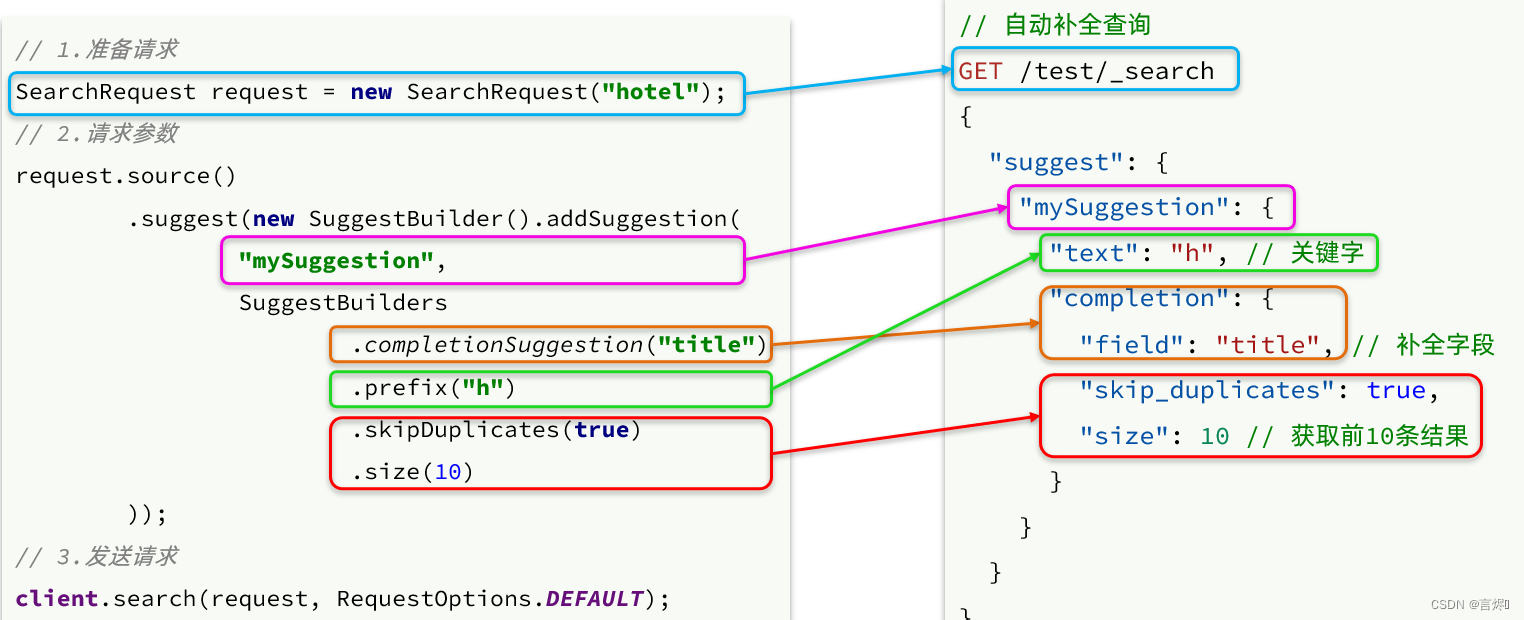

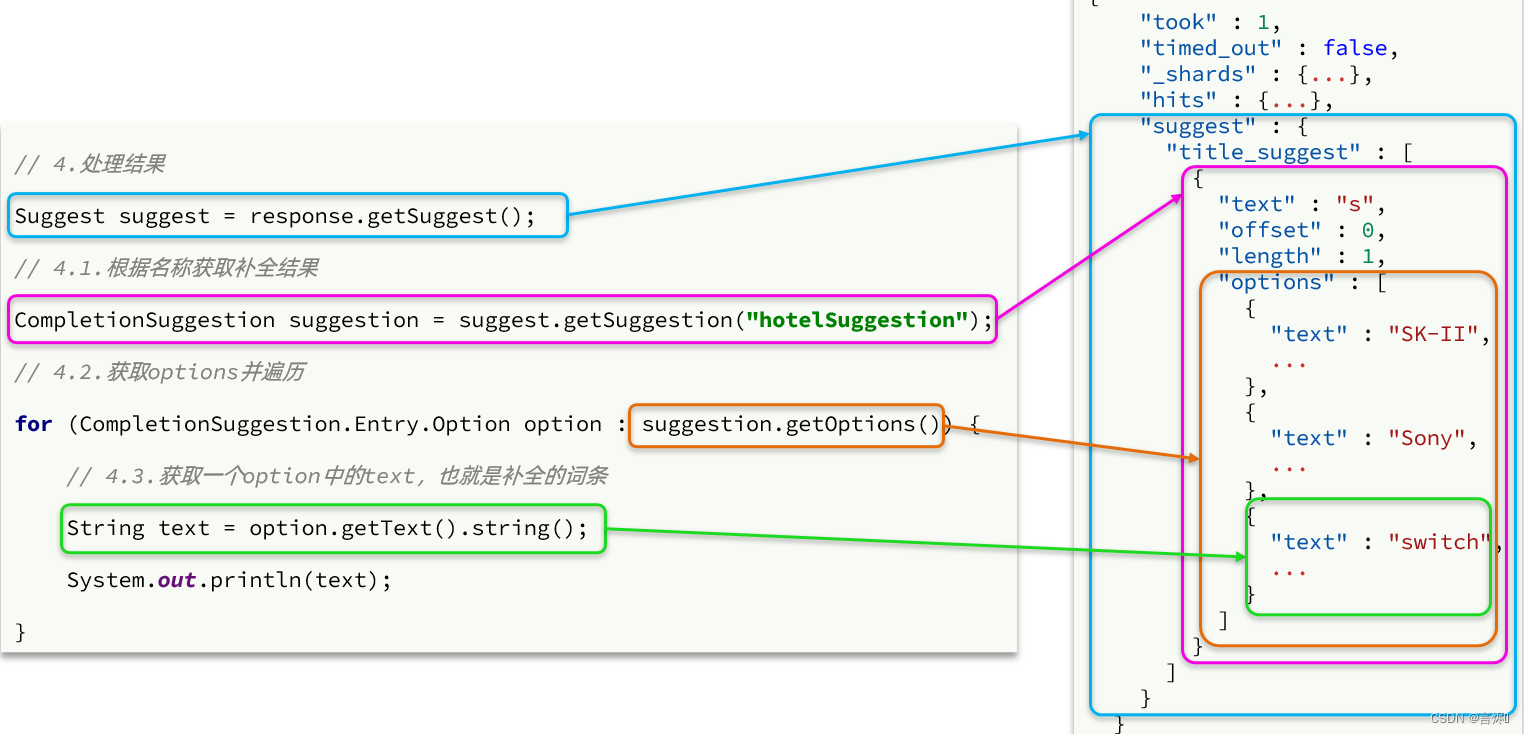

自动补全查询的JavaAPI

结果解析:

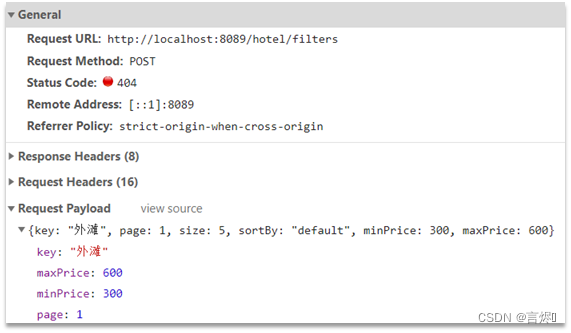

1.请求参数如下图所示:

2.controller中添加方法:

@GetMapping("suggestion")

public List<String> getSuggestions(@RequestParam("key") String prefix) {

return hotelService.getSuggestions(prefix);

}

3.HotelService中实现自动补全并返回数据集合:

@Override

public List<String> getSuggestions(String prefix) {

try {

// 1.准备Request

SearchRequest request = new SearchRequest("hotel");

// 2.准备DSL

request.source().suggest(new SuggestBuilder().addSuggestion(

"suggestions",

SuggestBuilders.completionSuggestion("suggestion")

.prefix(prefix)

.skipDuplicates(true)

.size(10)

));

// 3.发起请求

SearchResponse response = client.search(request, RequestOptions.DEFAULT);

// 4.解析结果

Suggest suggest = response.getSuggest();

// 4.1.根据补全查询名称,获取补全结果

CompletionSuggestion suggestions = suggest.getSuggestion("suggestions");

// 4.2.获取options

List<CompletionSuggestion.Entry.Option> options = suggestions.getOptions();

// 4.3.遍历,返回自动补全的结果

List<String> list = new ArrayList<>(options.size());

for (CompletionSuggestion.Entry.Option option : options) {

String text = option.getText().toString();

list.add(text);

}

return list;

} catch (IOException e) {

throw new RuntimeException(e);

}

}

4.测试

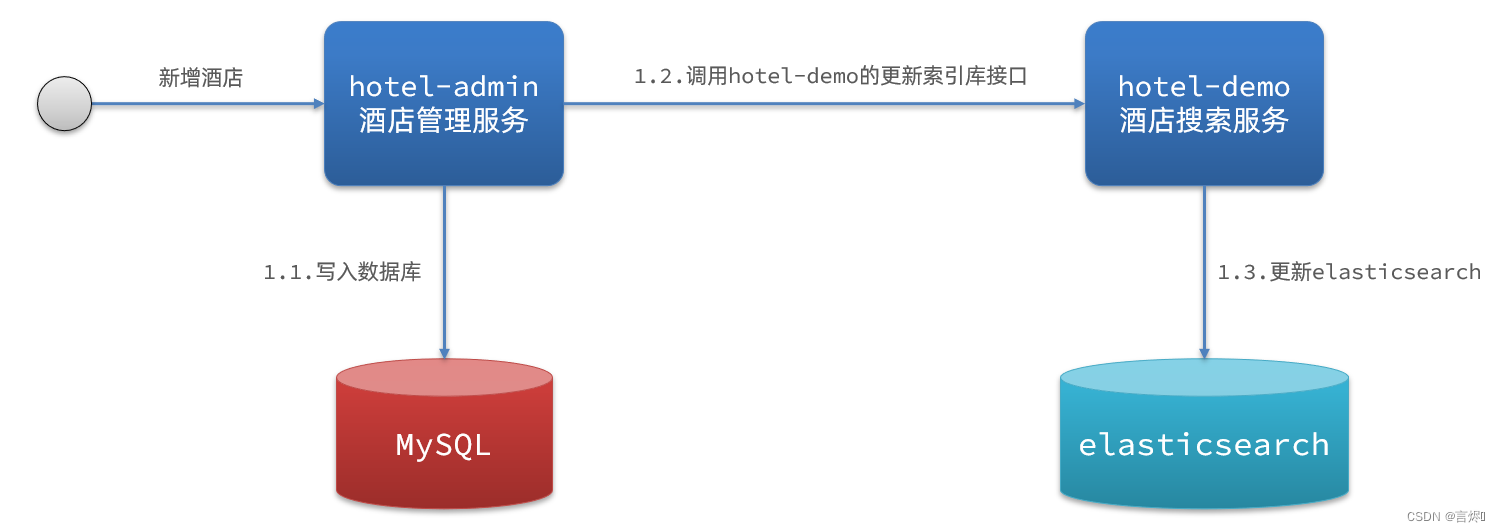

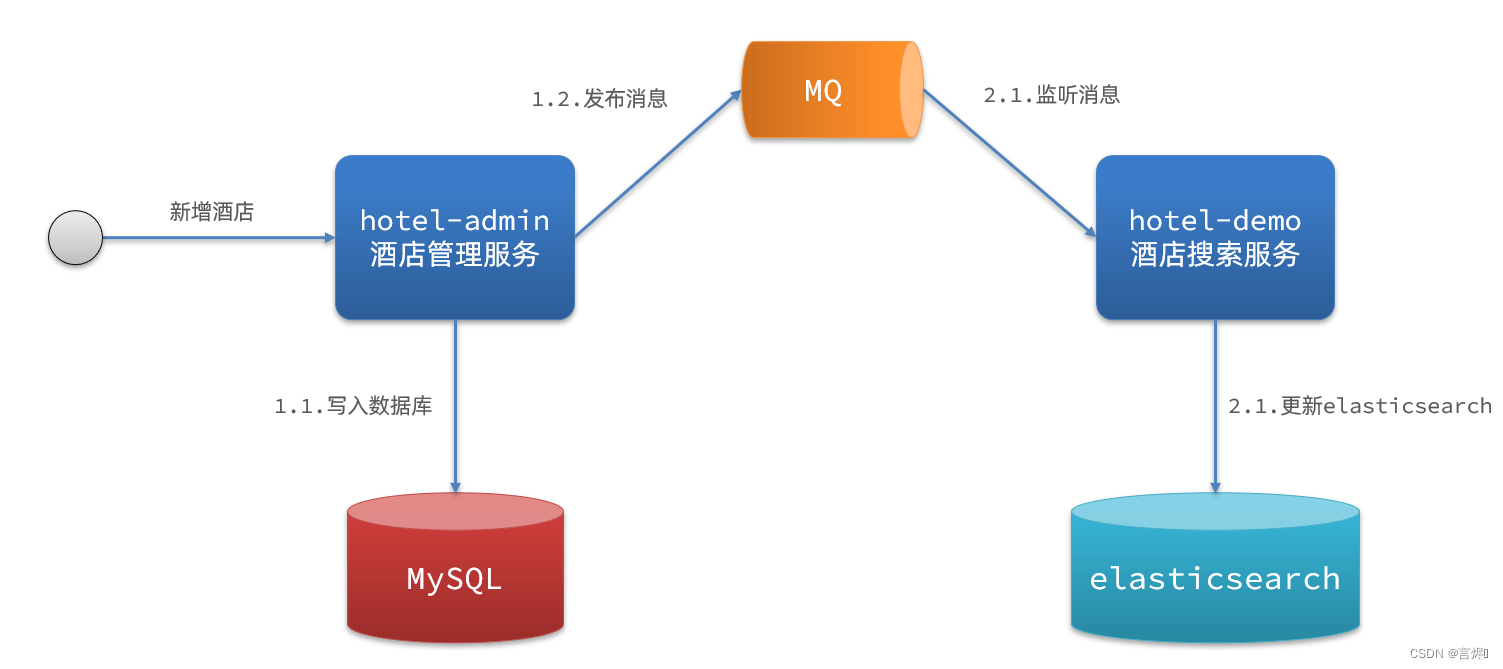

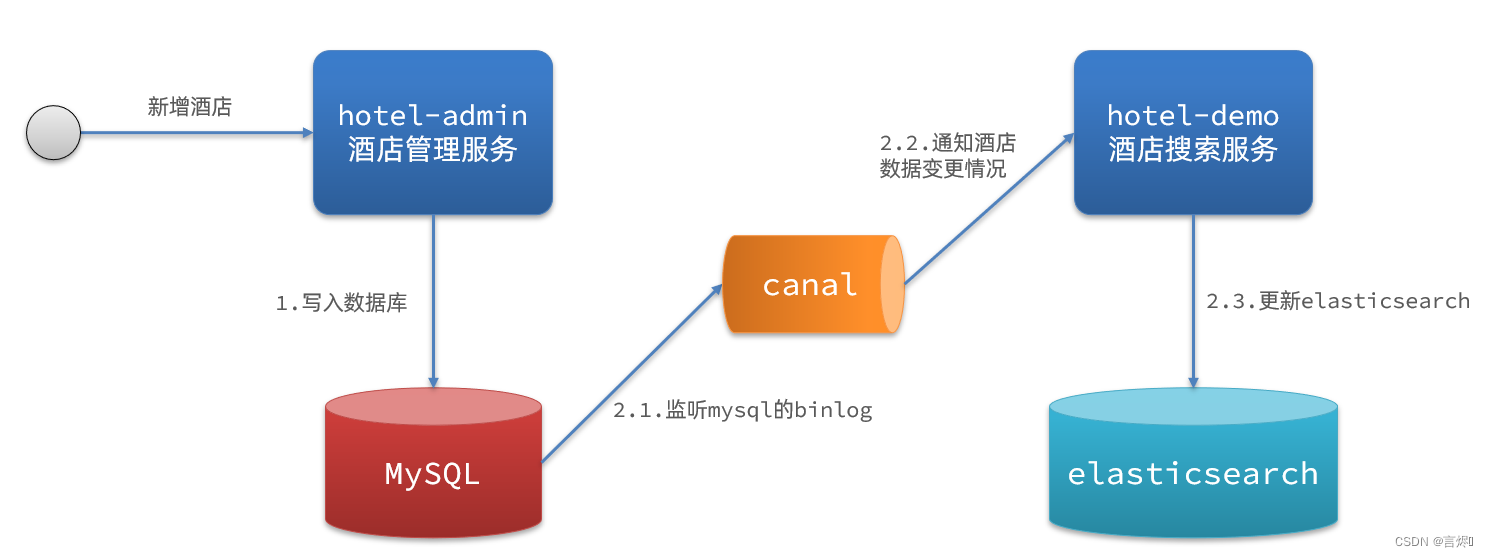

elasticsearch中的酒店数据来自于mysql数据库,因此mysql数据发生改变时,elasticsearch也必须跟着改变,这个就是elasticsearch与mysql之间的数据同步。

在微服务中,负责酒店管理的业务(操作mysql)与负责酒店搜索的业务(操作elasticsearch)的业务可能在两个不同的微服务上,数据同步该如何实现?

方案一:同步调用

方案二:异步通知

方案三:监听binlog

需求:当酒店数据发生增、删、改时,要求对elasticsearch中数据也要完成相同操作

1.完成酒店的增删改并测试(略)

2.声明exchange、queue、RoutingKey

2.1在hotel-admin、hotel-demo中引入rabbitmq的依赖:

<!--amqp-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-amqp</artifactId>

</dependency>

2.2修改配置文件

spring:

rabbitmq:

host: 192.168.221.199

port: 5671

username: admin

password: 12345678

virtual-host: /

2.3在hotel-admin和hotel-demo中声明所需常量

public class MqConstants {

/**

* 交换机

*/

public final static String HOTEL_EXCHANGE = "hotel.topic";

/**

* 监听新增和修改的队列

*/

public final static String HOTEL_INSERT_QUEUE = "hotel.insert.queue";

/**

* 监听删除的队列

*/

public final static String HOTEL_DELETE_QUEUE = "hotel.delete.queue";

/**

* 新增或修改的RoutingKey

*/

public final static String HOTEL_INSERT_KEY = "hotel.insert";

/**

* 删除的RoutingKey

*/

public final static String HOTEL_DELETE_KEY = "hotel.delete";

}

2.4在hotel-demo中声明交换机和队列并完成绑定

@Configuration

public class MqConfig {

/**

* 声明交换机

* @return

*/

@Bean

public TopicExchange topicExchange(){

//交换机名称,是否持久化,是否自动删除

return new TopicExchange(MqConstants.HOTEL_EXCHANGE);

}

/**

* 创建添加/修改队列

*/

@Bean

public Queue insertQueue(){

return new Queue(MqConstants.HOTEL_INSERT_QUEUE,true);

}

/**

* 创建删除队列

*/

@Bean

public Queue deleteQueue(){

return new Queue(MqConstants.HOTEL_DELETE_QUEUE, true);

}

/**

* 绑定新增/修改的队列到交换机,指定RoutingKey

*/

@Bean

public Binding insertQueueBinding(){

return BindingBuilder.bind(insertQueue()).to(topicExchange()).with(MqConstants.HOTEL_INSERT_KEY);

}

/**

* 绑定删除的队列到交换机,指定RoutingKey

* @return

*/

@Bean

public Binding deleteQueueBinding(){

return BindingBuilder.bind(deleteQueue()).to(topicExchange()).with(MqConstants.HOTEL_DELETE_KEY);

}

}

3.在hotel-admin中的增、删、改业务中分别发送MQ消息:

@RestController

@RequestMapping("hotel")

public class HotelController {

@Autowired

private IHotelService hotelService;

@Autowired

private RabbitTemplate rabbitTemplate;

@PostMapping

public void saveHotel(@RequestBody Hotel hotel){

hotelService.save(hotel);

//发送消息,交换机,Routingkey,消息内容(发酒店的id)

rabbitTemplate.convertAndSend(MQConstants.HOTEL_EXCHANGE,MQConstants.HOTEL_INSERT_KEY,hotel.getId());

}

@PutMapping()

public void updateById(@RequestBody Hotel hotel){

if (hotel.getId() == null) {

throw new InvalidParameterException("id不能为空");

}

hotelService.updateById(hotel);

//发送消息,交换机,Routingkey,消息内容(发酒店的id)

rabbitTemplate.convertAndSend(MQConstants.HOTEL_EXCHANGE,MQConstants.HOTEL_INSERT_KEY,hotel.getId());

}

@DeleteMapping("/{id}")

public void deleteById(@PathVariable("id") Long id) {

hotelService.removeById(id);

//发送消息,交换机,Routingkey,消息内容(发酒店的id)

rabbitTemplate.convertAndSend(MQConstants.HOTEL_EXCHANGE,MQConstants.HOTEL_DELETE_KEY,id);

}

}

4.hotel-demo接收到MQ消息,并更新elasticsearch中数据

4.1编写监听器

@Component

public class HotelListener {

@Autowired

private IHotelService hotelService;

/**

* 监听酒店新增或修改的业务

* @param id

*/

@RabbitListener(queues = MqConstants.HOTEL_INSERT_QUEUE)

public void listenHotelInsterOrUpdate(Long id){

hotelService.insertById(id);

}

/**

* 监听酒店删除的业务

* @param id

*/

@RabbitListener(queues = MqConstants.HOTEL_DELETE_QUEUE)

public void listenHotelDelete(Long id){

hotelService.deleteById(id);

}

}

4.2实现删除和新增业务

/*根据id删除*/

@Override

public void deleteById(Long id) {

try {

// 1.准备Request

DeleteRequest request = new DeleteRequest("hotel", id.toString());

// 2.发送请求

client.delete(request, RequestOptions.DEFAULT);

} catch (IOException e) {

throw new RuntimeException(e);

}

}

/*新增*/

@Override

public void insertById(Long id) {

try {

// 0.根据id查询酒店数据

Hotel hotel = getById(id);

// 转换为文档类型

HotelDoc hotelDoc = new HotelDoc(hotel);

// 1.准备Request对象

IndexRequest request = new IndexRequest("hotel").id(hotel.getId().toString());

// 2.准备Json文档

request.source(JSON.toJSONString(hotelDoc), XContentType.JSON);

// 3.发送请求

client.index(request, RequestOptions.DEFAULT);

} catch (IOException e) {

throw new RuntimeException(e);

}

}

5.启动并测试数据同步功能

我脑子里浮现出一些关于一种新编程语言的想法,所以我想我会尝试实现它。一位friend建议我尝试使用Treetop(Rubygem)来创建一个解析器。Treetop的文档很少,我以前从未做过这种事情。我的解析器表现得好像有一个无限循环,但没有堆栈跟踪;事实证明很难追踪到。有人可以指出入门级解析/AST指南的方向吗?我真的需要一些列出规则、常见用法等的东西来使用像Treetop这样的工具。我的语法分析器在GitHub上,以防有人希望帮助我改进它。class{initialize=lambda(name){receiver.name=name}greet=lambda{IO.puts("He

所以我在关注Railscast,我注意到在html.erb文件中,ruby代码有一个微弱的背景高亮效果,以区别于其他代码HTML文档。我知道Ryan使用TextMate。我正在使用SublimeText3。我怎样才能达到同样的效果?谢谢! 最佳答案 为SublimeText安装ERB包。假设您安装了SublimeText包管理器*,只需点击cmd+shift+P即可获得命令菜单,然后键入installpackage并选择PackageControl:InstallPackage获取包管理器菜单。在该菜单中,键入ERB并在看到包时选择

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

在Ruby类中,我重写了三个方法,并且在每个方法中,我基本上做同样的事情:classExampleClassdefconfirmation_required?is_allowed&&superenddefpostpone_email_change?is_allowed&&superenddefreconfirmation_required?is_allowed&&superendend有更简洁的语法吗?如何缩短代码? 最佳答案 如何使用别名?classExampleClassdefconfirmation_required?is_a

可能已经问过了,但我找不到它。这里有2个常见的情况(对我来说,在编程Rails时......)用ruby编写是令人沮丧的:"astring".match(/abc(.+)abc/)[1]在这种情况下,我得到一个错误,因为字符串不匹配,因此在nil上调用[]运算符。我想找到的是比以下内容更好的替代方法:temp="astring".match(/abc(.+)abc/);temp.nil??nil:temp[1]简而言之,如果不匹配,则简单地返回nil而不会出错第二种情况是这样的:var=something.very.long.and.tedious.to.writevar=some

我正在学习Ruby的基础知识(刚刚开始),我遇到了Hash.[]method.它被引入a=["foo",1,"bar",2]=>["foo",1,"bar",2]Hash[*a]=>{"foo"=>1,"bar"=>2}稍加思索,我发现Hash[*a]等同于Hash.[](*a)或Hash.[]*一个。我的问题是为什么会这样。是什么让您将*a放在方括号内,是否有某种规则可以在何时何地使用“it”?编辑:我的措辞似乎造成了一些困惑。我不是在问数组扩展。我明白了。我的问题基本上是:如果[]是方法名称,为什么可以将参数放在括号内?这看起来几乎——但不完全是——就像说如果你有一个方法Foo.d

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

文章目录一、概述简介原理模块二、配置Mysql使用版本环境要求1.操作系统2.mysql要求三、配置canal-server离线下载在线下载上传解压修改配置单机配置集群配置分库分表配置1.修改全局配置2.实例配置垂直分库水平分库3.修改group-instance.xml4.启动监听四、配置canal-adapter1修改启动配置2配置映射文件3启动ES数据同步查询所有订阅同步数据同步开关启动4.验证五、配置canal-admin一、概述简介canal是Alibaba旗下的一款开源项目,Java开发。基于数据库增量日志解析,提供增量数据订阅&消费。Git地址:https://github.co

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO