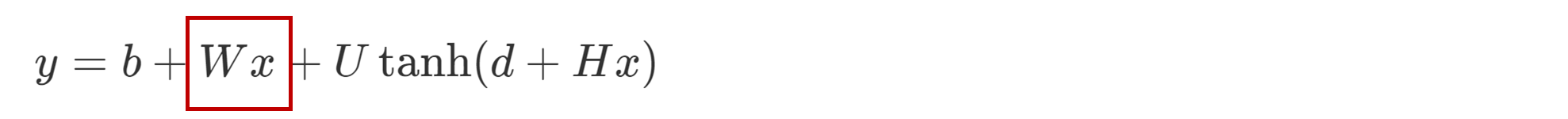

公式是:

$$

y=b+W x+U \tanh (d+H x)

$$

公式是:

$$

y=b+W x+U \tanh (d+H x)

$$

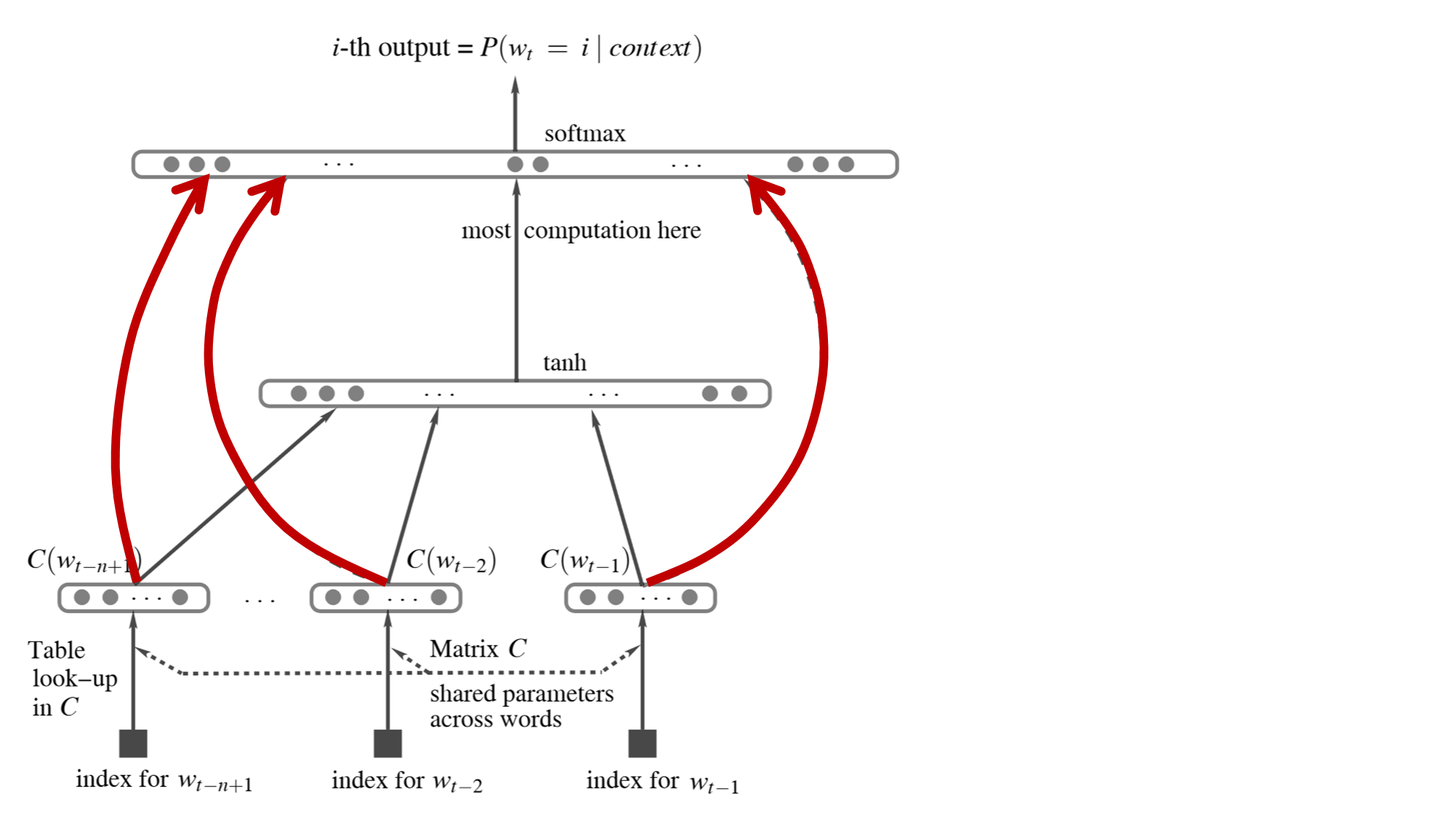

就是下图红框的部分。

就是下图红框的部分。

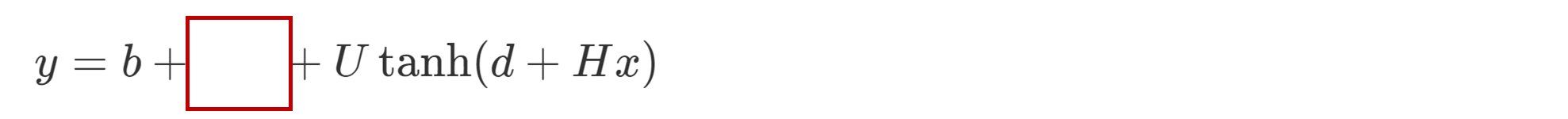

去掉红框剩下的就是常规的多层感知机,就不用多解释了。

去掉红框剩下的就是常规的多层感知机,就不用多解释了。

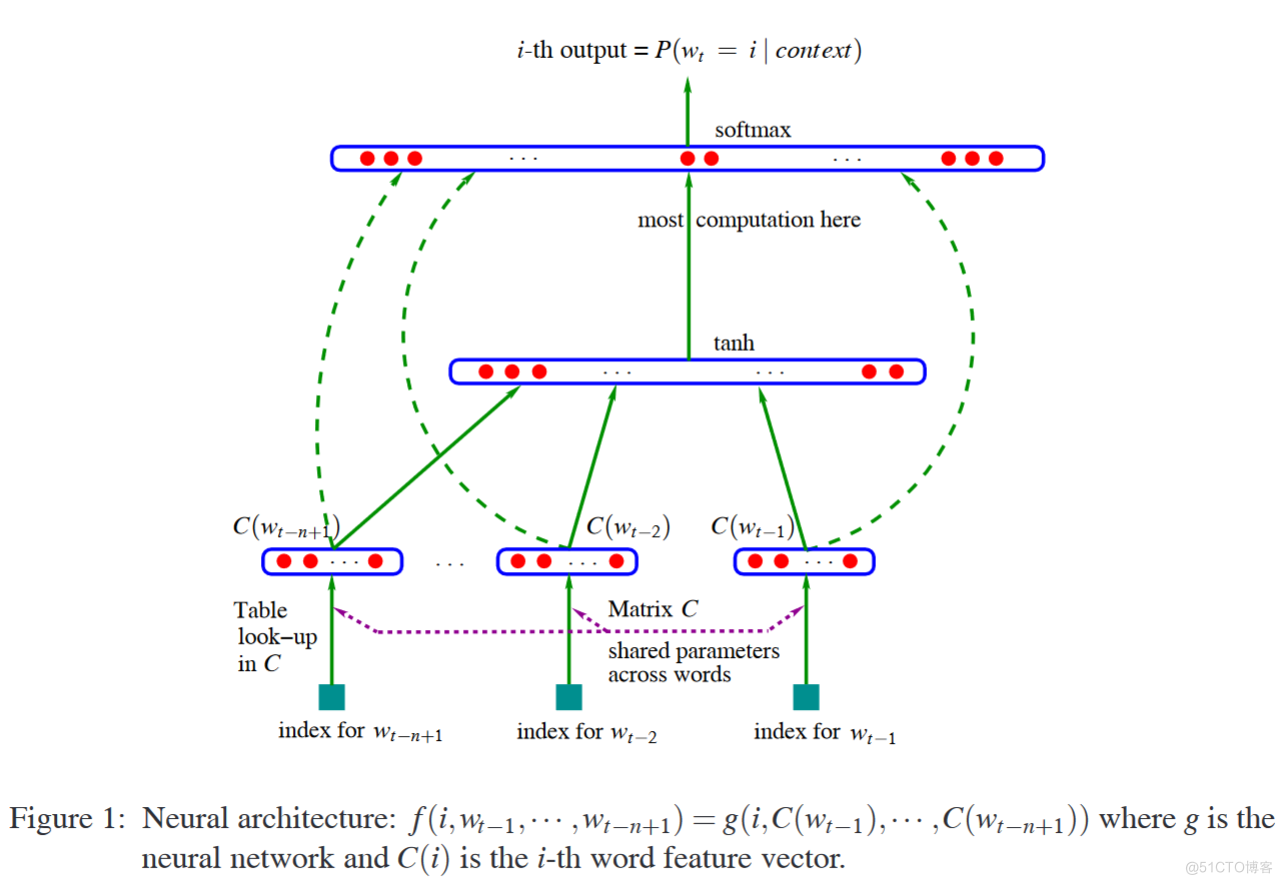

看一下论文原文部分:

看一下论文原文部分:

这部分说了一下模型的参数设置,先是说了一下W和x这两个量。x是一个word embedding的矩阵。W是一个初始化为0的矩阵。然后就是剩下的几个参数说了一下参数的形状。

这部分说了一下模型的参数设置,先是说了一下W和x这两个量。x是一个word embedding的矩阵。W是一个初始化为0的矩阵。然后就是剩下的几个参数说了一下参数的形状。

class NNLM(nn.Module):

def __init__(self):

super(NNLM, self).__init__()

self.C = nn.Embedding(n_class, m)

self.H = nn.Parameter(torch.randn(len_sen * m, n_hidden,requires_grad=True))

self.d = nn.Parameter(torch.randn(n_hidden))

self.U = nn.Parameter(torch.randn(n_hidden, n_class,requires_grad=True))

self.W = nn.Parameter(torch.zeros(len_sen * m, n_class,requires_grad=True))

self.b = nn.Parameter(torch.randn(n_class))

def forward(self, X): # X : [batch_size, len_sen]

X = self.C(X) # X : [batch_size, len_sen, m]

X = X.view(-1, len_sen * m) # [batch_size, len_sen * m]

tanh = torch.tanh(self.d + X @ self.H) # [batch_size, n_hidden]

output = self.b + X @ self.W + tanh @ self.U # [batch_size, n_class]

return output

代码解析:

__init__(self) 这部分是上面一些参数量。

self.C是一个embedding操作。

torch.zeros,其余的就使用随机初始化torch.randn。

forward(self, X)就是设置前向传播,

X = self.C(X),先将X进行一个embedding处理,然后再将结果还给X。就对应了我们前面提到的,虽然要经过一个embedding处理,但是原公式中输入还是用X表示的。

Tensor.view函数是修改张量形状的。torch.Tensor.view — PyTorch 1.11.0 documentation。

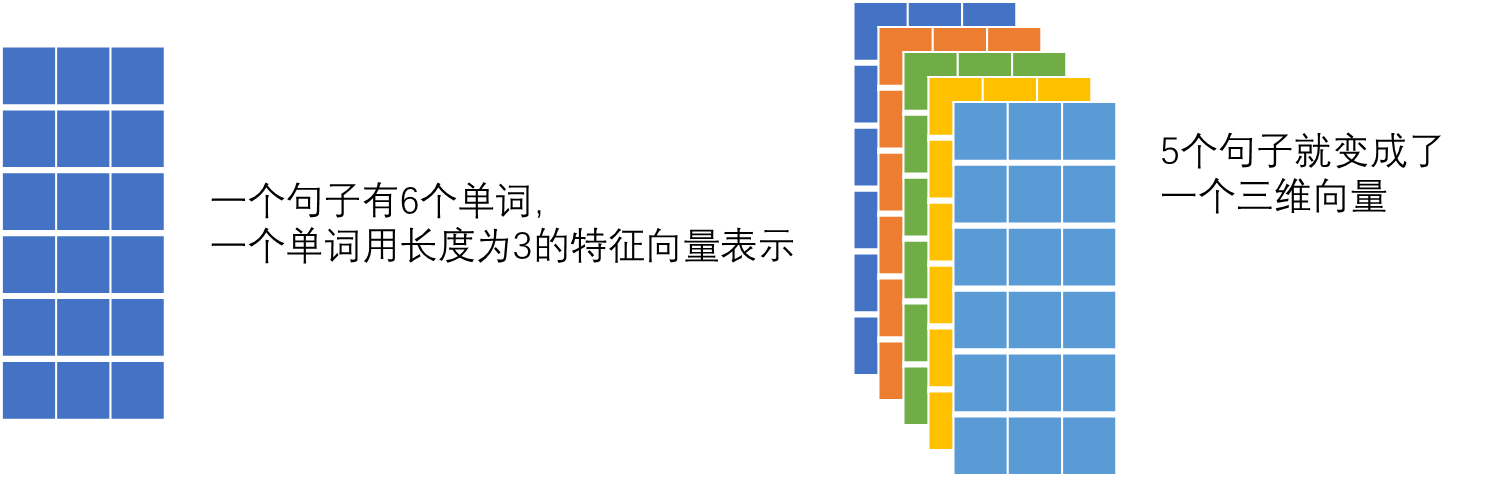

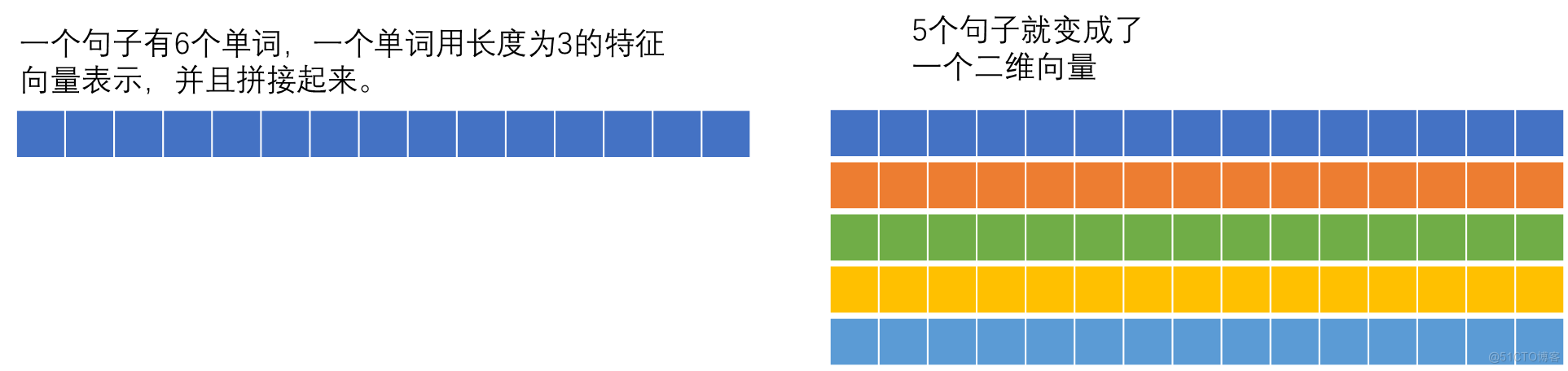

修改维度之后就是将每个句子中每个单词的word embedding向量拼接起来。

self.d + X @ self.H 这里是输入层的隐藏层的计算。

tanh = torch.tanh(self.d + X @ self.H)计算结果要经过tanh的激活函数。这里是将tanh激活函数计算之后的结果直接赋值给了一个叫tanh的变量。

output = self.b + X @ self.W + tanh @ self.U 然后是输出层计算。这里要注意输出层的结果是有两部分组成的。一部分是隐藏层传过来的结果,一部分是输入层传过来的结果,二者相加之后才是隐藏层的计算。

batch_size表示。每个句子的长度用len_sen表示。

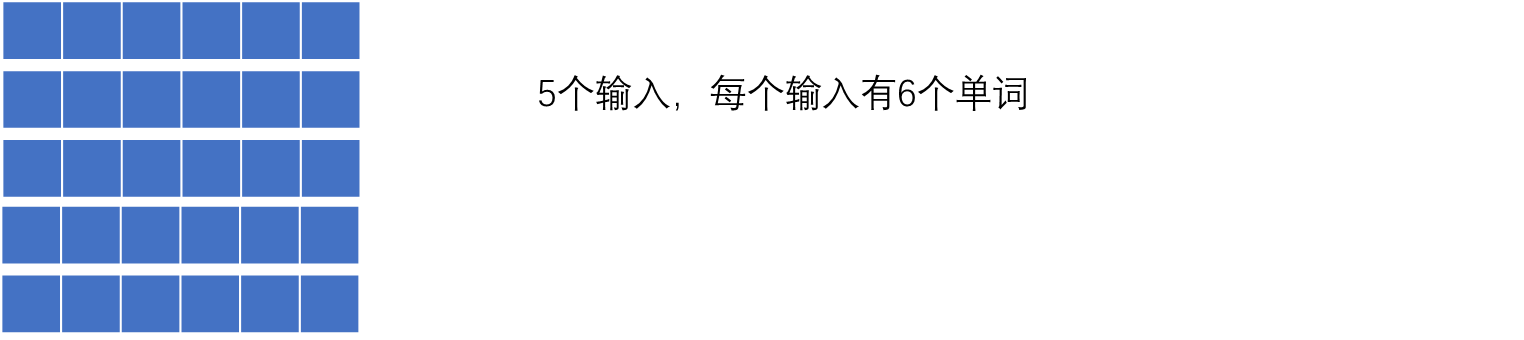

m是embedding向量的长度。使用外号的向量表示一个单词的时候,你的词汇表有多长,你的表示向量就有多长。但是你现在使用特征值来表示一个单词。你仅需要设定你想表示的特征向量的长度即可,这个m是可以自己设置的。因为这个代码里用到的数据比较简单,所以你设置的小一点也没有关系。我在这里是设置为3。

隐藏层的大小设置为n_hidden。词汇表的长度是n_class。

Tensor.view修改形状。这里是X.view(-1, len_sen * m)修改为二维矩阵,矩阵的第二维是len_sen * m,第一维度自适应(-1是自适应的意思)。意思就是把一个句子中不同单词的表示做一个concate,拼接起来。

tanh这里已经到了隐藏层了。所以输入向量的长度会变成隐藏层的大小。这个隐藏层的大小n_hidden也是需要自己设置的。隐藏层大小决定网络的质量。当然我们这里数据量比较小,所以好不好其实隐藏层大小的影响根本就不大。一般隐藏层的大小遵循以下几个规则。

假设:

len_sen * m。分类大小就是单词表的长度n_class。计算之后h的大小为14。

此时的tanh维度为[batch_size, n_hidden]。

sentences = ["The cat is walking in the bedroom",

"A dog was running in a room",

"The cat is running in a room",

"A dog is walking in a bedroom",

"The dog was walking in the room"]

word_list = " ".join(sentences).lower().split()

word_list = list(set(word_list))

word_dict = {w: i for i, w in enumerate(word_list)}

number_dict = {i: w for i, w in enumerate(word_list)}

word_list是把数据集中的所有句子都用空格拼接起来。然后再将其转化成小写。然后再用空格将其分开,分成不同的词。此时就得到了一个单词列表。但是现在里面会有很多重复的词。word_list先使用set,把上面得到的那个列表转换成一个集合,去掉重复的词,然后再转换回列表。def dataset():

input = []

target = []

for sen in sentences:

word = sen.lower().split() # space tokenizer

i = [word_dict[n] for n in word[:-1]] # create (1~n-1) as input

t = word_dict[word[-1]] # create (n) as target, We usually call this 'casual language model'

input.append(i)

target.append(t)

return input, target

这张代码应该不用过多的解释了,看一下这个输出结果你们就能懂了。就是把每个样本都处理好了之后,再拼接到一个矩阵里面。

import torch

import torch.nn as nn

import torch.optim as optim

def dataset():

input = []

target = []

for sen in sentences:

word = sen.lower().split() # space tokenizer

i = [word_dict[n] for n in word[:-1]] # create (1~n-1) as input

t = word_dict[word[-1]] # create (n) as target, We usually call this 'casual language model'

input.append(i)

target.append(t)

return input, target

# Model

class NNLM(nn.Module):

def __init__(self):

super(NNLM, self).__init__()

self.C = nn.Embedding(n_class, m)

self.H = nn.Parameter(torch.randn(len_sen * m, n_hidden,requires_grad=True))

self.d = nn.Parameter(torch.randn(n_hidden))

self.U = nn.Parameter(torch.randn(n_hidden, n_class,requires_grad=True))

self.W = nn.Parameter(torch.zeros(len_sen * m, n_class,requires_grad=True))

self.b = nn.Parameter(torch.randn(n_class))

def forward(self, X): # X : [batch_size, len_sen, m]

X = self.C(X) # X : [batch_size, len_sen, m]

X = X.view(-1, len_sen * m) # [batch_size, len_sen * m]

tanh = torch.tanh(self.d + X @ self.H) # [batch_size, n_hidden]

output = self.b + X @ self.W + tanh @ self.U # [batch_size, n_class]

return output

if __name__ == '__main__':

sentences = ["The cat is walking in the bedroom",

"A dog was running in a room",

"The cat is running in a room",

"A dog is walking in a bedroom",

"The dog was walking in the room"]

word_list = " ".join(sentences).lower().split()

word_list = list(set(word_list))

word_dict = {w: i for i, w in enumerate(word_list)}

number_dict = {i: w for i, w in enumerate(word_list)}

n_class = len(word_dict) # number of Vocabulary

len_sen = 6 # number of steps, n-1 in paper

m = 3 # embedding size, m in paper

n_hidden = (int)((len_sen*m*n_class)**0.5) # number of hidden size, h in paper

model = NNLM()

loss = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.003)

input, target = dataset()

input = torch.LongTensor(input)

target = torch.LongTensor(target)

# 训练之前先看一下效果。

predict = model(input).data.max(1, keepdim=True)[1]

print([sen.split()[:6] for sen in sentences], '->', [number_dict[n.item()] for n in predict.squeeze()])

# Training

for epoch in range(5000):

optimizer.zero_grad()

output = model(input)

# output : [batch_size, n_class], target : [batch_size]

Loss = loss(output, target)

if (epoch + 1) % 1000 == 0:

print('Epoch:', '%04d' % (epoch + 1), 'cost =', '{:.6f}'.format(Loss))

Loss.backward()

optimizer.step()

# Predict & test

predict = model(input).data.max(1, keepdim=True)[1]

print([sen.split()[:6] for sen in sentences], '->', [number_dict[n.item()] for n in predict.squeeze()])

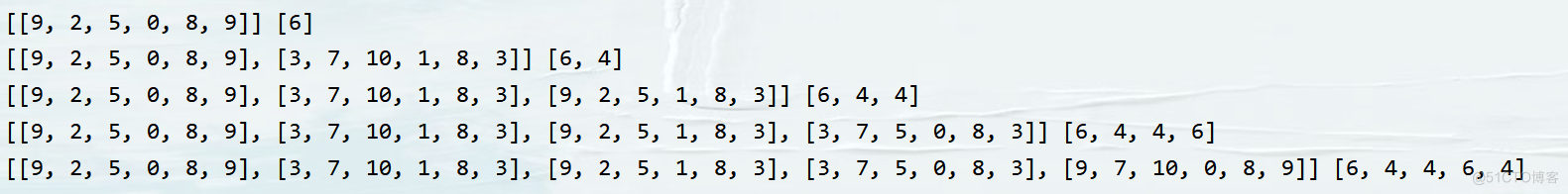

训练前后的输出对比:

[['The', 'cat', 'is', 'walking', 'in', 'the'], ['A', 'dog', 'was', 'running', 'in', 'a'], ['The', 'cat', 'is', 'running', 'in', 'a'], ['A', 'dog', 'is', 'walking', 'in', 'a'], ['The', 'dog', 'was', 'walking', 'in', 'the']] -> ['dog', 'walking', 'cat', 'a', 'walking']

[['The', 'cat', 'is', 'walking', 'in', 'the'], ['A', 'dog', 'was', 'running', 'in', 'a'], ['The', 'cat', 'is', 'running', 'in', 'a'], ['A', 'dog', 'is', 'walking', 'in', 'a'], ['The', 'dog', 'was', 'walking', 'in', 'the']] -> ['bedroom', 'room', 'room', 'bedroom', 'room']

如何在buildr项目中使用Ruby?我在很多不同的项目中使用过Ruby、JRuby、Java和Clojure。我目前正在使用我的标准Ruby开发一个模拟应用程序,我想尝试使用Clojure后端(我确实喜欢功能代码)以及JRubygui和测试套件。我还可以看到在未来的不同项目中使用Scala作为后端。我想我要为我的项目尝试一下buildr(http://buildr.apache.org/),但我注意到buildr似乎没有设置为在项目中使用JRuby代码本身!这看起来有点傻,因为该工具旨在统一通用的JVM语言并且是在ruby中构建的。除了将输出的jar包含在一个独特的、仅限ruby

在rails源中:https://github.com/rails/rails/blob/master/activesupport/lib/active_support/lazy_load_hooks.rb可以看到以下内容@load_hooks=Hash.new{|h,k|h[k]=[]}在IRB中,它只是初始化一个空哈希。和做有什么区别@load_hooks=Hash.new 最佳答案 查看rubydocumentationforHashnew→new_hashclicktotogglesourcenew(obj)→new_has

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

我的主要目标是能够完全理解我正在使用的库/gem。我尝试在Github上从头到尾阅读源代码,但这真的很难。我认为更有趣、更温和的踏脚石就是在使用时阅读每个库/gem方法的源代码。例如,我想知道RubyonRails中的redirect_to方法是如何工作的:如何查找redirect_to方法的源代码?我知道在pry中我可以执行类似show-methodmethod的操作,但我如何才能对Rails框架中的方法执行此操作?您对我如何更好地理解Gem及其API有什么建议吗?仅仅阅读源代码似乎真的很难,尤其是对于框架。谢谢! 最佳答案 Ru

我的假设是moduleAmoduleBendend和moduleA::Bend是一样的。我能够从thisblog找到解决方案,thisSOthread和andthisSOthread.为什么以及什么时候应该更喜欢紧凑语法A::B而不是另一个,因为它显然有一个缺点?我有一种直觉,它可能与性能有关,因为在更多命名空间中查找常量需要更多计算。但是我无法通过对普通类进行基准测试来验证这一点。 最佳答案 这两种写作方法经常被混淆。首先要说的是,据我所知,没有可衡量的性能差异。(在下面的书面示例中不断查找)最明显的区别,可能也是最著名的,是你的

几个月前,我读了一篇关于rubygem的博客文章,它可以通过阅读代码本身来确定编程语言。对于我的生活,我不记得博客或gem的名称。谷歌搜索“ruby编程语言猜测”及其变体也无济于事。有人碰巧知道相关gem的名称吗? 最佳答案 是这个吗:http://github.com/chrislo/sourceclassifier/tree/master 关于ruby-寻找通过阅读代码确定编程语言的rubygem?,我们在StackOverflow上找到一个类似的问题:

我目前正在使用以下方法获取页面的源代码:Net::HTTP.get(URI.parse(page.url))我还想获取HTTP状态,而无需发出第二个请求。有没有办法用另一种方法做到这一点?我一直在查看文档,但似乎找不到我要找的东西。 最佳答案 在我看来,除非您需要一些真正的低级访问或控制,否则最好使用Ruby的内置Open::URI模块:require'open-uri'io=open('http://www.example.org/')#=>#body=io.read[0,50]#=>"["200","OK"]io.base_ur

前言作为一名程序员,自己的本质工作就是做程序开发,那么程序开发的时候最直接的体现就是代码,检验一个程序员技术水平的一个核心环节就是开发时候的代码能力。众所周知,程序开发的水平提升是一个循序渐进的过程,每一位程序员都是从“菜鸟”变成“大神”的,所以程序员在程序开发过程中的代码能力也是根据平时开发中的业务实践来积累和提升的。提高代码能力核心要素程序员要想提高自身代码能力,尤其是新晋程序员的代码能力有很大的提升空间的时候,需要针对性的去提高自己的代码能力。提高代码能力其实有几个比较关键的点,只要把握住这些方面,就能很好的、快速的提高自己的一部分代码能力。1、多去阅读开源项目,如有机会可以亲自参与开源

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

嗨~大家好,这里是可莉!今天给大家带来的是7个C语言的经典基础代码~那一起往下看下去把【程序一】打印100到200之间的素数#includeintmain(){ inti; for(i=100;i 【程序二】输出乘法口诀表#includeintmain(){inti;for(i=1;i 【程序三】判断1000年---2000年之间的闰年#includeintmain(){intyear;for(year=1000;year 【程序四】给定两个整形变量的值,将两个值的内容进行交换。这里提供两种方法来进行交换,第一种为创建临时变量来进行交换,第二种是不创建临时变量而直接进行交换。1.创建临时变量来