作者:程德昊,Fluent Member,KubeSphere Member

随着云原生技术的快速发展,技术的不断迭代,对于日志的采集、处理及转发提出了更高的要求。云原生架构下的日志方案相比基于物理机或者是虚拟机场景的日志架构设计存在很大差别。作为 CNCF 的毕业项目,Fluent Bit 无疑为解决云环境中的日志记录问题的首选解决方案之一。但是在 Kubernetes 中安装部署以及配置 Fluent Bit 都具有一定的门槛,加大了用户的使用成本。

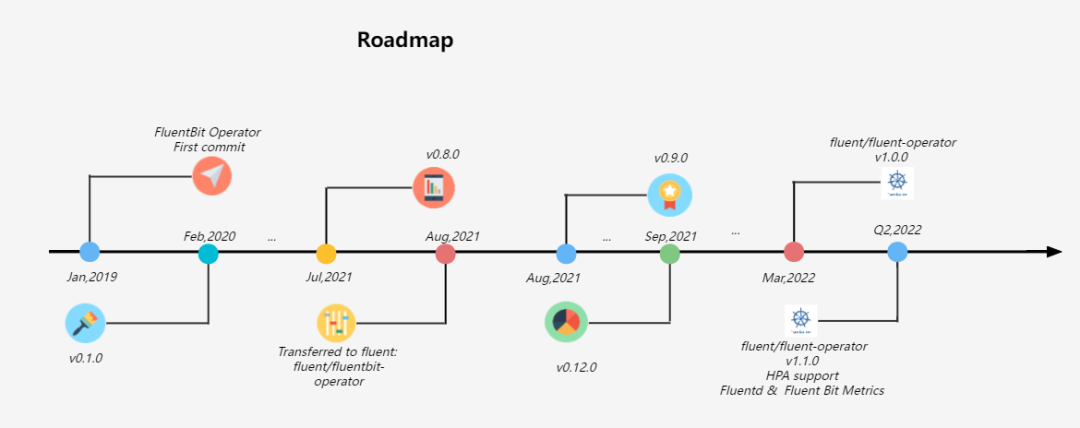

2019 年 1 月 21 日,KubeSphere 社区为了满足以云原生的方式管理 Fluent Bit 的需求开发了 Fluentbit Operator,并在 2020 年 2 月 17 日发布了 v0.1.0 版本。此后产品不断迭代,在 2021 年 8 月 4 日 正式将 Fluentbit Operator 捐献给 Fluent 社区。

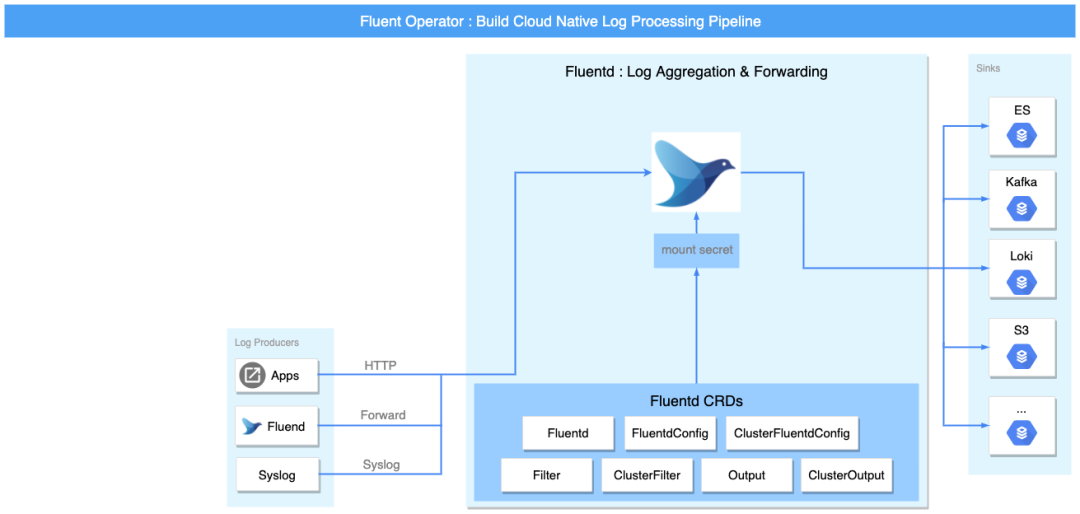

Fluentbit Operator 降低了 Fluent Bit 的使用门槛,能高效、快捷的处理日志信息,但是 Fluent Bit 处理日志的能力稍弱,我们还没有集成日志处理工具,比如 Fluentd,它有更多的插件可供使用。基于以上需求,Fluentbit Operator 集成了 Fluentd,旨在将 Fluentd 集成为一个可选的日志聚合和转发层,并重新命名为 Fluent Operator(GitHub 地址:https://github.com/fluent/fluent-operator)。在 2022 年 3 月 25 日 Fluent Operator 发布了 v1.0.0 版本,并将继续迭代 Fluentd Operator,预计在 2022 年第 2 季度发布 v1.1.0 版本,增加更多的功能与亮点。

使用 Fluent Operator 可以灵活且方便地部署、配置及卸载 Fluent Bit 以及 Fluentd。同时, 社区还提供支持 Fluentd 以及 Fluent Bit 的海量插件,用户可以根据实际情况进行定制化配置。官方文档提供了详细的示例,极易上手,大大降低了 Fluent Bit 以及 Fluentd 的使用门槛。

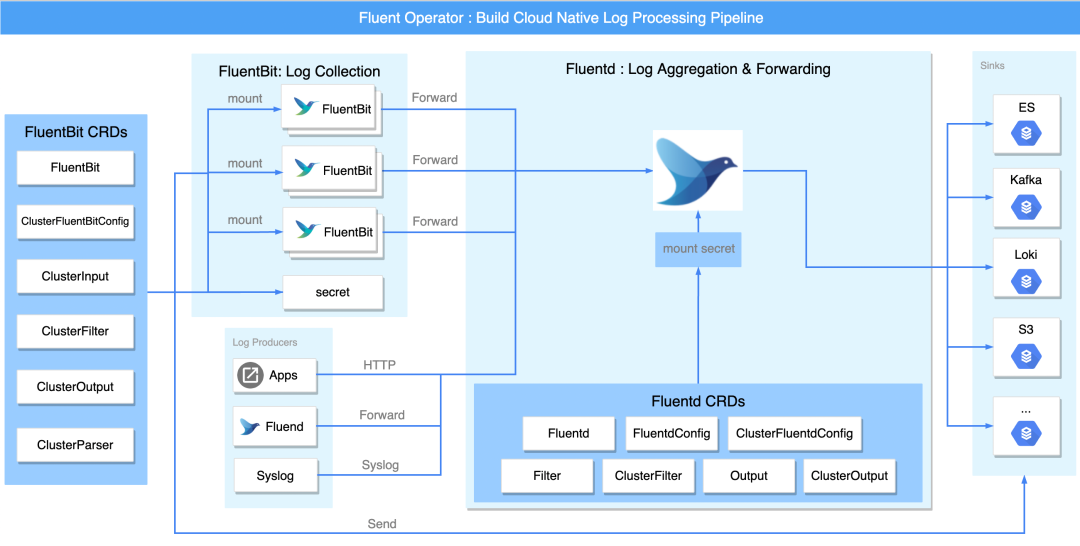

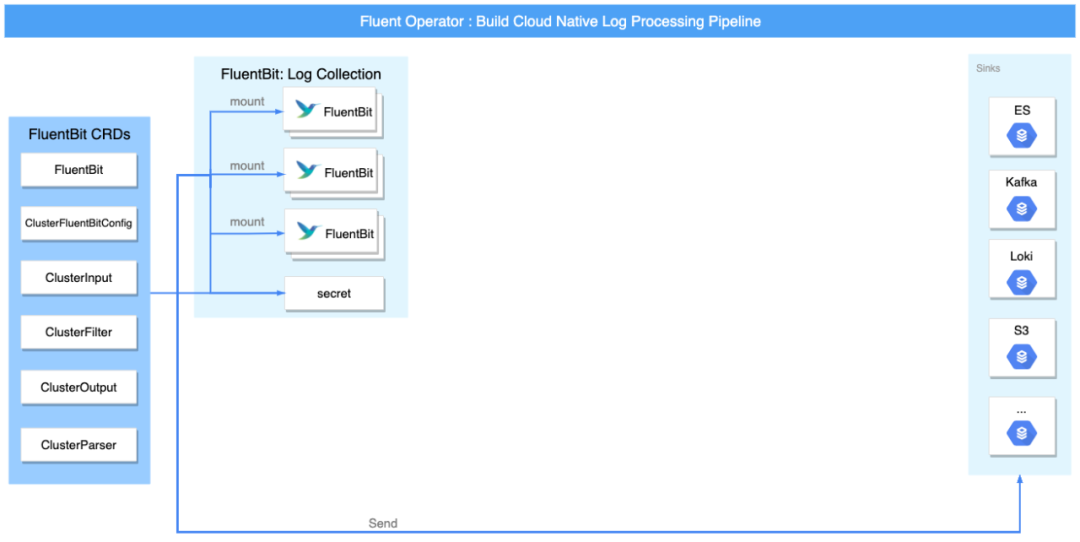

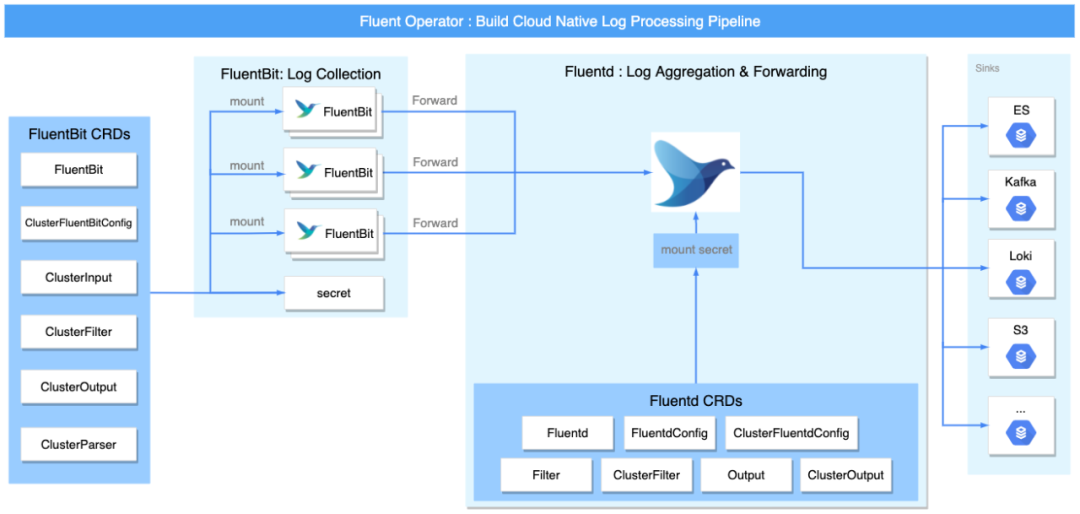

Fluent Operator 可以单独部署 Fluent Bit 或者 Fluentd,并不会强制要求使用 Fluent Bit 或 Fluentd,同时还支持使用 Fluentd 接收 Fluent Bit 转发的日志流进行多租户日志隔离,这极大地增加了部署的灵活性和多样性。 为了更全面的了解 Fluent Operator,下图以完整的日志流水线为例,将流水线分为三部分:采集和转发、过滤以及输出。

Fluent Bit 与 Fluentd 均可以采集日志。

单独部署时,可以通过 Fluent Bit 的 intput 插件或者 Fluentd 的 forward 以及 http 等插件来满足对日志收集的需求。两者结合时,Fluentd 可使用 forward 接受 Fluent Bit 的日志流转发。

在性能方面,Fluent Bit 相比 Fluentd 更轻量,内存消耗更小(约为 650KB),所以主要由 Fluent Bit 负责采集与转发日志。在各个节点上通过以 DaemonSet 形式安装的 Fluent Bit 来收集和转发日志。

日志收集的数据往往过于杂乱与冗余,这要求日志处理中间件提供对日志信息进行过滤和处理的能力。Fluent Bit 或 Fluentd 均支持 filter 插件,用户可以根据自身需求,整合和定制日志数据。

Fluent Bit output 或 Fluentd output 插件将处理后的日志信息输出到多个目的地,目的地可以是 Kafka、Elasticsearch 等第三方组件。

Fluent Operator 为 Fluent Bit 和 Fluentd 分别定义了两个 Group:fluentbit.fluent.io 和 fluentd.fluent.io。

fluentbit.fluent.io 分组下包含以下 6 个 CRDs:

fluentd.fluent.io 分组下包含以下 7 个 CRDs:

尽管 Fluent Bit 与 Fluentd 都有收集、处理(解析和过滤)以及输出日志的能力,但它们有着不同的优点。Fluent Bit 相对 Fluentd 更为轻量与高效,而 Fluentd 插件更为丰富。

为了兼顾这些优点,Fluent Operator 允许用户以多种方式灵活地使用 Fluent Bit 和 Fluentd:

Fluent Operator 允许您根据需要在上述 3 种模式下配置日志处理管道。Fluentd 与 Fluent Bit 具有丰富的插件以满足用户的各种自定义化需求,由于 Fluentd 与 Fluent Bit 的配置挂载方式相似,所以以 Fluent Bit 配置文件的挂载方式来进行简单介绍。

在 Fluent Bit CRD 中每个 ClusterInput, ClusterParser, ClusterFilter,ClusterOutput 代表一个 Fluent Bit 配置部分,由 ClusterFluentBitConfig 标签选择器选择。Fluent Operator 监视这些对象,构建最终配置,最后创建一个 Secret 来存储安装到 Fluent Bit DaemonSet 中的配置。整个工作流程如下所示:

因为 Fluent Bit 本身没有重新加载接口(详细信息请参阅此已知问题),为了使 Fluent Bit 能够在 Fluent Bit 配置更改时获取并使用最新配置,添加了一个名为 fluentbit watcher 的包装器,以便在检测到 Fluent Bit 配置更改时立即重新启动 Fluent Bit 进程。这样,无需重新启动 Fluent Bit pod 即可重新加载新配置。

为了使用户配置更为方便,我们基于 CRD 强大的抽象能力将应用以及配置的参数提取出来。用户可以通过定义的 CRD 来对 Fluent Bit 以及 Fluentd 进行配置。Fluent Operator 监控这些对象的变化从而更改 Fluent Bit 以及 Fluentd 的状态及配置。特别是插件的定义,为了使用户更为平滑地过渡,我们在命名上基本与 Fluent Bit 原有的字段保持一致,降低使用的门槛。

Fluent Bit 可以高效的采集日志,但是如果需要对日志信息进行复杂处理,Fluent Bit 则稍显力不从心,而 Fluentd 则可以借助其丰富的插件完成对日志信息的高级处理。fluent-operator 为此抽象了 Fluentd 的各种插件,以便可以对日志信息进行处理来满足用户的自定义需求。

从上面 CRD 的定义可以看出,我们将 Fluentd 的 config 及插件的 CRD 分成了 cluster 级别与 namespace 级别的 CRD。通过将 CRD 定义为两种范围,借助 Fluentd 的 label router 插件,就可以达到多租户隔离的效果。

我们在 clusterfluentconfig 添加了 watchNamespace 字段,用户可以根据自己的需求选择监听哪些 namespace,如果为空,则表示监控所有的 namespace。而 namesapce 级别的 fluentconfig 只能监听自己所位于的 namespace 中的 CR 及全局级别的配置。所以 namespace 级别的日志既可以输出到该 namespace 中的 output,也可以输出到 clsuter 级别的 output,从而达到多租户隔离的目的。

借助 Fluent Operator 可以对日志进行复杂处理,在这里我们可以通过 fluent-operator-walkthrough 中将日志输出到 elasticsearch 与 kafka 的例子对 Fluent Operator 的实际功能进行介绍。要获得 Fluent Operator 的一些实际操作经验,您需要一个 Kind 集群。同时你还需要在这种类型的集群中设置一个 Kafka 集群和一个 Elasticsearch 集群。

# 创建一个 kind 的集群并命名为 fluent

./create-kind-cluster.sh

# 在 Kafka namespace 下创建一个 Kafka 集群

./deploy-kafka.sh

# 在 elastic namespace 下创建一个 Elasticsearch 集群

./deploy-es.sh

Fluent Operator 控制 Fluent Bit 和 Fluentd 的生命周期。您可以使用以下脚本在 fluent 命名空间中启动 Fluent Operator:

./deploy-fluent-operator.sh

Fluent Bit 和 Fluentd 都已被定义为 Fluent Operator 中的 CRD,您可以通过声明 FluentBit 或 Fluentd 的 CR 来创建 Fluent Bit DaemonSet 或 Fluentd StatefulSet。

Fluent Bit Only 将只启用轻量级的 Fluent Bit 对日志进行采集、处理以及转发。

cat <<EOF | kubectl apply -f -

apiVersion: fluentbit.fluent.io/v1alpha2

kind: FluentBit

metadata:

name: fluent-bit

namespace: fluent

labels:

app.kubernetes.io/name: fluent-bit

spec:

image: kubesphere/fluent-bit:v1.8.11

positionDB:

hostPath:

path: /var/lib/fluent-bit/

resources:

requests:

cpu: 10m

memory: 25Mi

limits:

cpu: 500m

memory: 200Mi

fluentBitConfigName: fluent-bit-only-config

tolerations:

- operator: Exists

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterFluentBitConfig

metadata:

name: fluent-bit-only-config

labels:

app.kubernetes.io/name: fluent-bit

spec:

service:

parsersFile: parsers.conf

inputSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

filterSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

outputSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterInput

metadata:

name: kubelet

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

spec:

systemd:

tag: service.kubelet

path: /var/log/journal

db: /fluent-bit/tail/kubelet.db

dbSync: Normal

systemdFilter:

- _SYSTEMD_UNIT=kubelet.service

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterFilter

metadata:

name: systemd

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

spec:

match: service.*

filters:

- lua:

script:

key: systemd.lua

name: fluent-bit-lua

call: add_time

timeAsTable: true

---

apiVersion: v1

data:

systemd.lua: |

function add_time(tag, timestamp, record)

new_record = {}

timeStr = os.date("!*t", timestamp["sec"])

t = string.format("%4d-%02d-%02dT%02d:%02d:%02d.%sZ",

timeStr["year"], timeStr["month"], timeStr["day"],

timeStr["hour"], timeStr["min"], timeStr["sec"],

timestamp["nsec"])

kubernetes = {}

kubernetes["pod_name"] = record["_HOSTNAME"]

kubernetes["container_name"] = record["SYSLOG_IDENTIFIER"]

kubernetes["namespace_name"] = "kube-system"

new_record["time"] = t

new_record["log"] = record["MESSAGE"]

new_record["kubernetes"] = kubernetes

return 1, timestamp, new_record

end

kind: ConfigMap

metadata:

labels:

app.kubernetes.io/component: operator

app.kubernetes.io/name: fluent-bit-lua

name: fluent-bit-lua

namespace: fluent

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterOutput

metadata:

name: es

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "fluentbit-only"

spec:

matchRegex: (?:kube|service)\.(.*)

es:

host: elasticsearch-master.elastic.svc

port: 9200

generateID: true

logstashPrefix: fluent-log-fb-only

logstashFormat: true

timeKey: "@timestamp"

EOF

cat <<EOF | kubectl apply -f -

apiVersion: fluentbit.fluent.io/v1alpha2

kind: FluentBit

metadata:

name: fluent-bit

namespace: fluent

labels:

app.kubernetes.io/name: fluent-bit

spec:

image: kubesphere/fluent-bit:v1.8.11

positionDB:

hostPath:

path: /var/lib/fluent-bit/

resources:

requests:

cpu: 10m

memory: 25Mi

limits:

cpu: 500m

memory: 200Mi

fluentBitConfigName: fluent-bit-config

tolerations:

- operator: Exists

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterFluentBitConfig

metadata:

name: fluent-bit-config

labels:

app.kubernetes.io/name: fluent-bit

spec:

service:

parsersFile: parsers.conf

inputSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "k8s"

filterSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "k8s"

outputSelector:

matchLabels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "k8s"

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterInput

metadata:

name: tail

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "k8s"

spec:

tail:

tag: kube.*

path: /var/log/containers/*.log

parser: docker

refreshIntervalSeconds: 10

memBufLimit: 5MB

skipLongLines: true

db: /fluent-bit/tail/pos.db

dbSync: Normal

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterFilter

metadata:

name: kubernetes

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/mode: "k8s"

spec:

match: kube.*

filters:

- kubernetes:

kubeURL: https://kubernetes.default.svc:443

kubeCAFile: /var/run/secrets/kubernetes.io/serviceaccount/ca.crt

kubeTokenFile: /var/run/secrets/kubernetes.io/serviceaccount/token

labels: false

annotations: false

- nest:

operation: lift

nestedUnder: kubernetes

addPrefix: kubernetes_

- modify:

rules:

- remove: stream

- remove: kubernetes_pod_id

- remove: kubernetes_host

- remove: kubernetes_container_hash

- nest:

operation: nest

wildcard:

- kubernetes_*

nestUnder: kubernetes

removePrefix: kubernetes_

---

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterOutput

metadata:

name: kafka

labels:

fluentbit.fluent.io/enabled: "false"

fluentbit.fluent.io/mode: "k8s"

spec:

matchRegex: (?:kube|service)\.(.*)

kafka:

brokers: my-cluster-kafka-bootstrap.kafka.svc:9091,my-cluster-kafka-bootstrap.kafka.svc:9092,my-cluster-kafka-bootstrap.kafka.svc:9093

topics: fluent-log

EOF

凭借 Fluentd 丰富的插件,Fluentd 可以充当日志聚合层,执行更高级的日志处理。您可以使用 Fluent Operator 轻松地将日志从 Fluent Bit 转发到 Fluentd。

要将日志从 Fluent Bit 转发到 Fluentd,您需要启用 Fluent Bit 的 forward 插件,如下所示:

cat <<EOF | kubectl apply -f -

apiVersion: fluentbit.fluent.io/v1alpha2

kind: ClusterOutput

metadata:

name: fluentd

labels:

fluentbit.fluent.io/enabled: "true"

fluentbit.fluent.io/component: logging

spec:

matchRegex: (?:kube|service)\.(.*)

forward:

host: fluentd.fluent.svc

port: 24224

EOF

Fluentd forward Input 插件会在部署 Fluentd 时默认启用,因此你只需要部署下列 yaml 来部署 Fluentd:

apiVersion: fluentd.fluent.io/v1alpha1

kind: Fluentd

metadata:

name: fluentd

namespace: fluent

labels:

app.kubernetes.io/name: fluentd

spec:

globalInputs:

- forward:

bind: 0.0.0.0

port: 24224

replicas: 1

image: kubesphere/fluentd:v1.14.4

fluentdCfgSelector:

matchLabels:

config.fluentd.fluent.io/enabled: "true"

如果你定义了 ClusterFluentdConfig,那么你可以收集任意或者所有 namespace 下的日志。我么可以通过 watchedNamespaces 字段来选择所需要采集日志的 namespace。以下配置是采集 kube-system 以及 default namespace 下的日志:

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFluentdConfig

metadata:

name: cluster-fluentd-config

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

watchedNamespaces:

- kube-system

- default

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/scope: "cluster"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-es

labels:

output.fluentd.fluent.io/scope: "cluster"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-cluster-fd

EOF

如果你定义了 FluentdConfig,那么你只能将与该 FluentdConfig 同一 namespace 下的日志发送到 Output,通过这种方式实现了不同 namespace 下的日志隔离。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: FluentdConfig

metadata:

name: namespace-fluentd-config

namespace: fluent

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

outputSelector:

matchLabels:

output.fluentd.fluent.io/scope: "namespace"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: Output

metadata:

name: namespace-fluentd-output-es

namespace: fluent

labels:

output.fluentd.fluent.io/scope: "namespace"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-namespace-fd

EOF

同样您可以使用 Fluentd 的 filter 插件根据不同的 namespace 将日志分发到不同的 topic。在这里我们包含在 Fluentd 内核中的插件 recordTransformer,该插件可以对事件进行增删改查。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFluentdConfig

metadata:

name: cluster-fluentd-config-kafka

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

watchedNamespaces:

- kube-system

- default

clusterFilterSelector:

matchLabels:

filter.fluentd.fluent.io/type: "k8s"

filter.fluentd.fluent.io/enabled: "true"

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/type: "kafka"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFilter

metadata:

name: cluster-fluentd-filter-k8s

labels:

filter.fluentd.fluent.io/type: "k8s"

filter.fluentd.fluent.io/enabled: "true"

spec:

filters:

- recordTransformer:

enableRuby: true

records:

- key: kubernetes_ns

value: ${record["kubernetes"]["namespace_name"]}

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-kafka

labels:

output.fluentd.fluent.io/type: "kafka"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- kafka:

brokers: my-cluster-kafka-bootstrap.default.svc:9091,my-cluster-kafka-bootstrap.default.svc:9092,my-cluster-kafka-bootstrap.default.svc:9093

useEventTime: true

topicKey: kubernetes_ns

EOF

当然,你可以像下面一样同时使用 ClusterFluentdConfig 与 FluentdConfig。FluentdConfig 会将 fluent namespace 下的日志发送到 ClusterOutput,而 ClusterFluentdConfig 同时也会将 watchedNamespaces 字段下的 namespace(即 kube-system 以及 default 两个 namespace)发送到 ClusterOutput。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFluentdConfig

metadata:

name: cluster-fluentd-config-hybrid

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

watchedNamespaces:

- kube-system

- default

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/scope: "hybrid"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: FluentdConfig

metadata:

name: namespace-fluentd-config-hybrid

namespace: fluent

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/scope: "hybrid"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-es-hybrid

labels:

output.fluentd.fluent.io/scope: "hybrid"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-hybrid-fd

EOF

在多租户场景下,我们可以同时使用集群范围与 namespace 范围的 FluentdConfig 达到日志隔离的效果。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: FluentdConfig

metadata:

name: namespace-fluentd-config-user1

namespace: fluent

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

outputSelector:

matchLabels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/user: "user1"

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/user: "user1"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFluentdConfig

metadata:

name: cluster-fluentd-config-cluster-only

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

watchedNamespaces:

- kube-system

- kubesphere-system

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/scope: "cluster-only"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: Output

metadata:

name: namespace-fluentd-output-user1

namespace: fluent

labels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/user: "user1"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-user1-fd

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-user1

labels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/user: "user1"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-cluster-user1-fd

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-cluster-only

labels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/scope: "cluster-only"

spec:

outputs:

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-cluster-only-fd

EOF

您可以添加一个缓冲区来缓存 output 插件的日志。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFluentdConfig

metadata:

name: cluster-fluentd-config-buffer

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

watchedNamespaces:

- kube-system

- default

clusterFilterSelector:

matchLabels:

filter.fluentd.fluent.io/type: "buffer"

filter.fluentd.fluent.io/enabled: "true"

clusterOutputSelector:

matchLabels:

output.fluentd.fluent.io/type: "buffer"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterFilter

metadata:

name: cluster-fluentd-filter-buffer

labels:

filter.fluentd.fluent.io/type: "buffer"

filter.fluentd.fluent.io/enabled: "true"

spec:

filters:

- recordTransformer:

enableRuby: true

records:

- key: kubernetes_ns

value: ${record["kubernetes"]["namespace_name"]}

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: ClusterOutput

metadata:

name: cluster-fluentd-output-buffer

labels:

output.fluentd.fluent.io/type: "buffer"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- stdout: {}

buffer:

type: file

path: /buffers/stdout.log

- elasticsearch:

host: elasticsearch-master.elastic.svc

port: 9200

logstashFormat: true

logstashPrefix: fluent-log-buffer-fd

buffer:

type: file

path: /buffers/es.log

EOF

你同样可以开启 Fluentd Only 模式,该模式只会部署 Fluentd statefulset。

如果你想单独开启 Fluentd 插件,你可以通过 HTTP 来接收日志。

cat <<EOF | kubectl apply -f -

apiVersion: fluentd.fluent.io/v1alpha1

kind: Fluentd

metadata:

name: fluentd-http

namespace: fluent

labels:

app.kubernetes.io/name: fluentd

spec:

globalInputs:

- http:

bind: 0.0.0.0

port: 9880

replicas: 1

image: kubesphere/fluentd:v1.14.4

fluentdCfgSelector:

matchLabels:

config.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: FluentdConfig

metadata:

name: fluentd-only-config

namespace: fluent

labels:

config.fluentd.fluent.io/enabled: "true"

spec:

filterSelector:

matchLabels:

filter.fluentd.fluent.io/mode: "fluentd-only"

filter.fluentd.fluent.io/enabled: "true"

outputSelector:

matchLabels:

output.fluentd.fluent.io/mode: "true"

output.fluentd.fluent.io/enabled: "true"

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: Filter

metadata:

name: fluentd-only-filter

namespace: fluent

labels:

filter.fluentd.fluent.io/mode: "fluentd-only"

filter.fluentd.fluent.io/enabled: "true"

spec:

filters:

- stdout: {}

---

apiVersion: fluentd.fluent.io/v1alpha1

kind: Output

metadata:

name: fluentd-only-stdout

namespace: fluent

labels:

output.fluentd.fluent.io/enabled: "true"

output.fluentd.fluent.io/enabled: "true"

spec:

outputs:

- stdout: {}

EOF

本文由博客一文多发平台 OpenWrite 发布!

我正在使用i18n从头开始构建一个多语言网络应用程序,虽然我自己可以处理一大堆yml文件,但我说的语言(非常)有限,最终我想寻求外部帮助帮助。我想知道这里是否有人在使用UI插件/gem(与django上的django-rosetta不同)来处理多个翻译器,其中一些翻译器不愿意或无法处理存储库中的100多个文件,处理语言数据。谢谢&问候,安德拉斯(如果您已经在rubyonrails-talk上遇到了这个问题,我们深表歉意) 最佳答案 有一个rails3branchofthetolkgem在github上。您可以通过在Gemfi

我安装了ruby版本管理器,并将RVM安装的ruby实现设置为默认值,这样'哪个ruby'显示'~/.rvm/ruby-1.8.6-p383/bin/ruby'但是当我在emacs中打开inf-ruby缓冲区时,它使用安装在/usr/bin中的ruby。有没有办法让emacs像shell一样尊重ruby的路径?谢谢! 最佳答案 我创建了一个emacs扩展来将rvm集成到emacs中。如果您有兴趣,可以在这里获取:http://github.com/senny/rvm.el

是否有简单的方法来更改默认ISO格式(yyyy-mm-dd)的ActiveAdmin日期过滤器显示格式? 最佳答案 您可以像这样为日期选择器提供额外的选项,而不是覆盖js:=f.input:my_date,as::datepicker,datepicker_options:{dateFormat:"mm/dd/yy"} 关于ruby-on-rails-事件管理员日期过滤器日期格式自定义,我们在StackOverflow上找到一个类似的问题: https://s

我想用这两种语言中的任何一种(最好是ruby)制作一个窗口管理器。老实说,除了我需要加载某种X模块外,我不知道从哪里开始。因此,如果有人有线索,如果您能指出正确的方向,那就太好了。谢谢 最佳答案 XCB,X的下一代API使用XML格式定义X协议(protocol),并使用脚本生成特定语言绑定(bind)。它在概念上与SWIG类似,只是它描述的不是CAPI,而是X协议(protocol)。目前,C和Python存在绑定(bind)。理论上,Ruby端口只是编写一个从XML协议(protocol)定义语言到Ruby的翻译器的问题。生

这是我在ActiveAdmin中的自定义页面ActiveAdmin.register_page"Settings"doaction_itemdolink_to('Importprojects','settings/importprojects')endcontentdopara"Text"endcontrollerdodefimportprojectssystem"rakedataspider:import_projects_ninja"para"OK"endendend我想做的是,当我单击“导入项目”按钮时,我想在Controller中执行rake任务。但是我无法访问该方法。可能是什

如何在出现异常时指定全局救援,如果您将Sinatra用于API或应用程序,您将如何处理日志记录? 最佳答案 404可以在not_found方法的帮助下处理,例如:not_founddo'Sitedoesnotexist.'end500s可以通过调用带有block的错误方法来处理,例如:errordo"Applicationerror.Plstrylater."end错误的详细信息可以通过request.env中的sinatra.error访问,如下所示:errordo'Anerroroccured:'+request.env['si

我正在使用ruby标准记录器,我想要每天轮换一次,所以在我的代码中我有:Logger.new("#{$ROOT_PATH}/log/errors.log",'daily')它运行完美,但它创建了两个文件errors.log.20130217和errors.log.20130217.1。如何强制它每天只创建一个文件? 最佳答案 您的代码对于长时间运行的应用程序是正确的。发生的事情是您在给定的一天多次运行代码。第一次运行时,Ruby会创建一个日志文件“errors.log”。当日期改变时,Ruby将文件重命名为“errors.log

在运行Cucumber测试时,我得到(除了测试结果)大量调试/日志相关的输出形式:D,[2013-03-06T12:21:38.911829#49031]DEBUG--:SOAPrequest:D,[2013-03-06T12:21:38.911919#49031]DEBUG--:Pragma:no-cache,SOAPAction:"",Content-Type:text/xml;charset=UTF-8,Content-Length:1592W,[2013-03-06T12:21:38.912360#49031]WARN--:HTTPIexecutesHTTPPOSTusingt

我最近将我的http客户端切换到faraday,一切都按预期工作。我有以下代码来创建连接:@connection=Faraday.new(:url=>base_url)do|faraday|faraday.useCustim::Middlewarefaraday.request:url_encoded#form-encodePOSTparamsfaraday.request:jsonfaraday.response:json,:content_type=>/\bjson$/faraday.response:loggerfaraday.adapterFaraday.default_ada

我正在寻找用于Rails的优质管理插件。似乎大多数现有的插件/gem(例如“restful_authentication”、“acts_as_authenticated”)都围绕着self注册等展开。但是,我正在寻找一种功能齐全的基于管理/管理角色的解决方案——但不是简单地附加到另一个非基于角色的解决方案。如果我找不到,我想我会自己动手......只是不想重新发明轮子。 最佳答案 RyanBates最近做了两个关于授权的railscast(注意身份验证和授权之间的区别;身份验证检查用户是否如她所说的那样,授权检查用户是否有权访问资源